Lors de la présentation de TurboQuant par Google en mars, une part du secteur a interprété cette annonce comme une potentialité pour atténuer la pression exercée sur la mémoire dans les grands modèles. Cette lecture n’était pas dénuée de fondement : la société elle-même expliquait que sa technique permettait de compresser le KV cache, de réduire son empreinte mémoire et d’accélérer certains traitements liés à l’IA sans compromettre la qualité des résultats. Toutefois, améliorer l’efficacité par requête ne revient pas à résoudre le déséquilibre industriel actuel du marché de la mémoire.

En réalité, SK hynix adopte une position diamétralement opposée. Lors de la publication de ses résultats du premier trimestre 2026, la société a affirmé que l’expansion des technologies de stockage préserve la demande globale de mémoire, voire la stimule, en améliorant la rentabilité des services d’Intelligence Artificielle et en élargissant leur champ d’application dans divers scénarios.

Ce que Google a réellement annoncé avec TurboQuant

Google Research a dévoilé TurboQuant le 24 mars 2026 comme un algorithme de compression destiné aux vecteurs de haute dimension, visant notamment à réduire les goulets d’étranglement liés au KV cache dans les modèles de langage. Selon la société, ce système a permis lors de ses tests de réduire la taille de cette mémoire d’au moins six fois, de quantifier la KV cache jusqu’à 3 bits sans entraînement supplémentaire ni perte de précision dans les benchmarks, et d’accélérer le calcul des logits d’attention avec des gains allant jusqu’à 8 fois comparé à des clés non quantifiées sur GPU H100.

Ce qui fait de TurboQuant une avancée technique significative. Google présente cette innovation comme une façon d’optimiser l’utilisation de la mémoire à l’intérieur des modèles et des moteurs de recherche vectoriels, et non comme une solution à la pénurie mondiale de DRAM, HBM ou NAND. En somme, TurboQuant s’attaque à un goulot d’étranglement spécifique dans l’architecture du modèle, mais il ne supprime pas en soi le besoin d’augmenter la capacité installée, le débit ou la mémoire physique dans l’écosystème de l’IA.

La réponse de SK hynix : l’efficacité réduit les coûts et étend le marché

La position de SK hynix est particulièrement importante puisqu’elle émane de l’un des principaux indicateurs pour la mémoire avancée destinée à l’IA. Dans son rapport de résultats, la société explique qu’avec l’évolution de l’IA, passant de la formation de grands modèles à une phase d’IA agentique avec inférence en temps réel dans divers environnements, la demande en mémoire s’élargit tant pour la DRAM que pour la NAND flash.

Elle ajoute un point essentiel : l’adoption de technologies plus efficaces permettrait d’accroître la viabilité économique des services d’IA, d’élargir la taille globale du marché et, en fin de compte, de stimuler davantage la demande en mémoire. En d’autres termes, l’économie par unité de mémoire ne réduirait pas principalement la consommation totale, mais favoriserait une plus grande diffusion des services, une utilisation accrue par plus d’utilisateurs et une multiplication des charges de travail dans le système.

C’est pourquoi SK hynix ne voit pas un scénario de relâchement, mais au contraire une tendance à la croissance. La société a clôturé le trimestre avec 52,5763 billions de wons de revenus, 37,6103 billions de bénéfice opérationnel et une marge opérationnelle de 72 %. Elle attribue ce record à la forte demande pour des produits à forte valeur ajoutée liés à l’IA, comme les HBM, les modules DRAM haute capacité pour serveurs, ou encore les eSSD. De plus, elle anticipe la poursuite de conditions tarifaires favorables aussi bien pour la DRAM que pour la NAND.

La paradoxe de l’efficacité dans l’IA

Ce que décrit SK hynix évoque une vieille dynamique industrielle : lorsqu’une technologie devient plus performante et moins coûteuse à utiliser, cela ne mène pas forcément à une réduction de la consommation totale du ressource concernée ; au contraire, cette consommation peut s’accroître. Dans ce contexte, si une méthode comme TurboQuant permet de gérer davantage de contexte par unité de mémoire, d’accélérer certaines inférences ou d’améliorer le rendement par requête, l’effet pratique peut être un déploiement accru de solutions, de services et d’applications, plutôt qu’un déclin. Cette conclusion découle directement de l’explication de SK hynix sur la relation entre efficacité, rentabilité des services et croissance de la demande.

Il devient alors clair pourquoi le marché ne doit pas confondre une optimisation algorithmique avec une solution structurelle à la cyclicité de la mémoire. TurboQuant constitue une amélioration technique précieuse pour réduire la pression interne aux modèles et diminuer les coûts opérationnels pour certains traitements, mais l’industrie évolue dans un environnement où les fournisseurs de mémoire profitent d’une expansion rapide de l’infrastructure IA, du passage à des systèmes agentiques, et d’une demande croissante pour des produits haut de gamme.

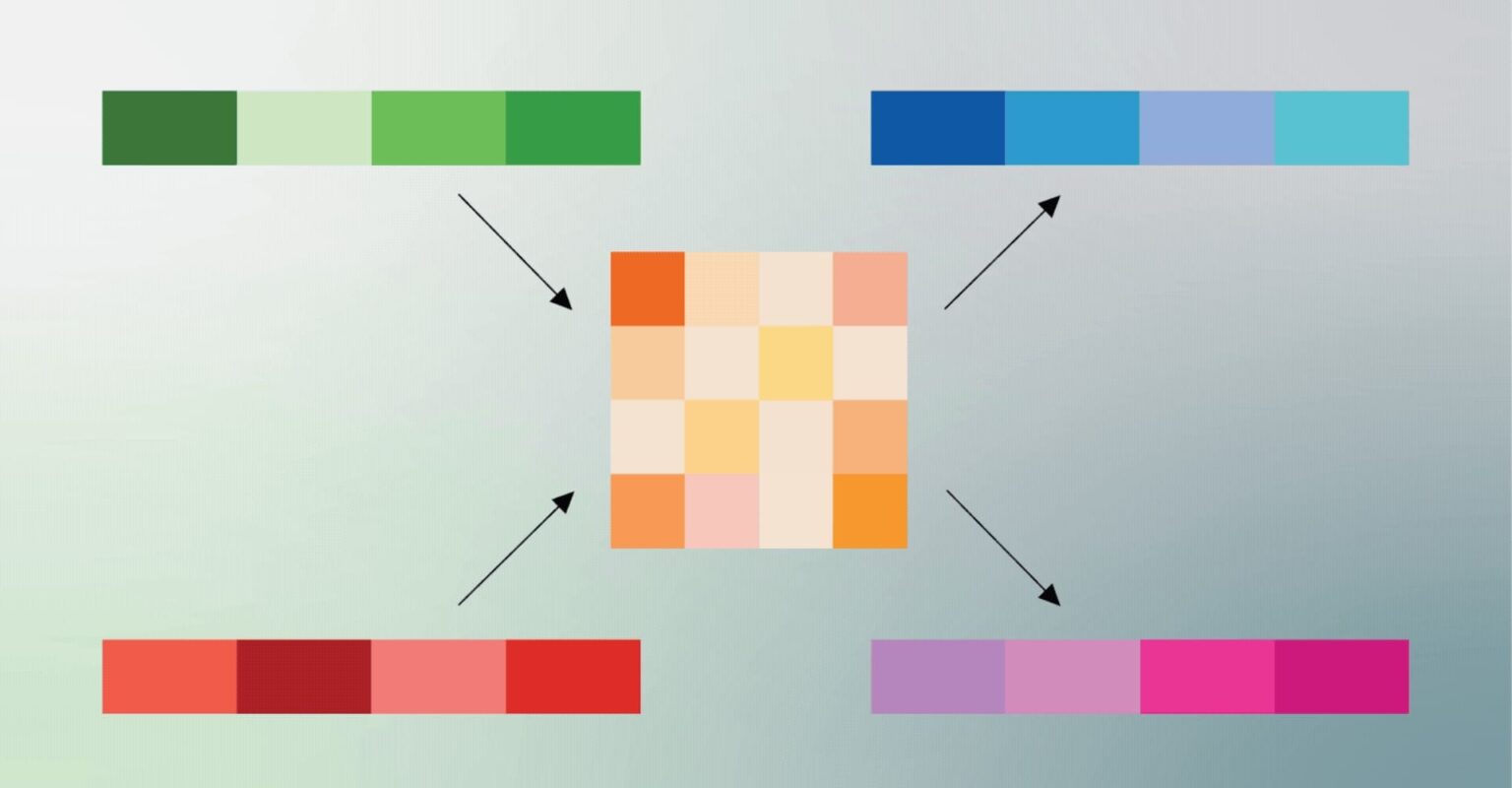

Tableau synthétique : ce que promet TurboQuant et ce que prévoit SK hynix

| Point clé | Google TurboQuant | Vision de SK hynix |

|---|---|---|

| Objectif principal | Compresser le KV cache et atténuer les goulots d’étranglement mémoire | Analyser la demande réelle en mémoire à l’ère de l’IA |

| Fait saillant | Réduction d’au moins 6 fois de la taille du KV cache lors des tests | Une meilleure efficacité mémoire peut augmenter la demande totale |

| Impact technique | KV cache à 3 bits sans ajuste fin ni perte de précision dans les benchmarks | Plus de contexte par unité de mémoire et expansion du marché de services |

| Implication industrielle | Réduction des coûts par charge spécifique et amélioration de l’efficacité du modèle | Plus d’adoption de l’IA, déploiements accrus et pression persistante sur la DRAM et la NAND |

L’enjeu principal pour le marché

En somme, la conclusion n’est pas que TurboQuant « échoue », mais que ses effets peuvent différer des attentes initiales. Google a mis au point un outil performant pour comprimer la mémoire lors des phases d’inférence. Cependant, SK hynix soutient que dans un marché de l’IA en expansion continue, cette même efficacité pourrait agir comme un levier supplémentaire pour soutenir la croissance.

Vu sous cet angle, la crise de la mémoire ne pourra pas se résoudre uniquement par de meilleurs algorithmes. La capacité de production, la composition des gammes de produits, l’investissement dans l’HBM et la DRAM pour serveurs, ainsi que l’adoption des services d’IA par les entreprises et les consommateurs restent déterminants. À l’heure actuelle, un des principaux acteurs du secteur adopte une position claire : l’efficience n’éteint pas la demande, elle la rend plus rentable et, par conséquent, plus importante.

Questions fréquentes

Qu’est-ce que TurboQuant et quelle amélioration apporte-t-il ?

Il s’agit d’un algorithme présenté par Google Research pour comprimer les vecteurs de haute dimension et réduire la taille du KV cache dans les modèles d’IA. Lors de ses tests, Google affirme avoir réduit cette mémoire d’au moins six fois et l’avoir quantifiée à 3 bits sans perte de précision dans les benchmarks utilisés.

Google a-t-il dit que TurboQuant résoudrait la pénurie mondiale de mémoire ?

Non. Google a présenté TurboQuant comme une avancée technique pour atténuer les goulets d’étranglement mémoire dans les modèles et les recherches vectorielles, et non comme une solution à la crise globale de la mémoire DRAM ou HBM.

Que dit SK hynix à propos des technologies d’efficacité mémoire ?

SK hynix affirme que ces technologies peuvent améliorer la rentabilité des services d’IA, élargir la taille du marché et stimuler encore plus la demande en mémoire.

Donc, l’efficacité réduit-elle ou augmente-t-elle la demande ?

Par unité de travail, elle peut diminuer la consommation mémoire, mais à l’échelle du marché, elle tend à augmenter la demande totale si elle permet de réduire les coûts et d’accroître l’adoption des services. C’est cette thèse que défend SK hynix dans son dernier rapport trimestriel.

via : wccftech