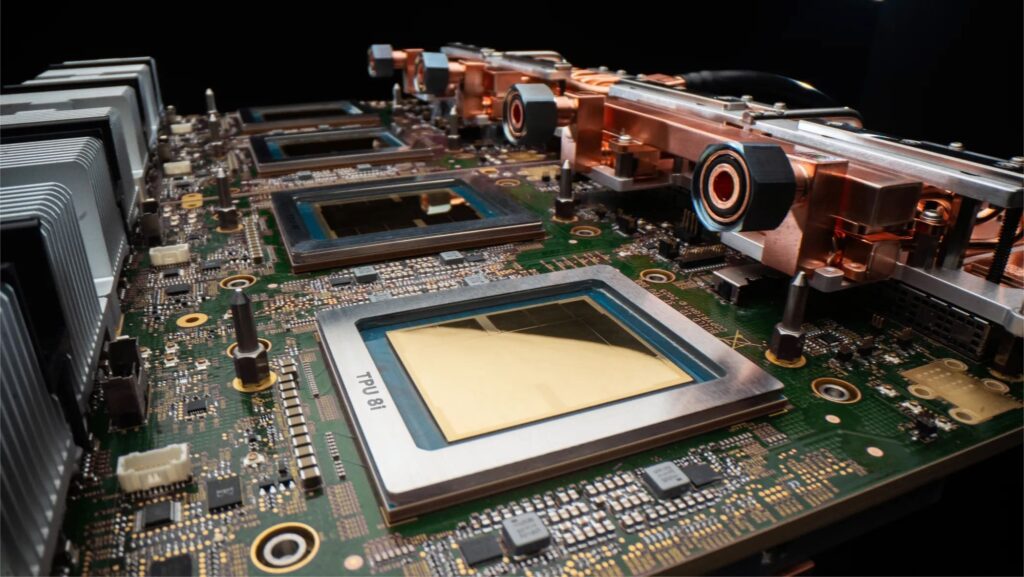

Google a présenté la huitième génération de ses Tensor Processing Units (TPU) et, pour la première fois, a clairement différencié sa stratégie en deux puces distinctes : TPU 8t, destiné à l’entraînement de modèles, et TPU 8i, conçu pour l’inférence à faible latence. La société les positionne comme sa réponse à une nouvelle étape de l’Intelligence Artificielle, marquée par des agents capables non seulement de répondre à des questions, mais aussi de raisonner, d’enchaîner des étapes, d’apprendre de leurs actions et d’exécuter des flux complexes en temps réel.

Le message de Google est clair : l’IA agentique ne s’intègre plus efficacement dans une infrastructure générique. C’est pourquoi ils ont opté pour deux architectures « purpose-built », c’est-à-dire spécialement conçues dès le départ pour des charges de travail très différentes. Le TPU 8t se concentre sur la réduction du cycle de développement pour de grands modèles, tandis que le TPU 8i vise à fournir une inférence à grande échelle avec plus d’efficacité et de moindre latence. Ces deux puces seront disponibles commercialement plus tard cette année via Google Cloud et feront partie de leur plateforme AI Hypercomputer.

Il ne s’agit pas seulement d’une mise à jour de gamme. Google souhaite renforcer une idée qu’il répète depuis des années : l’avenir de l’IA ne dépend pas uniquement du chip, mais de l’intégration complète entre silicium, réseau, stockage, logiciel, refroidissement et centres de données. Dans cette optique, le TPU 8t et le TPU 8i fonctionneront pour la première fois sur les processeurs Axion, les CPU Arm propriétaires de Google, qui maintiennent également la priorité sur la refroidissement liquide et l’optimisation énergétique à l’échelle du système.

Deux TPU pour deux problématiques distinctes

La décision de séparer l’entraînement de l’inférence répond à une mutation profonde du marché. Il y a quelques années, l’effort principal portait sur l’entraînement de modèles fondamentaux de plus en plus volumineux. Aujourd’hui, il faut aussi déployer ces modèles en production, gérer des millions de requêtes, maintenir des contextes longs, et coordonner des agents spécialisés collaborant entre eux. Google affirme que ces charges ont des besoins si différents qu’il n’est plus rentable de les traiter avec le même matériel.

TPU 8t est la pièce la plus orientée vers l’entraînement massif. Google indique qu’un seul superpod peut s’étendre jusqu’à 9 600 chips, avec deux pétaoctets de mémoire HBM partagée et un doublement de la bande passante entre chips par rapport à la génération précédente. La capacité est estimée à 121 exaflops de puissance de calcul, et le système offre presque trois fois plus de performance par pod que la génération antérieure. Il bénéfice également d’un stockage délivrant une vitesse 10 fois supérieure et vise un taux de goodput supérieur à 97 %, c’est-à-dire du temps de calcul réellement utile, minimisant pertes, attentes ou redémarrages.

TPU 8i, quant à lui, est conçu pour l’inférence, le post-entraînement, et le raisonnement. Google a mis en avant la mémoire et la latence. Chaque puce intègre 288 Go de HBM et 384 Mo de SRAM sur puce, soit trois fois plus que dans la génération précédente, et repose sur une nouvelle topologie d’interconnexion baptisée Boardfly. Cette architecture permet de connecter jusqu’à 1 152 puces en un seul pod et de réduire le diamètre maximum du réseau de 16 à 7 sauts, un élément crucial pour les modèles Mixture of Experts (MoE) et pour les charges où la coordination entre agents et experts spécialisés peut devenir un goulot d’étranglement. Google affirme que le TPU 8i offre une amélioration pouvant aller jusqu’à 80 % en performance par dollar par rapport à Ironwood.

Une course qui ne se gagne plus uniquement avec des FLOPS

Au-delà des chiffres, ce lancement transmet un message clair : la compétition hardware pour l’IA évolue du simple processeur isolé vers le système complet. Google insiste sur le fait qu’il a développé les TPU 8t et 8i en collaboration avec Google DeepMind, en se basant sur les besoins réels des modèles actuels. La topologie Boardfly a été conçue pour répondre aux exigences de communication des modèles de raisonnement ; la SRAM des TPU 8i pour mieux héberger le KV cache en production ; et le réseau Virgo pour supporter le parallèle massif lors de l’entraînement de modèles multi-milliards de paramètres.

Google cherche aussi à intégrer l’efficacité énergétique comme argument commercial. Selon eux, les TPU 8t et 8i offrent jusqu’à deux fois plus de performance par watt que Ironwood, grâce à une quatrième génération de refroidissement liquide. Ils mettent également en avant une intégration accrue entre connectivité et puissance de calcul sur une seule puce, ainsi qu’une optimisation globale qui, d’après la société, a permis à ses centres de données de proposer six fois plus de puissance par unité d’électricité qu’il y a cinq ans.

Ce focus n’est pas fortuit. L’IA atteint déjà des limites physiques concrètes : énergie, refroidissement, densité, coûts opérationnels. Dans ce contexte, résoudre uniquement par plus de puissance ne suffit plus. Google affirme que son avantage réside dans la maîtrise de toute la chaîne, du CPU hôte jusqu’au réseau, en passant par le logiciel et la conception du centre de données.

Tableau comparatif : répartition des TPU 8t et TPU 8i

| Caractéristique | TPU 8t | TPU 8i |

|---|---|---|

| Objectif principal | Entraînement à grande échelle | Inférence, déploiement et raisonnement |

| Scale maximal par système | 9 600 puces par superpod | 1 152 puces par pod |

| Mémoire HBM par puce | 216 GB | 288 GB |

| SRAM sur puce | 128 Mo | 384 Mo |

| Topologie réseau | Torus 3D | Boardfly |

| Performance notable | 121 exaflops par superpod | +80 % de performance par dollar par rapport à Ironwood |

| Amélioration clé | ~3x plus de performance par pod | Latence plus faible et meilleure efficacité en inférence |

Sources : Google Cloud et Google Blog.

Un message aussi pour Nvidia

Bien que Google ne présente pas cette annonce comme une attaque directe contre Nvidia, le contexte concurrentiel est évident. Selon TechCrunch et d’autres médias américains, cette huitième génération de TPU renforce la position de Google Cloud dans une course où Nvidia demeure largement leader sur le marché des accélérateurs pour l’IA. La différence réside dans le fait que Google déploie depuis des années ses TPU dans ses propres services, notamment avec des modèles comme Gemini, et souhaite maintenant transformer cette expertise interne en une offre plus agressive pour ses clients cloud.

Google ne prône pas pour autant un univers cloisonné. La société insiste sur la compatibilité native des deux systèmes avec JAX, PyTorch, SGLang et vLLM, ainsi que sur l’accès bare metal, pour faciliter le déploiement de modèles et charges existants. Par ailleurs, elle souligne que le TPU 8t et le TPU 8i ne constituent pas simplement des puces isolées, mais des éléments d’une offre globale incluant stockage, réseau, logiciel et modèles modulaires dans le cadre du AI Hypercomputer.

Questions fréquentes

Que présente Google précisément ?

Google a dévoilé sa huitième génération de TPU comprenant deux puces distinctes : TPU 8t pour l’entraînement et TPU 8i pour l’inférence, le déploiement et le raisonnement.

Quelle est la différence principale entre TPU 8t et TPU 8i ?

Le TPU 8t est optimisé pour l’entraînement massif, pouvant atteindre 9 600 puces par superpod, tandis que le TPU 8i privilégie mémoire, latence et efficacité pour l’inférence, avec jusqu’à 1 152 puces par pod.

Quand seront-ils disponibles ?

Google indique que les deux puces seront accessibles en production plus tard cette année via Google Cloud.

Pourquoi Google évoque-t-il « l’ère des agents » ?

Parce que, selon la société, les modèles récents ne se contentent plus de répondre, mais exécutent des flux en plusieurs étapes, raisonnent, collaborent entre eux et manipulent de longs contextes, ce qui nécessite une infrastructure distincte pour l’entraînement et l’inférence.

Sources : blog.google