SK hynix mise sur l’hybride pour la HBM5 et la mémoire IA

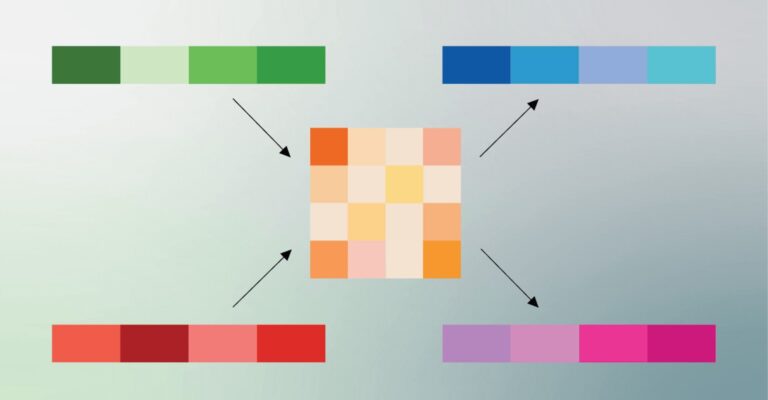

SK hynix mise sur une approche hybride pour la HBM5, prochaine génération de mémoire haute bande passante pour les accélérateurs IA. L’objectif : optimiser le rapport performance/coût/efficacité énergétique. SK hynix est le principal fournisseur de HBM pour NVIDIA. Les premiers échantillons HBM5 sont attendus 2026-2027 pour les GPU Rubin. Ce marché fait partie d’un secteur qui dépassera 1,3 trillion $ en 2026 selon Gartner. Parallèlement, Samsung et SK hynix relancent aussi le NAND avec des SSD IA. Questions fréquentes HBM5 ?5e génération High Bandwidth Memory pour accélérateurs IA nouvelle génération. Pourquoi hybride ?Combiner différentes technologies mémoire pour optimiser performance/coût/énergie. SK hynix leader ?Oui, principal fournisseur HBM pour NVIDIA, devant Samsung et Micron. Disponibilité ?Échantillons 2026-2027, production de masse pour GPU