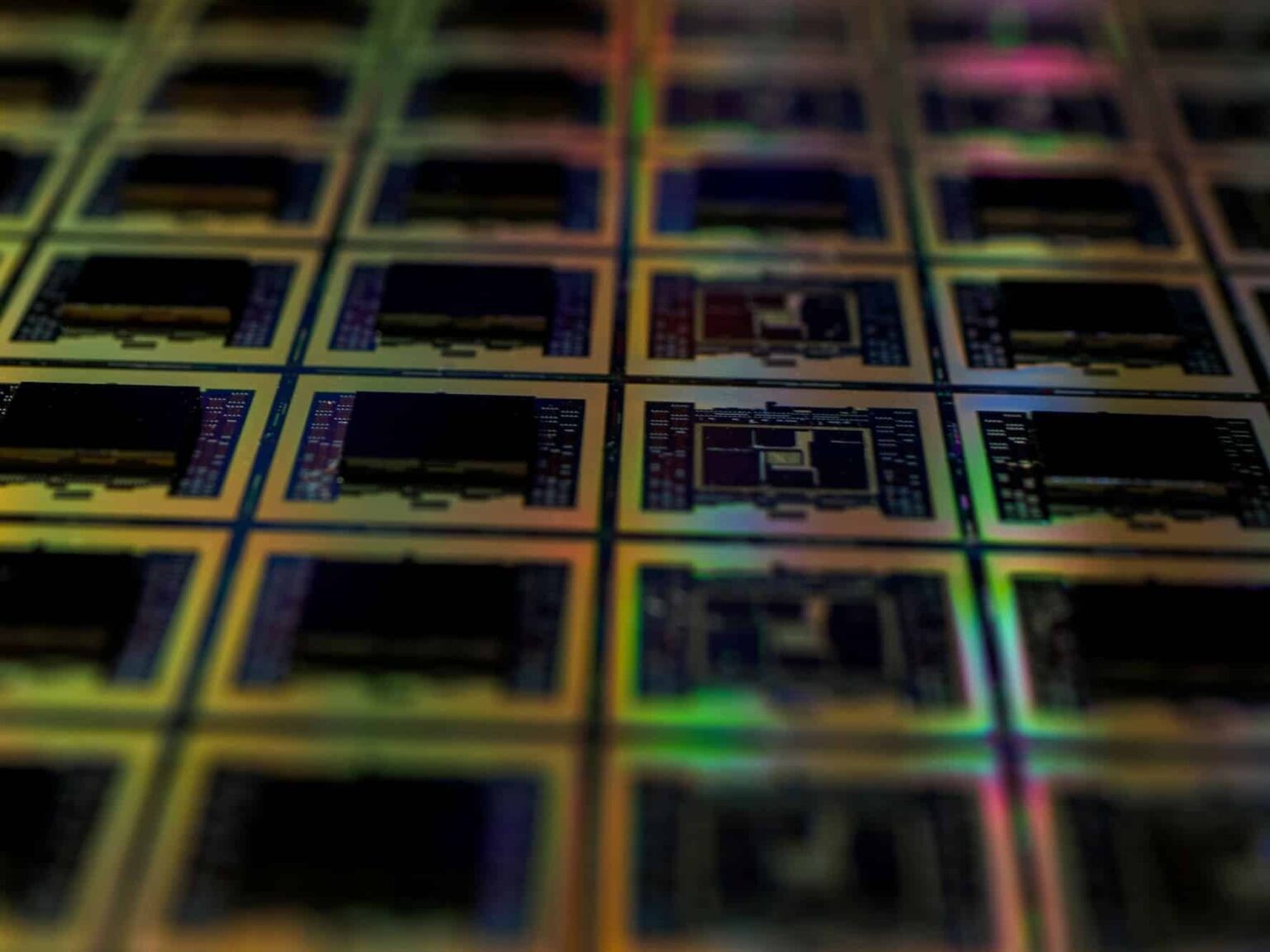

SEMIFIVE et ICY Tech ont finalisé le tape-out d’un SoC Edge AI intégrant de la mémoire eMRAM en 8 nm, fabriqué avec le procédé 8LPU de Samsung Foundry. L’objectif : exécuter localement des modèles d’IA jusqu’à 2 milliards de paramètres, sans connexion Internet permanente. Une étape qui positionne les deux sociétés sur l’un des fronts les plus disputés de la course aux puces IA, entre les acteurs asiatiques qui misent sur la mémoire non volatile intégrée et ceux qui restent sur des architectures SRAM plus conventionnelles.

eMRAM : une mémoire non volatile au centre du SoC

La mémoire est souvent le facteur limitant dans les puces d’IA embarquées. On peut multiplier les unités de calcul, mais si les données ne circulent pas assez vite, les performances plafonnent. Sur les appareils de bord, où chaque milliwatt compte, le choix de la technologie mémoire est déterminant.

L’eMRAM (embedded Magnetic Random Access Memory) est une variante de MRAM intégrée directement dans le SoC. Contrairement à la DRAM, elle ne requiert pas de rafraîchissement périodique. Comparée à la flash, elle répond plus vite sur certains usages. Et face à la SRAM, elle offre une densité supérieure à surface égale, grâce à des cellules de bit plus compactes.

Sa propriété centrale, c’est la non-volatilité : les données persistent en cas de coupure de courant. Pour des appareils devant démarrer rapidement, fonctionner longtemps sur batterie ou conserver des paramètres critiques, cet avantage est concret. Samsung Foundry développe l’eMRAM depuis plusieurs années comme solution de mémoire non volatile avancée, compatible avec la logique CMOS, avec des gains documentés en vitesse, fiabilité à haute température et densité. Sa feuille de route prévoit l’extension vers les procédés FinFET, dont le 8 nm désormais utilisé dans ce projet.

Un SoC conçu pour l’inférence hors-ligne

Ce SoC combine la technologie Processing Near Memory (PNM) d’ICY Tech avec la plateforme de conception ASIC de SEMIFIVE. Le principe : rapprocher les unités de traitement de la mémoire pour limiter les transferts de données, et donc réduire la consommation lors des inférences. ICY Tech apporte son expertise en épintronique et circuits MRAM, avec ses accélérateurs pour la lecture haute bande passante et la multiplication matrice-vecteur in situ.

SEMIFIVE, société sud-coréenne partenaire de conception au sein de l’environnement Samsung Foundry SAFE, a converti cette architecture en un produit en silicium prêt pour la production. C’est son premier projet ASIC basé sur eMRAM, ce qui étend son portefeuille vers des architectures combinant mémoire non-conventionnelle et accélération IA.

L’objectif commercial est clair : proposer des appareils capables d’exécuter des modèles d’IA localement, avec une faible latence, sans dépendre de serveurs distants. Les applications visées, AI PCs, assistants privés en entreprise, robots humanoïdes, véhicules autonomes et cockpits numériques, partagent toutes une contrainte commune : la connectivité ne peut pas être un prérequis. Dans ces contextes, le traitement local n’est pas un choix de confort, c’est une nécessité.

| Composant | Rôle dans le projet |

|---|---|

| Samsung Foundry 8LPU | Procédé de fabrication 8 nm pour le SoC |

| eMRAM | Mémoire non volatile intégrée, faible consommation en veille |

| ICY Tech (PNM) | Architecture mémoire-proche-calcul, accélération pour l’inférence |

| SEMIFIVE | Conception ASIC complète, conversion en silicium |

| Capacité annoncée | Inférence locale pour modèles jusqu’à 2 milliards de paramètres |

Pourquoi ce tape-out intéresse la robotique, l’automobile et les AI PCs

Une partie croissante des workloads IA va migrer vers les appareils. Les centres de données restent indispensables pour l’entraînement et les cas d’usage complexes. Mais pour l’inférence au quotidien, transmettre des données vers le cloud engendre de la latence, des coûts, une dépendance réseau et des risques pour la confidentialité, autant de problèmes que les architectures Edge cherchent à court-circuiter.

Un robot humanoïde ne peut pas attendre la réponse d’un serveur distant pour ajuster son déplacement. Un véhicule autonome doit décider en temps réel. Un ordinateur personnel équipé d’IA intégrée offre davantage de vie privée si le traitement reste local. Et un agent en entreprise traitant des données sensibles a tout intérêt à éviter les services externes. Ce sont précisément ces contraintes que la technologie PNM d’ICY Tech et l’eMRAM de Samsung cherchent à traiter.

Réduire les transferts de données à l’intérieur du chip est l’un des moyens les plus efficaces d’économiser de l’énergie. En IA, les opérations ne sont pas seulement limitées par la puissance de calcul brute : le déplacement continu des poids et des activations entre mémoire et unités de traitement représente une part significative de la consommation. En rapprochant ces deux fonctions, les gains peuvent être substantiels. La demande de puces adaptées à ces contraintes ne faiblit pas — comme le montrent les résultats d’AMD au T1 2026, où l’IA agentique stimule simultanément la demande en CPU et en GPU pour les datacenters.

Les deux entreprises présentent ce SoC comme une avancée par rapport aux architectures Edge reposant sur la SRAM, dont la taille et la consommation limitent la capacité à héberger des modèles importants. C’est plausible, mais un tape-out marque la fin du design physique et l’envoi à la fabrication, pas une validation commerciale. Des données indépendantes, des tests avec des modèles réels et une analyse des coûts de production seront nécessaires pour confirmer ces promesses.

Un signal dans la consolidation asiatique des puces IA

Au-delà de la technique, cette annonce a une portée industrielle. L’Asie consolide ses ambitions non seulement dans la fabrication avancée, mais aussi dans la conception de puces sur mesure pour l’IA de bord. La combinaison SEMIFIVE (design ASIC) + ICY Tech (mémoire MRAM) + Samsung Foundry (procédé 8LPU) illustre cette stratégie dans une réalisation commerciale concrète.

Pour Samsung Foundry, si ce projet passe en production, cela renforcerait son positionnement dans le développement de l’eMRAM avancée. Pour SEMIFIVE, ce serait une référence sur un segment où peu de fondeurs proposent encore des solutions intégrant des mémoires non-conventionnelles. Et pour ICY Tech, incubée depuis le Centre de magnétisme appliqué de l’Université de Pékin, ce tape-out valide le passage de la recherche fondamentale à une application en silicium réel. Dans un marché saturé de NPUs, GPU compactes et accélérateurs propriétaires, cette différenciation par la mémoire peut peser, à condition de livrer un rapport performance/watt et un coût compétitifs.

Cette course aux puces spécialisées accompagne un débat plus large sur la dépendance technologique. Le développement du cloud européen face aux enjeux de souveraineté numérique et la montée des solutions d’IA locale partagent une même logique : réduire la dépendance à des infrastructures centralisées contrôlées par un petit nombre d’acteurs.

Les prochaines étapes seront décisives : échantillons, validations clients, analyse du rendement thermique, coûts de fabrication et feuille de route vers les volumes. Le tape-out ouvre la voie, mais la réussite commerciale se construit après, dans la durée.

Questions fréquentes

Qu’est-ce qu’un tape-out et pourquoi est-ce important ?

Le tape-out marque la fin de la phase de conception physique d’une puce : les fichiers sont envoyés à la fonderie pour fabrication. C’est une étape clé, mais elle ne garantit pas encore les performances réelles ni la viabilité commerciale à grande échelle.

Quelle est la différence entre l’eMRAM et la DRAM classique ?

L’eMRAM est non volatile : elle conserve les données sans alimentation, contrairement à la DRAM qui nécessite un rafraîchissement constant. Intégrée directement dans le SoC, elle réduit la consommation en veille et accélère le démarrage des appareils.

Que signifie la prise en charge de modèles jusqu’à 2 milliards de paramètres ?

Selon SEMIFIVE et ICY Tech, le SoC peut exécuter localement des modèles de cette taille, suffisants pour des tâches comme le résumé de texte, la traduction ou la conversation basique, sans connexion Internet.

Dans quels appareils cette technologie pourrait-elle être déployée ?

Les deux entreprises ciblent les AI PCs, les assistants privés en entreprise, la robotique humanoïde, les véhicules autonomes et les systèmes embarqués nécessitant une inférence locale fiable, sans connexion réseau permanente.

Quel est le rôle de Samsung Foundry dans ce projet ?

Samsung Foundry fournit le procédé de fabrication 8LPU (8 nm FinFET) utilisé pour réaliser le SoC. C’est également le développeur de la technologie eMRAM intégrée, qu’il positionne comme solution mémoire non volatile avancée pour les puces IA.

via : prnewswire