OpenAI a présenté le Privacy Filter, un nouveau modèle open weights conçu pour détecter et masquer les informations personnelles identifiables dans un texte avant que celui-ci ne soit indexé, enregistré ou alimenté à d’autres systèmes d’intelligence artificielle. La société le publie sous licence Apache 2.0 et leoriente vers des flux de nettoyage de données à haute performance, avec une idée centrale très claire : permettre aux entreprises d’effectuer le filtrage localement, sans avoir besoin d’envoyer le contenu sensible à des services externes.

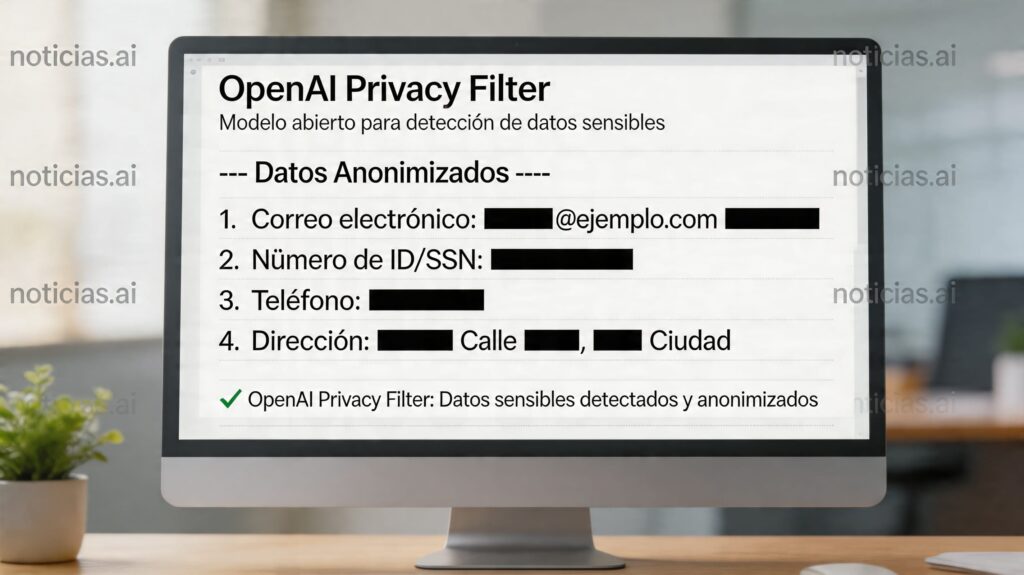

Cette nouveauté possède un potentiel considérable dans le domaine technologique car elle arrive à un moment où de nombreuses organisations développent des assistants internes, des pipelines d’observabilité, des systèmes RAG et des bases vectorielles qui traitent de grands volumes de texte. Dans tous ces cas, le même risque apparaît : si les données sensibles ne sont pas filtrées au préalable, des informations privées comme des noms, adresses, emails, numéros de téléphone, numéros de comptes ou clés API peuvent finir indexées ou réutilisées de manière inappropriée. OpenAI présente Privacy Filter comme une couche de protection préalable pour atténuer ce problème dès la source.

Un modèle compact, rapide et pensé pour la production

Contrairement à un LLM génératif traditionnel, Privacy Filter ne rédige pas de texte ni ne répond à des questions. C’est un modèle de classification binaire de tokens avec détection de spans, ce qui lui permet d’analyser une séquence complète en une seule passe et d’étiqueter quels fragments doivent être masqués. OpenAI affirme que cette conception améliore la vitesse et la performance opérationnelle par rapport à des approches plus encombrantes basées sur la génération de jetons une à une.

En termes de taille, il joue dans une autre catégorie. Selon la documentation publiée par OpenAI sur Hugging Face et GitHub, le modèle compte 1.500 milliards de paramètres au total, avec 50 millions de paramètres actifs. Son architecture suffisamment compacte permet une exécution « dans un navigateur web ou sur un ordinateur portable ». De plus, il supporte une fenêtre de contexte de 128 000 tokens, permettant de traiter des documents longs sans découpage constant. Pour des environnements d’entreprise où la latence et le coût comptent autant que la confidentialité, ce compromis entre taille et capacité peut être plus utile que le recours à un modèle beaucoup plus grand pour une tâche spécifique.

Un autre avantage pratique est que le modèle ne se limite pas à une simple correspondance par motifs rigides. OpenAI précise qu’il est conçu pour fonctionner avec du texte non structuré et prendre en compte des décisions dépendantes du contexte, ce qui est crucial lorsque la même chaîne peut être innocente dans un cas et très sensible dans un autre. Cette ambition le place un cran au-dessus de nombreuses outils traditionnels de détection de PII, qui reposent uniquement sur des expressions régulières ou des règles de format.

Ce qu’il détecte et pourquoi cela peut être utile avant un système RAG

Privacy Filter opère avec une taxonomie fermée de huit catégories : account_number, private_address, private_email, private_person, private_phone, private_url, private_date et secret. Concrètement, cela couvre tout, depuis les noms, adresses ou emails privés jusqu’aux numéros de compte, cartes, mots de passe ou clés API. En outre, la sortie utilise un schéma BIOES, facilitant une délimitation précise du début et de la fin de chaque fragment sensible plutôt que de renvoyer uniquement des correspondances isolées.

Ce détail revêt une importance particulière pour les déploiements réels. Par exemple, dans un système RAG, l’utilité principale d’un tel outil ne se limite pas à « masquer » du texte, mais à fonctionner en tant que garde-fou avant l’ingestion : si un secret ou un account_number est détecté, l’organisation peut bloquer le document ou le rediriger vers une revue humaine avant qu’il ne soit indexé dans une base vectorielle. OpenAI ne le désigne pas explicitement comme tel, mais indique clairement que le modèle est conçu pour les pipelines de formation, d’indexation, de journalisation et de revue, c’est-à-dire pour des couches en amont où le contrôle des données revêt une importance capitale.

En performance également, OpenAI affirme que Privacy Filter atteint un 96 % de F1 sur le benchmark PII-Masking-300k, avec un 94,04 % de précision et un 98,04 % de rappel. La société ajoute qu’en corrigeant certains problèmes de annotations rencontrés lors de l’évaluation, la note atteint 97,43 % de F1. Enfin, elle indique qu’un ajustement fin avec un petit volume de données peut bonifier considérablement ses performances dans des domaines spécifiques. Ces chiffres sont solides, mais il faut garder à l’esprit qu’il s’agit de résultats issus de leur propre évaluation, et que la performance réelle dépendra du dataset, de la langue et du contexte où il sera déployé.

L’importance de la nuance : ce n’est pas une anonymisation totale

Voici probablement l’aspect le plus crucial du lancement. Sur sa page officielle comme sur la fiche Hugging Face, OpenAI insiste sur le fait que Privacy Filter constitue une outil de rédaction et de minimisation des données, mais pas une solution d’anonymisation complète, pas une certification de conformité, ni pas une garantie de sécurité à lui seul. La société conseille de le considérer comme une couche supplémentaire dans une stratégie de privacy by design, et non comme une excuse pour supposer que tout risque est écarté.

Ce rappel est essentiel car anonymiser ne se limite pas à effacer des champs évidents. Dans de nombreux jeux de données, une personne peut être réidentifiée en combinant des dates, des localisations, un contexte professionnel ou des références croisées, même si les noms ou emails ont été supprimés. OpenAI ne fournit pas de détails juridiques précis à ce sujet, mais précise que le modèle ne détecte que ce qui entre dans sa taxonomie entraînée, et que diverses organisations devront peut-être appliquer des politiques plus strictes ou plus larges que celles par défaut.

Il est également utile de relativiser une idée souvent relayée depuis le lancement : Privacy Filter n’est pas présenté comme un modèle « natif en espagnol ». La fiche officielle sur Hugging Face et le dépôt GitHub indiquent que la langue principale est l’anglais, même si une certaine robustesse multilingue a été évaluée. OpenAI avertit que ses performances peuvent baisser pour des textes non en anglais, dans des écritures non latines ou dans des domaines éloignés du corpus d’entraînement. Bien qu’il puisse être utile en espagnol, le présenter comme optimisé spécifiquement pour cette langue serait une extrapolation non justifiée par la documentation officielle.

En définitive, cette sortie ouvre une voie intéressante : des modèles petits, spécialisés, auditable et pouvant s’exécuter localement pour des problématiques concrètes de production. Ils ne remplacent ni une politique de confidentialité, ni une revue juridique, ni une architecture sécurisée. Mais dans un écosystème où le traitement de très nombreux textes passe par des agents, vecteurs, logs ou flux automatiques, disposer d’un filtre léger et configurable avant l’indexation n’est plus un luxe, mais une étape logique dans la chaîne de traitement.

Questions fréquentes

Qu’est-ce que OpenAI Privacy Filter et à quoi sert-il ?

C’est un modèle ouvert de classification de tokens qui détecte et masque les informations personnelles identifiables dans un texte. Il est conçu pour être utilisé dans des pipelines de nettoyage de données, de revue, d’indexation, de logs et autres flux où il est préférable de bloquer ou de rédiger les données sensibles avant la poursuite du traitement.

Peut-on l’exécuter sans sortir les données de son ordinateur ?

Oui. OpenAI le présente comme un modèle pouvant fonctionner localement, et dont la taille permet de l’exécuter même dans un navigateur ou sur un ordinateur portable, de façon à ce que le texte sensible ne quitte pas le dispositif pour être filtré.

Quelles catégories de données sensibles détecte-t-il ?

Il repère huit types de spans : account_number, private_address, private_email, private_person, private_phone, private_url, private_date et secret.

Est-ce une anonymisation totale ou une garantie de conformité réglementaire ?

Non. OpenAI précise que Privacy Filter n’est pas une solution d’anonymisation ni une certification de conformité, ni une garantie de sécurité. Il doit s’intégrer dans une stratégie globale de protection de la vie privée et de révision, comme une couche supplémentaire.