Vingt milliards de dollars sur trois ans : c’est l’ampleur de l’investissement qu’OpenAI envisagerait de consacrer à des serveurs équipés de puces Cerebras, selon des informations publiées par The Information et reprises par plusieurs médias financiers anglo-saxons. Si ces chiffres ne sont pas encore officiellement confirmés, ce qui l’est sans équivoque, c’est la direction stratégique qu’OpenAI a choisie : diversifier son infrastructure matérielle pour s’affranchir d’une dépendance excessive à un seul fournisseur de GPU, et conquérir le marché de l’inférence à faible latence.

En janvier 2026, OpenAI et Cerebras ont officiellement annoncé un partenariat pluriannuel pour déployer 750 MW de puissance de calcul d’inférence à très faible latence, grâce aux systèmes wafer-scale de Cerebras. La montée en charge débutera progressivement en 2026. OpenAI a expliqué que cette capacité servirait à accélérer la réactivité de ses services dans des scénarios critiques : programmation assistée par l’IA, recherches complexes, génération d’images ou agents conversationnels temps réel.

Contexte et enjeux : pourquoi l’inférence est devenue le nouveau front

Pendant des années, la compétition dans l’intelligence artificielle s’est concentrée sur l’entraînement des grands modèles — une course aux GPU où NVIDIA détenait une position quasi monopolistique. Mais le marché est en train de se recentrer. Depuis 2025, l’enjeu majeur pour les acteurs comme OpenAI n’est plus uniquement de former des modèles toujours plus puissants, mais de les déployer efficacement à grande échelle : fournir des réponses à des centaines de millions d’utilisateurs avec une latence minimale et un coût maîtrisé.

C’est précisément sur ce segment que Cerebras s’est positionné. En parallèle, d’autres acteurs du silicium tentent également de s’imposer : des startups comme Nuvacore, fondée par d’anciens ingénieurs d’Apple, Nuvia et Qualcomm, illustrent cette course aux alternatives aux GPU traditionnels pour l’inférence IA. L’infrastructure IA de demain ne reposera plus sur une seule famille de puces.

Les faits : un partenariat qui dépasse l’achat de puces

L’accord annoncé en janvier couvre le déploiement de systèmes Cerebras CS-3 pour l’inférence. Mais selon The Information, l’opération globale envisagée serait d’une tout autre ampleur : plus de 20 milliards de dollars sur trois ans, incluant du financement pour des centres de données adaptés au matériel Cerebras, et potentiellement des warrants ou une prise de participation au capital de Cerebras. Ni OpenAI ni Cerebras n’ont officiellement validé ces éléments à la date de publication.

Ce contexte financier est éclairant : OpenAI a annoncé en mars 2026 une levée de fonds de 122 milliards de dollars en capital engagé, portant sa valorisation post-money à 852 milliards de dollars. La société a explicitement indiqué que ces ressources seraient mobilisées pour « accélérer la prochaine étape » de son infrastructure IA. Un investissement massif dans Cerebras s’inscrirait directement dans cette feuille de route.

Fait notable : Amazon Web Services (AWS) a également annoncé en mars 2026 un partenariat avec Cerebras pour déployer des systèmes CS-3 dans ses centres de données, accessibles via Amazon Bedrock. La configuration hybride retenue divise le travail entre AWS Trainium pour la phase de pre-fill et Cerebras CS-3 pour la phase de decode — une segmentation fonctionnelle qui traduit la maturité croissante du marché de l’inférence optimisée.

Analyse : Cerebras, une architecture radicalement différente

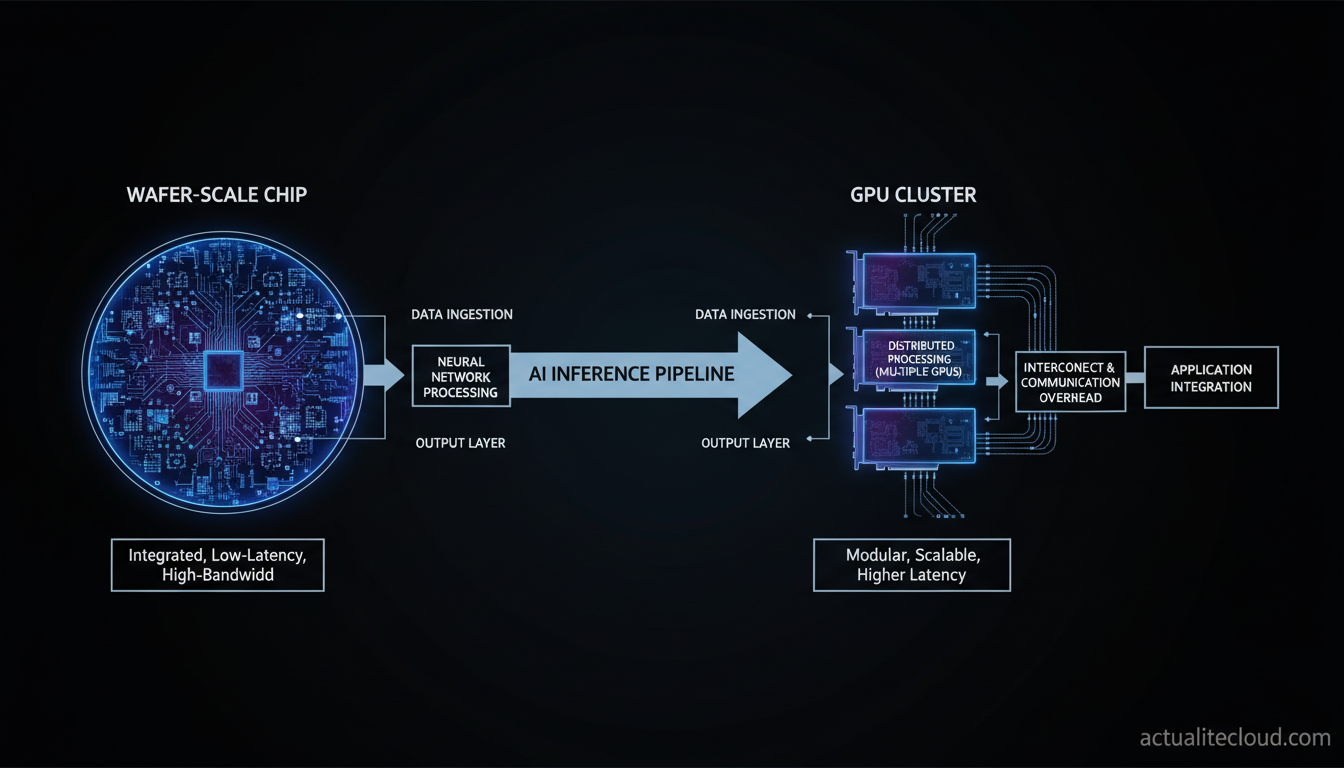

Pour comprendre pourquoi OpenAI et AWS s’intéressent à Cerebras, il faut comprendre ce qui distingue son architecture. Là où l’industrie a longtemps misé sur des clusters de centaines ou milliers de petits GPU interconnectés, Cerebras a opté pour une approche diamétralement opposée : fabriquer le processeur le plus grand possible sur une seule wafer.

Son WSE-3 (Wafer-Scale Engine 3) couvre 46 225 mm², intègre 4 billions de transistors et dispose de 900 000 cœurs optimisés pour l’intelligence artificielle, offrant 125 pétaflops de puissance de calcul dédiée. Cerebras le présente comme le plus grand processeur IA jamais conçu. L’avantage clé de cette architecture : l’élimination des goulots d’étranglement liés aux communications inter-GPU dans les clusters traditionnels, ce qui se traduit directement par des temps de réponse ultra-faibles pour l’inférence.

Pour OpenAI, dont les produits comme ChatGPT, Codex ou DALL-E exigent des réponses en quelques dizaines de millisecondes, cette promesse de latence réduite est un argument concurrentiel direct. Chaque milliseconde gagnée se traduit par une meilleure expérience utilisateur et, à terme, par un avantage face à des concurrents comme Google Gemini ou Anthropic Claude.

Implications stratégiques : vers une infrastructure IA hétérogène

L’accord OpenAI-Cerebras ne doit pas être lu comme une substitution de NVIDIA. Il s’agit d’une stratégie de diversification par workload : chaque type de charge de travail sera adressé par le matériel le plus adapté. Les GPU NVIDIA H100 et H200 resteront probablement dominants pour l’entraînement des grands modèles. Les puces Cerebras prendront en charge l’inférence à très faible latence. D’autres accélérateurs spécialisés (Trainium d’AWS, TPU de Google, Gaudi d’Intel) couvriront d’autres segments.

Cette évolution vers une infrastructure hétérogène est déjà visible dans les stratégies d’entreprise. Des éditeurs comme SAP, qui mobilise ses partenaires pour accélérer l’adoption de l’IA dans les processus d’entreprise, devront s’adapter à un paysage où les couches d’inférence seront de plus en plus diversifiées et spécialisées.

Pour NVIDIA, la menace n’est pas frontale à court terme — le géant de Santa Clara conserve une longueur d’avance considérable sur l’écosystème logiciel CUDA. Mais à mesure que l’inférence devient le cœur de la valeur créée par l’IA, des alternatives crédibles comme Cerebras pourraient éroder progressivement sa part dans les dépenses capex des hyperscalers.

Perspectives : Cerebras vers une introduction en bourse

Pour Cerebras, la portée de ce partenariat dépasse largement les revenus générés. La société a relancé son projet d’introduction en bourse aux États-Unis, un processus suspendu en 2024 après des questions soulevées par les autorités réglementaires. Avoir OpenAI comme client stratégique — et potentiellement comme actionnaire — représente une validation de marché majeure qui renforce considérablement son dossier auprès des investisseurs.

La dynamique est également symbolique : elle brise le récit d’un duopole AWS/NVIDIA qui aurait verrouillé le marché de l’infrastructure IA. L’entrée d’acteurs spécialisés comme Cerebras dans les déploiements des plus grands consommateurs d’IA ouvre la voie à une phase de diversification accélérée du marché des semi-conducteurs pour l’IA.

À plus long terme, la question est de savoir si Cerebras pourra tenir ses promesses à l’échelle industrielle. Déployer 750 MW de puissance de calcul d’inférence avec une technologie wafer-scale — une approche qui reste rare et complexe à produire en masse — est un défi manufacturier considérable. Les prochains trimestres seront déterminants pour valider la faisabilité opérationnelle de ce pari technologique. Les partenariats similaires dans le domaine de l’IA d’entreprise, comme celui de Celonis et Oracle pour l’intelligence des processus, montrent que les grandes alliances tech ne se matérialisent vraiment qu’à travers des déploiements concrets et mesurables.

Questions fréquentes sur OpenAI et Cerebras

OpenAI a-t-elle officiellement confirmé un investissement de 20 milliards dans Cerebras ?

Non. La seule annonce officielle concerne le partenariat de janvier 2026 pour déployer 750 MW de puissance de calcul d’inférence. Les 20 milliards de dollars, la prise de participation au capital et le financement de centres de données sont des informations rapportées par The Information qui n’ont pas encore été confirmées par OpenAI ou Cerebras à la date de publication.

Qu’est-ce qui différencie l’architecture Cerebras des GPU NVIDIA ?

Cerebras utilise une approche wafer-scale : son WSE-3 est fabriqué sur une wafer entière (46 225 mm²), intégrant 900 000 cœurs IA et 4 billions de transistors pour 125 pétaflops. Contrairement aux clusters GPU qui nécessitent des communications réseau complexes entre milliers de puces, le WSE-3 traite les calculs en interne, réduisant drastiquement la latence d’inférence.

Pourquoi OpenAI s’intéresse-t-elle à l’inférence à faible latence ?

Les produits d’OpenAI (ChatGPT, Codex, DALL-E, agents IA) nécessitent des réponses en quelques dizaines de millisecondes pour offrir une expérience utilisateur fluide. L’inférence à faible latence est un avantage concurrentiel direct face à Google Gemini, Anthropic Claude et d’autres. Cerebras vise précisément ce segment critique.

AWS est-il également partenaire de Cerebras ?

Oui. En mars 2026, Amazon Web Services a annoncé un accord pour déployer des systèmes Cerebras CS-3 dans ses centres de données, accessibles via Amazon Bedrock. La configuration combine AWS Trainium pour la phase de pre-fill et Cerebras CS-3 pour la phase de decode, optimisant chaque étape de l’inférence.

Ce partenariat menace-t-il réellement la position de NVIDIA ?

À court terme, non. NVIDIA conserve une dominance écrasante sur l’entraînement des modèles et bénéficie d’un écosystème logiciel CUDA très profond. Cependant, si l’inférence devient le principal poste de dépense capex des hyperscalers, des alternatives spécialisées comme Cerebras pourraient éroder progressivement la part de marché de NVIDIA sur ce segment spécifique.

Quand Cerebras va-t-elle entrer en bourse ?

Cerebras a relancé son projet d’IPO aux États-Unis après l’avoir suspendu en 2024. Aucune date officielle n’a été communiquée pour 2026. L’accord avec OpenAI renforce son dossier d’introduction, mais le calendrier dépendra également des conditions de marché et de l’avancement des déploiements techniques.