Nanya Technology aurait réussi à intégrer la chaîne d’approvisionnement en mémoire pour la prochaine plateforme d’intelligence artificielle NVIDIA Vera Rubin, selon des informations provenant de la filière taïwanaise de semi-conducteurs. Cette démarche revêt une importance particulière, car elle placerait le fabricant taïwanais au sein d’un des écosystèmes matériels les plus convoités du marché : les serveurs d’IA de nouvelle génération de NVIDIA, où la mémoire est devenue aussi stratégique que la GPU elle-même.

Bien que cette opération n’ait pas encore été confirmée officiellement par NVIDIA ni par Nanya dans les termes rapportés par les médias asiatiques, elle viserait des produits LPDDR5X destinés à la partie CPU de Vera Rubin. La plateforme associe la CPU Vera aux GPU Rubin, chaque bloc utilisant des types de mémoire différents : LPDDR5X pour la CPU et HBM4 pour les GPU. Cette segmentation explique pourquoi une société comme Nanya pourrait faire son entrée dans cet écosystème sans entrer en concurrence directe avec les grands fournisseurs d’HBM, dominés par Samsung, SK hynix et Micron.

LPDDR5X au cœur du serveur d’IA

La mémoire LPDDR est habituellement associée aux mobiles, aux ordinateurs portables légers et aux appareils où la consommation d’énergie est cruciale. Dans Vera Rubin, NVIDIA transpose ce type de mémoire au centre de données via SOCAMM, un format modulaire qui vise à combiner performance énergétique, capacité et facilité de maintenance par rapport à la mémoire soudée.

NVIDIA décrit la CPU Vera comme un processeur personnalisé à 88 cœurs Arm, conçu pour des charges d’IA hautement intensives, l’apprentissage par renforcement, l’orchestration et diverses tâches fortement dépendantes de la mémoire. La société indique que Vera peut gérer jusqu’à 1,5 TB de LPDDR5X avec un débit maximal de 1,2 TB/s. Dans la configuration Vera Rubin NVL72, la plateforme peut atteindre 54 TB de mémoire LPDDR5X par rack.

C’est ici que le rôle potentiel de Nanya entre en jeu. Selon les informations publiées en Asie, la société taïwanaise aurait été choisie comme fournisseur de mémoire LPDDR pour Vera Rubin, avec un soutien technique de TSMC pour l’intégration ou l’emballage. Si cela est confirmé, cela représenterait une étape symbolique et stratégique pour l’industrie taïwanaise de la mémoire, qui jusqu’à présent jouait un rôle plus limité dans les plateformes d’IA de NVIDIA face à ses concurrents sud-coréens et américains.

Il ne s’agit pas d’une mémoire secondaire ordinaire. Dans les architectures modernes d’IA, la CPU ne se contente pas d’accompagner la GPU. Elle gère les données, orchestre les flux, maintient les environnements logiciels, coordonne les tâches, prépare les charges et peut intervenir dans des parties critiques d’inférence, d’agents ou de simulations. Si la CPU manque de bande passante ou de capacité mémoire, l’efficacité globale du système en pâtit.

Vera Rubin modifie la pression sur la mémoire

Ce saut de Vera Rubin arrive dans un contexte mondial marqué par des tensions sur la DRAM, NAND, HBM et le stockage haute performance. La demande en IA a concentré les investissements dans la mémoire avancée, notamment HBM, tout en faisant pression sur les prix et la disponibilité d’autres types de DRAM. Dans ce contexte, NVIDIA doit diversifier ses fournisseurs et sécuriser ses capacités avant que la prochaine génération de serveurs ne passe à une production à grande échelle.

Le choix du LPDDR5X pour la CPU Vera répond à une logique technique : par rapport à la DDR traditionnelle, il offre une meilleure efficacité énergétique et un débit élevé dans un volume plus compact. Dans les racks d’IA où l’énergie et la refroidissement sont des limites réelles, réduire la consommation de mémoire par unité de capacité peut libérer des marges pour la puissance de calcul.

L’innovation SOCAMM a également une importance significative. NVIDIA souligne que ces modules facilitent la réduction de la consommation en apportant plus de facilité de maintenance et d’isolation en cas de panne. Contrairement à la mémoire soudée, un format modulaire permet des substitutions plus aisées, des configurations plus flexibles, et des cycles de maintenance mieux adaptés à l’environnement serveur.

| Élément de Vera Rubin | Mémoire associée | Rôle principal |

|---|---|---|

| CPU NVIDIA Vera | LPDDR5X via SOCAMM | Orchestration, contrôle, mémoire système et charges d’agents |

| GPU NVIDIA Rubin | HBM4 | Formation, inférence et calcul accéléré |

| Rack Vera Rubin NVL72 | LPDDR5X + HBM4 | Plateforme intégrée pour l’IA à l’échelle des centres de données |

Pour Nanya, pénétrer ce marché représente un changement de niveau. La société est connue principalement pour ses produits DRAM, DDR et LPDDR, mais la chaîne de valeur de l’IA a été largement dominée par quelques grands fournisseurs capables de répondre à des exigences techniques, volumes et certifications très stricts. La possibilité que ses LPDDR5X soient intégrés dans une plateforme comme Vera Rubin indiquerait une progression notable dans leur positionnement, ciblant des segments à valeur ajoutée plus élevée.

Taïwan consolide sa position dans la chaîne de l’IA

Taïwan occupe déjà une place centrale dans l’IA via TSMC, les fabricants de serveurs, cartes, alimentations, systèmes de refroidissement et assemblage. L’éventuelle intégration de Nanya ajoute un autre maillon : la mémoire principale pour plateformes d’IA. Si ce n’est pas aussi dominant que le HBM, cela renforce néanmoins la présence taïwanaise dans un secteur où la Corée du Sud et les États-Unis ont historiquement pèsé davantage.

Ce mouvement possède aussi une dimension géopolitique. NVIDIA dépend d’une chaîne mondiale très intégrée : TSMC fabrique ses puces, la mémoire HBM provient de grands fournisseurs internationaux, l’assemblage et le déploiement se font par des fabricants asiatiques. Dans un marché marqué par la pénurie, l’ajout de tout fournisseur capable d’assurer la production réduit les risques d’approvisionnement et accroît la négociabilité.

Les analystes indiquent aussi que cette décision a suscité un regain d’intérêt boursier pour les entreprises taïwanaises de mémoire. Bien que compréhensible, il faut rester prudent. Entrer dans la chaîne d’approvisionnement de NVIDIA ne garantit pas immédiatement de volumes importants. Les plateformes d’IA comportent des phases de validation, des rampes de production et des révisions techniques, dépendant de la disponibilité globale de l’architecture finale.

Le fond est clair : la prochaine génération d’IA ne se limite pas aux GPUs. La mémoire est devenue un goulet d’étranglement technique, économique et stratégique. Si la HBM domine actuellement la conversation car elle alimente directement les accélérateurs, d’autres solutions comme le LPDDR5X, SOCAMM, SSD haute performance ou réseaux à faible latence jouent un rôle essentiel dans l’ensemble du système. Sans cette base robuste, les modèles ne s’entraînent ni ne s’exécutent avec l’efficience attendue.

Nanya pourrait saisir cette opportunité pour repositionner son activité. Avec une montée en gamme, des qualités de fiabilité et des coûts compétitifs, elle pourrait ouvrir de nouvelles portes dans d’autres architectures serveurs, CPU pour l’IA, modules compacts ou plateformes où l’efficience énergétique prime sur la mémoire classique. L’IA redessine la carte des fournisseurs, et tous ne seront pas ceux qui dominaient la mémoire depuis une décennie.

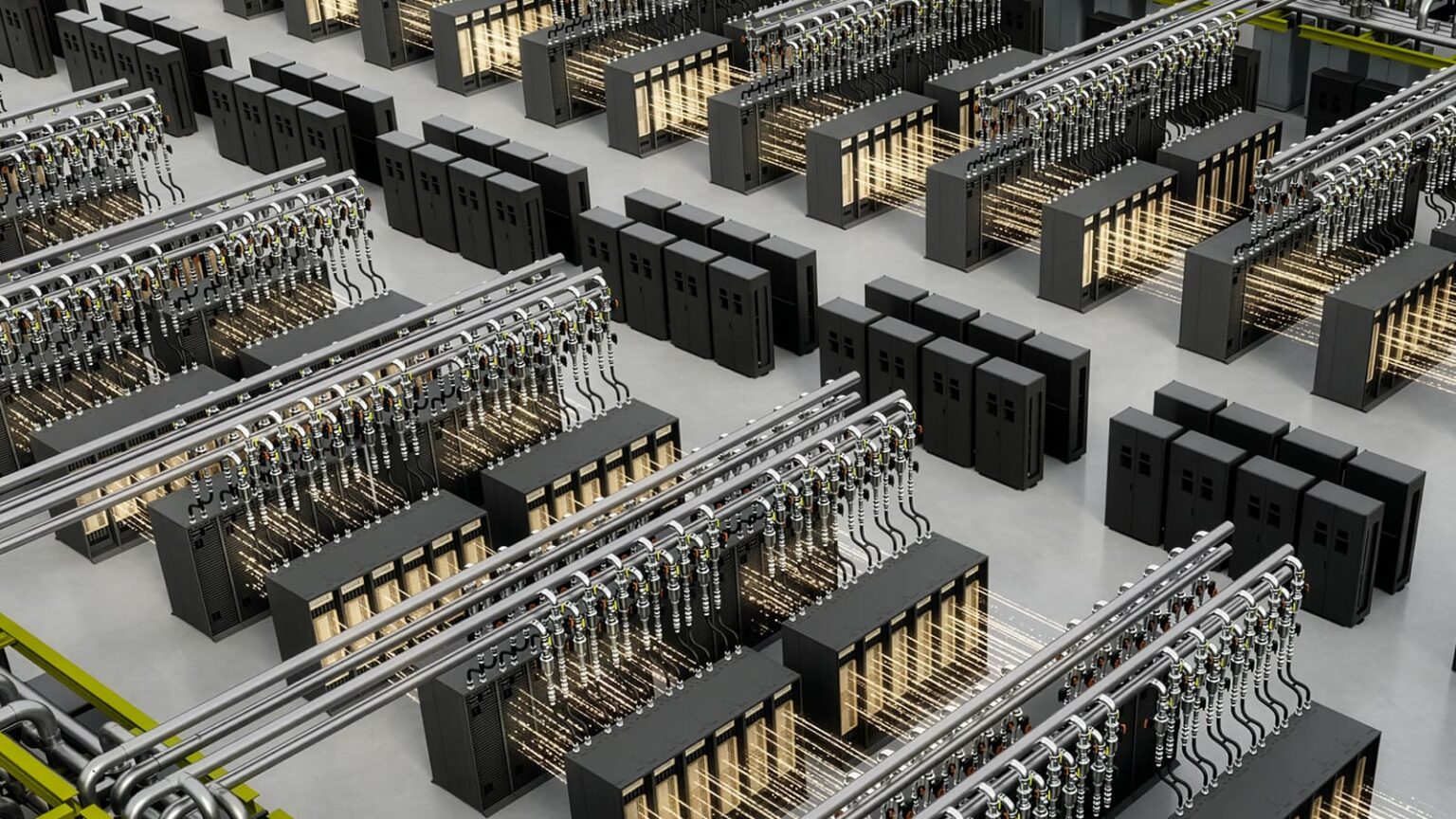

Cette actualité souligne aussi la portée plus large : NVIDIA ne vend pas uniquement des GPU. Elle construit des plateformes complètes, intégrant CPU, GPU, mémoire, réseaux, interconnexions, logiciels et racks. Entrer dans cette chaîne signifie s’inscrire dans une architecture capable de fixer le rythme des datacenters d’IA dans les années à venir.

Questions fréquentes

Que aurait obtenu Nanya Technology ?

Nanya aurait intégré la chaîne d’approvisionnement en mémoire LPDDR pour la plateforme NVIDIA Vera Rubin, selon des informations issues des supply chains publiées en Asie.

Quel type de mémoire utilise NVIDIA Vera Rubin ?

La CPU Vera utilise de la LPDDR5X via SOCAMM, tandis que les GPU Rubin emploient de la mémoire HBM4 pour des charges de hautes performances en IA.

Pourquoi la LPDDR5X est-elle importante pour les serveurs d’IA ?

Parce qu’elle combine grande capacité et haut débit avec une consommation moindre par rapport aux configurations classiques, un avantage crucial dans les racks d’IA où énergie, espace et refroidissement sont limitants.

NVIDIA a-t-elle confirmé officiellement Nanya comme fournisseur ?

Aucune confirmation publique officielle n’a été faite par NVIDIA ou Nanya dans les termes reportés par la presse. Les informations proviennent de sources de la chaîne d’approvisionnement et doivent être considérées avec prudence.