La mémoire est devenue l’un des principaux goulets d’étranglement de l’intelligence artificielle. Pendant des années, l’attention s’est portée sur les GPU, les accélérateurs et les grands clusters de calcul, mais la performance réelle de nombreux systèmes dépend de plus en plus de la rapidité avec laquelle ils peuvent déplacer les données. C’est là que la mémoire HBM est devenue presque indispensable pour former et exécuter des modèles avancés. C’est également dans ce contexte qu’Intel et SAIMEMORY, filiale de SoftBank, cherchent à ouvrir une voie alternative avec ZAM, une nouvelle architecture de mémoire 3D à haut débit.

ZAM, abréviation de Z-Angle Memory, n’est pas encore un produit commercial ni une mémoire prête à intégrer les serveurs des hyperscalers. C’est une technologie en développement, avec des ambitions claires : offrir plus de bande passante, une densité accrue et une consommation moindre par rapport aux solutions actuelles basées sur la HBM. La présentation technique prévue lors du symposium VLSI 2026 a fourni suffisamment de données pour que le secteur commence à s’y intéresser, mais avec prudence. Une chose est de démontrer une architecture avancée en laboratoire, une autre de la produire en volume, à un coût compétitif et avec une fiabilité industrielle.

Ce que propose ZAM face à la mémoire HBM

La HBM domine actuellement le segment des mémoires haute performance car elle permet de placer des piles de DRAM très proches du processeur ou de l’accélérateur, avec une interface extrêmement large. C’est une solution coûteuse et complexe, mais elle répond très bien aux besoins de l’intelligence artificielle et du calcul haute performance. La norme HBM4, déjà publiée, atteint jusqu’à 2 To/s par pile et jusqu’à 64 Go de capacité par empilement dans ses configurations maximales.

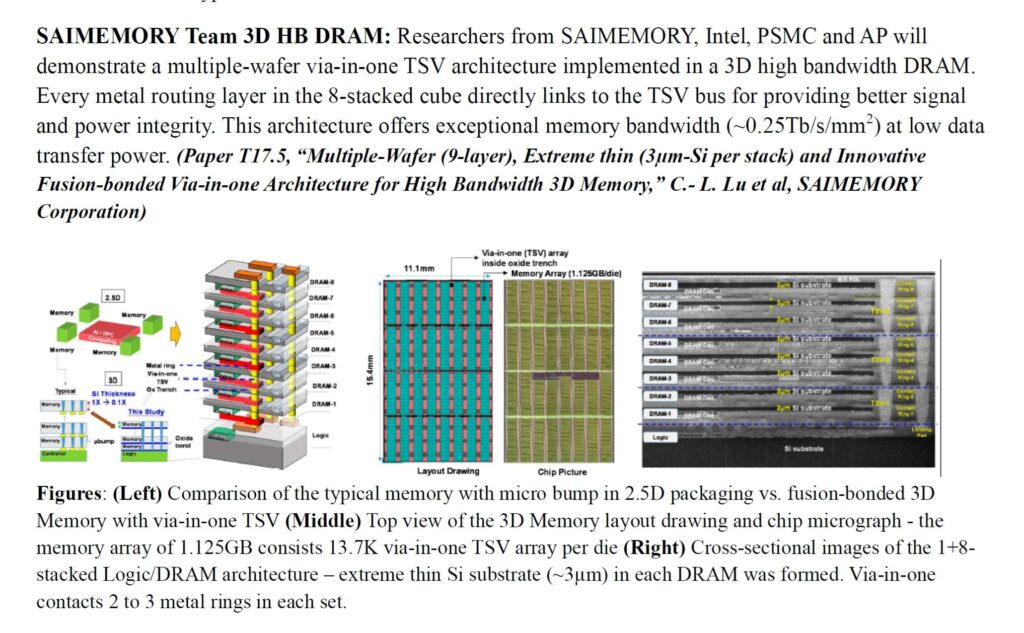

La proposition de ZAM cherche à aborder le même problème avec une architecture différente. Selon la documentation technique du symposium VLSI, des chercheurs de SAIMEMORY, Intel, PSMC et AP Memory présenteront une mémoire DRAM 3D à haut débit basée sur une structure multi-wafer, avec une architecture via-in-one TSV et union par fusion. Le design consiste à connecter chaque couche métallique du cube empilé de huit couches directement au bus TSV, dans le but d’améliorer l’intégrité du signal et l’alimentation électrique.

Ce qui est le plus frappant, c’est la densité de bande passante : environ 0,25 Tb/s/mm² avec une faible consommation lors du transfert de données. La documentation visuelle de la présentation compare également l’empilement 2.5D traditionnel utilisant des micro-bumps avec une mémoire 3D jointe par fusion via-in-one TSV. Le schéma illustre une architecture 1+8, avec une logique de base et huit couches de DRAM, des substrats en silicium extrêmement fins d’environ 3 µm par couche, et une matrice de 13 700 TSV par die.

Les chiffres circulant autour de ZAM suggèrent une performance pouvant doubler le débit de HBM4 dans certaines configurations. Il faut toutefois analyser cette comparaison avec soin. La donnée consolidée dans le résumé technique concerne la densité de bande passante de l’architecture, et non une spécification commerciale définitive. Pour que ZAM puisse être comparée équitablement à HBM4 ou HBM4E, il faudra connaître la capacité finale, la performance soutenue, la consommation réelle, le coût de fabrication, la performance par wafer et le comportement thermique en systèmes complets.

| Technologie | Statut | Bande passante citée | Capacité citée | Défi principal |

|---|---|---|---|---|

| HBM4 | Norme publiée | Jusqu’à 2 To/s par pile | Jusqu’à 64 Go par pile | Coût, approvisionnement et complexité de l’emballage |

| ZAM | Développement et démonstration technique | ~0,25 Tb/s/mm² en densité | Données encore non finalisées en tant que produit | Production en volume et validation en systèmes réels |

Une démarche industrielle, pas seulement une communication technique

La collaboration entre Intel et SAIMEMORY ne sort pas de nulle part. SoftBank a annoncé en février 2026 que sa filiale avait signé un accord avec Intel pour faire progresser la commercialisation de ZAM comme une technologie de nouvelle génération orientée vers une haute capacité, un haut débit et une faible consommation. Le plan communiqué prévoit des prototypes durant l’exercice clôturant le 31 mars 2028, avec une possible commercialisation dès l’année fiscale 2029.

Ce calendrier situe ZAM dans une optique de moyen terme. La technologie ne concurrence pas encore les HBM3E actuelles ni les premières versions de HBM4 qui commenceront à arriver prochainement. Son créneau naturel serait plus proche de la prochaine étape de l’infrastructure en intelligence artificielle, lorsque les systèmes nécessiteront non seulement davantage de calculs, mais aussi plus de mémoire par accélérateur et moins d’énergie par bit transféré.

Intel apporte dans cette démarche une part importante d’expertise en emballage avancé, en interconnexion et en technologies d’union de DRAM. De son côté, SoftBank cherche à renforcer sa position dans l’infrastructure d’intelligence artificielle depuis le Japon, non seulement comme investisseur, mais aussi comme moteur de technologies fondamentales. SAIMEMORY a été créée en décembre 2024 pour travailler sur la mémoire de nouvelle génération, un projet en phase avec la stratégie japonaise de regagner du poids dans les semiconducteurs avancés.

Un enjeu géopolitique n’est pas non plus à négliger. La chaîne d’approvisionnement de la HBM est très concentrée et dépend de quelques fabricants, principalement SK hynix, Samsung et Micron. Pour des entreprises investissant des milliards dans des centres de données d’IA, toute alternative susceptible de réduire la dépendance, la consommation ou le coût mérite une attention particulière. ZAM n’aurait pas besoin de faire disparaître le marché de la HBM pour être pertinent : il suffirait qu’elle devienne une option viable dans certains designs d’accélérateurs, serveurs ou systèmes HPC.

Le grand défi sera de fabriquer ZAM à l’échelle

La partie la plus prometteuse de ZAM réside dans son architecture verticale. En réduisant les distances internes et en utilisant des vias TSV intégrés de manière plus directe, cette technologie promet de déplacer les données avec moins d’énergie et d’améliorer la dissipation thermique par rapport à certaines limitations des piles HBM classiques. Cette promesse est particulièrement importante dans les centres de données, où la consommation électrique, la gestion du refroidissement et la densité par rack conditionnent déjà le déploiement de nouveaux clusters.

Mais l’histoire des semi-conducteurs est ponctuée de technologies brillantes qui ont mis des années avant d’atteindre une production à grande échelle ou qui n’ont finalement jamais été rentables. Le packaging 3D, les unions par fusion, l’amincissement extrême des wafers et la validation de milliers d’interconnexions par couche ne sont pas des tâches anodines. La fiabilité à long terme, la réparation des défauts, la performance en fabrication et la compatibilité avec des contrôleurs et accélérateurs réels seront tout aussi cruciaux que le débit maximal.

Un débat subsiste également sur l’éventuel recours à des nœuds de fabrication matures pour la partie DRAM, notamment en raison de la participation de PSMC. Certains évoquent l’idée que ZAM pourrait s’appuyer sur des processus moins avancés que ceux utilisés pour les mémoires HBM les plus récentes, en compensant cette différence par une architecture et un emballage innovants. Pour l’instant, ce point relève de la spéculation : le résumé technique publié confirme l’architecture, les TSV, l’empilement et les métriques de bande passante par surface, mais ce n’est pas encore une lecture industrielle complète.

La lecture la plus réaliste est que ZAM ouvre une nouvelle voie dans le segment de la mémoire pour l’intelligence artificielle, sans pour autant détrôner la HBM pour l’instant. La HBM bénéficie déjà de normes établies, de fournisseurs solides, de clients, de conceptions en cours, ainsi qu’une présence bien établie dans les offres de NVIDIA, AMD, Google, Intel et autres fabricants d’accélérateurs. ZAM doit encore faire ses preuves pour passer d’une architecture prometteuse à un composant fabriqué, intégrable et compétitif.

Si elle y parvient, l’impact pourrait être significatif. Plus d’alternatives à mémoire à haut débit atténueraient une partie de la pression sur le marché des accélérateurs IA, favoriseraient de nouvelles architectures de puces et pourraient réduire la consommation d’énergie liée au transfert massif de données. À l’inverse, même si ZAM ne s’impose pas immédiatement, elle aura permis de tirer le secteur vers des architectures mémoire plus ambitieuses. En définitive, le message est clair : la prochaine bataille de l’intelligence artificielle ne se jouera pas uniquement au niveau des cœurs de calcul, mais également au niveau de la mémoire qui les alimente.

Questions fréquentes

Qu’est-ce que ZAM ?

ZAM, ou Z-Angle Memory, est une technologie de mémoire 3D de nouvelle génération développée par SAIMEMORY en collaboration avec Intel. Elle vise à offrir un haut débit, une capacité importante et une faible consommation pour les systèmes d’intelligence artificielle et de calcul haute performance.

ZAM remplacera-t-elle la HBM ?

Il est encore tôt pour le confirmer. ZAM a pour objectif de concurrencer la HBM à terme, mais la HBM est déjà standardisée, dispose de fabricants établis et est intégrée dans les accélérateurs actuels et à venir. ZAM doit encore démontrer une fabrication à grande échelle et une utilisation dans des systèmes commerciaux.

Quand ZAM pourrait-elle arriver sur le marché ?

SoftBank et SAIMEMORY évoquent des prototypes pour l’année fiscale 2027, qui se termine le 31 mars 2028, avec une commercialisation potentielle dès l’année fiscale 2029. Ce calendrier pourra évoluer en fonction des avancées techniques et industrielles.

Pourquoi cette technologie est-elle importante pour l’IA ?

Les modèles avancés nécessitent de déplacer d’énormes volumes de données entre la mémoire et les accélérateurs. Une mémoire avec davantage de bande passante et une consommation moindre peut améliorer les performances, réduire la dépense énergétique, et permettre des systèmes plus denses dans les centres de données.