Google Cloud et NVIDIA ont renforcé leur partenariat afin de déployer la prochaine génération de GPU Vera Rubin dans l’infrastructure AI Hypercomputer de Google. L’annonce concerne la famille d’instances bare metal A5X, conçue pour des charges de travail en intelligence artificielle agéntique et physics, avec une promesse d’échelle impressionnante : jusqu’à 80 000 GPUs NVIDIA Rubin dans un seul centre de données et jusqu’à 960 000 GPUs réparties sur plusieurs sites.

Ce chiffre ne signifie pas que chaque client pourra simplement appuyer sur un bouton pour réserver presque un million de GPUs en une seule fois. Il illustre plutôt la direction que prend l’infrastructure IA des grands fournisseurs cloud : des systèmes capables de relier chips, réseau, stockage et logiciel d’orchestration afin que des modèles de plus en plus complexes puissent être entraînés, affinés et déployés avec un minimum de goulots d’étranglement. Google présente cela comme une extension de son AI Hypercomputer, basé sur la même technologie que Gemini, ses services IA pour entreprises et usages grand public.

A5X : l’engagement de Google pour Rubin dans son AI Hypercomputer

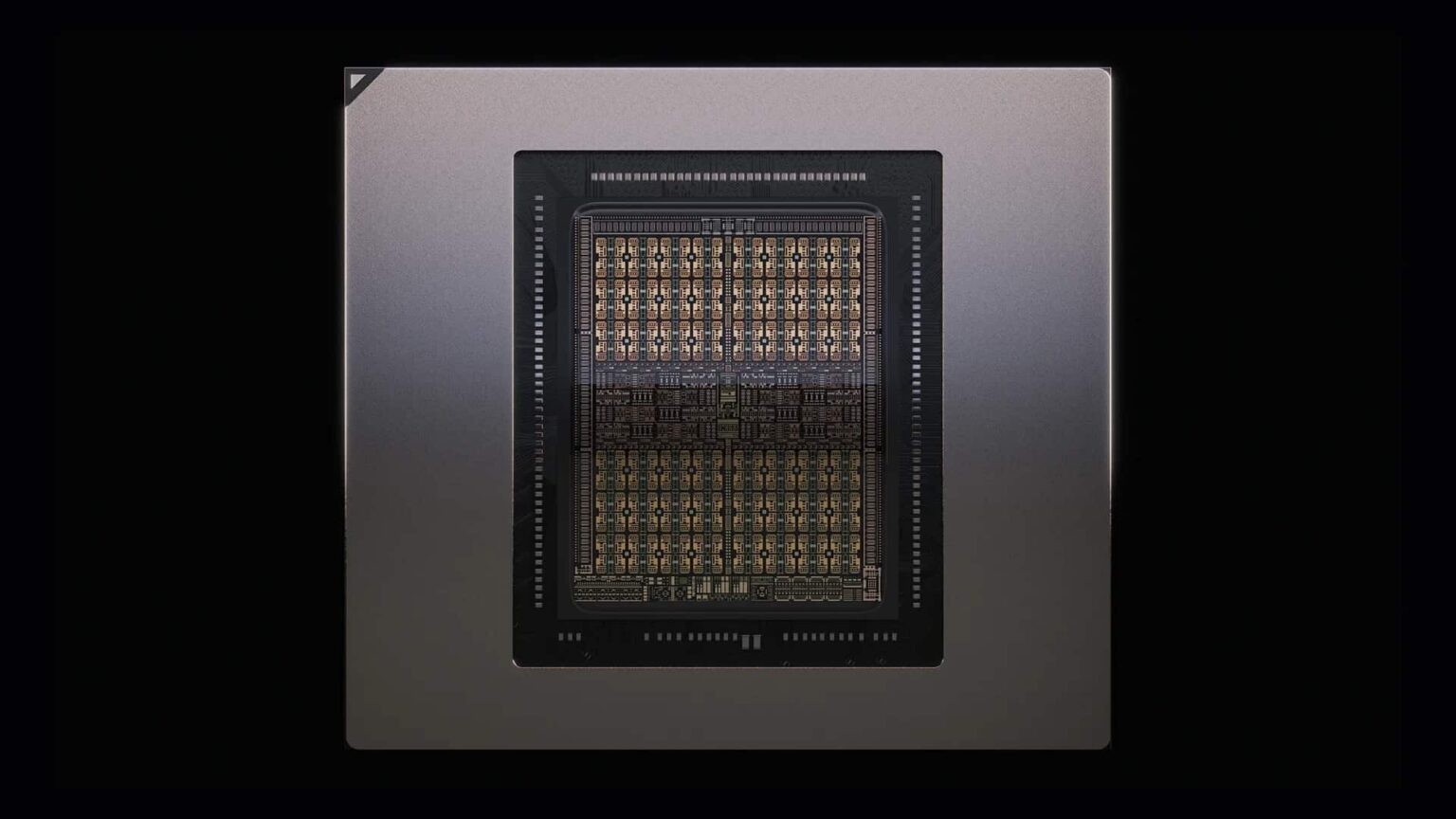

La famille A5X sera basée sur la plateforme NVIDIA Vera Rubin NVL72, architecture nouvelle génération de NVIDIA pour des systèmes AI à l’échelle rack. Google affirme qu’elle sera parmi les premiers fournisseurs à proposer des instances basées sur Vera Rubin une fois la plateforme disponible courant 2026. La précision est essentielle : il ne s’agit pas d’un déploiement déjà opérationnel, mais d’une infrastructure annoncée pour la prochaine phase d’expansion de Google Cloud.

L’approche d’A5X répond à une réalité de plus en plus visible sur le marché. Les charges de travail IA ne se limitent plus à l’entraînement de grands modèles. L’inférence à grande échelle, les agents exécutant des tâches, les flux de raisonnement, l’ajustement des modèles et l’IA physique pour la robotique ou les jumeaux numériques exigent des architectures plus flexibles. Avoir de nombreuses GPUs ne suffit pas : il faut les relier avec une faible latence, alimenter les systèmes en données, redémarrer les tâches en cas de panne de nœuds et maintenir une utilisation optimale pour que l’investissement ait du sens.

NVIDIA indique qu’A5X, en combinant Vera Rubin NVL72, ConnectX-9 SuperNICs et le réseau Virgo de Google, pourra offrir jusqu’à 10 fois moins de coût d’inférence par token et jusqu’à 10 fois plus de performance de tokens par mégawatt par rapport à la génération précédente. Ces chiffres, issus du fournisseur, doivent être considérés comme des estimations de performance dans des scénarios concrets, mais ils soulignent un enjeu réel : l’IA ne se résume plus à la précision, mais aussi au coût opérationnel et à l’efficacité énergétique.

Google intègre également des concepts issus du protocole réseau Falcon, développé avec NVIDIA via l’Open Compute Project. L’objectif est d’améliorer la fiabilité du transport de données dans des réseaux conçus pour des clusters IA où une perte d’efficacité marginale peut s’amplifier lorsque des dizaines de milliers d’accélérateurs sont impliqués.

Virgo et ConnectX-9 : le réseau comme élément central

Le chiffre de 960 000 GPUs est impressionnant, mais la clé technique réside dans le réseau. Google Virgo Network est la solution d’interconnexion utilisée pour faire évoluer la charge IA à l’échelle du centre de données et entre plusieurs sites. Avec ses TPU de huitième génération, Google affirme que Virgo peut relier 134 000 TPU dans un seul centre et plus d’un million entre plusieurs emplacements. Dans le cas d’A5X, cette technologie s’étend à la plateforme Vera Rubin NVL72 de NVIDIA, avec les limites annoncées de 80 000 GPUs en un seul site et 960 000 dans des déploiements multi-sites.

Un tel niveau d’échelle change la dynamique du problème. Sur de petits clusters, on se concentre souvent sur la performance de chaque GPU. Sur des clusters géants, les contraintes majeures concernent la communication entre nœuds, la synchronisation lors de l’entraînement, l’accès au stockage, la récupération après panne ou la répartition efficace des charges. C’est pourquoi NVIDIA et Google insistent autant sur la synergie entre GPU, NIC, réseau, logiciel et services managés.

ConnectX-9 SuperNIC est la pièce de NVIDIA conçue pour accélérer la communication réseau dans les infrastructures cloud via Ethernet. Son rôle est de réduire la pénalité liée à la répartition des charges IA sur plusieurs serveurs. Virgo, quant à lui, fournit la couche d’intégration de Google pour relier cette capacité dans son AI Hypercomputer. L’objectif est de faire voir aux clients chaque centre de données comme une partie intégrante d’un système global plus vaste.

La stratégie montre aussi que Google ne souhaite pas choisir entre ses propres TPU et les GPUs NVIDIA. La société renforce ses puces internes, comme TPU 8t pour l’entraînement et TPU 8i pour l’inférence et l’apprentissage par renforcement, tout en élargissant son offre avec NVIDIA. Pour les clients, cette combinaison présente un avantage : certains modèles ou frameworks seront plus adaptés aux TPU, d’autres aux GPU, et beaucoup préféreront continuer à utiliser CUDA, les bibliothèques NVIDIA et les écosystèmes éprouvés.

L’intelligence artificielle agéntique : plus que des accélérateurs

Google Cloud a présenté ces innovations dans un contexte plus large d’infrastructure orientée vers la « société agéntique ». Outre A5X et Virgo, la société a annoncé de nouvelles machines équipées de CPUs Axion basés sur Arm, le support natif de PyTorch pour TPU, des améliorations sur Google Kubernetes Engine, de nouveaux services de stockage haute performance, ainsi que des capacités pour accélérer le démarrage des nœuds et des pods.

Sur le plan technique, la conclusion est claire : les agents IA ne résident pas uniquement dans le modèle. Ils doivent exécuter des appels à des outils, accéder à des bases de données, coordonner des tâches, conserver du contexte, évaluer des réponses, traiter du code, récupérer des documents et répondre avec une latence faible. Les GPUs ou TPU sont indispensables pour le cœur du modèle, mais une couche composée de CPU, réseau, stockage et orchestration peut faire toute la différence entre une démo spectaculaire et un service déployé en production.

Google le souligne en mettant en avant ses instances Axion N4A pour runtimes d’agents, calculs de récompense, orchestration et tâches auxiliaires. La société a aussi amélioré GKE pour accélérer le démarrage des nœuds et des pods, et a introduit un Inference Gateway avec routage prédictif pour réduire la latence jusqu’au premier token. Dans une application IA conversationnelle, cette latence peut impacter directement l’expérience utilisateur.

Le stockage, souvent moins visible, joue un rôle critique. Google Cloud Managed Lustre voit son débit augmenter jusqu’à 10 To/s et sa capacité atteindre 80 pétaoctets, selon Google. De plus, Rapid Buckets dans Google Cloud Storage facilite la gestion des checkpoints et la récupération d’entraînement à latence très faible. Si les données n’arrivent pas à temps, les accélérateurs coûteux doivent attendre, ralentissant tout le processus.

Google et NVIDIA : une collaboration plus qu’une compétition

Ce lancement intervient à un moment où Google renforce activement ses TPU, tandis que NVIDIA continue de dominer largement le marché des accélérateurs IA. De surface, cela peut sembler contradictoire : Google concurrence NVIDIA sur les chips spécialisés, tout en étant fortement dépendant de GPUs NVIDIA, nécessaires pour la compatibilité logicielle et l’écosystème CUDA, largement implanté dans le logiciel d’entreprise IA.

NVIDIA profite également de sa présence dans l’une des plus grandes plateformes cloud mondiales : Google Cloud. La plateforme cloud de Google offre des clients, des centres de données, des réseaux, des services managés, de la sécurité, Kubernetes, du stockage et une couche d’intégration d’entreprise facilitant la mise en production des modèles IA. Pour NVIDIA, vendre du hardware seul ne suffit plus : il est crucial que ses plateformes s’intègrent dans des architectures complètes d’IA.

La collaboration couvre aussi Gemini dans Google Distributed Cloud sur GPUs Blackwell et Blackwell Ultra, avec des machines sécurisées équipées de NVIDIA Blackwell et l’utilisation de modèles Nemotron et de frameworks comme NeMo dans des plates-formes d’agents. NVIDIA n’est donc pas seulement un fournisseur de puces, mais aussi partie intégrante de la pile logicielle utilisée pour développer des agents, simulations, robotics ou applications industrielles.

La perspective de clusters approchant le million de GPUs peut sembler énorme, mais l’essentiel est plus pragmatique : la prochaine étape de l’IA ne dépendra plus uniquement de la puissance brute d’un seul chip, mais de la capacité à combiner efficacement accélérateurs, réseaux, stockage, logiciels et énergie. Google et NVIDIA cherchent à démontrer qu’une telle échelle peut être déployée sous forme de service cloud.

Pour les clients, A5X pourrait devenir une option clé pour entraîner des modèles massifs, fournir une inférence à grande échelle ou déployer des agents complexes nécessitant des performances extrêmes. Sur le marché, cela témoigne de l’entrée de l’IA dans une phase d’infrastructure extrême, où les déploiements se mesurent en centaines de milliers, voire en millions, d’accélérateurs, chaque token généré étant soutenu par une architecture industrielle de plus en plus sophistiquée.

Questions fréquentes

Qu’est-ce que Google Cloud A5X ?

A5X est une nouvelle famille d’instances bare metal de Google Cloud, basée sur NVIDIA Vera Rubin NVL72, conçue pour les charges d’IA agéntique, l’inférence massive, l’entraînement et les applications de physique IA.

Combien de GPUs A5X pourra-t-elle scaler ?

Google et NVIDIA évoquent jusqu’à 80 000 GPUs NVIDIA Rubin dans un seul centre et 960 000 GPUs réparties entre plusieurs sites.

La famille A5X est-elle déjà disponible ?

Google indique que A5X sera basée sur NVIDIA Vera Rubin NVL72 lorsque cette plateforme sera déployée courant 2026. Il s’agit donc d’une capacité annoncée pour la prochaine génération d’infrastructures.

Pourquoi Google utilise-t-il à la fois ses TPUs et des GPUs NVIDIA ?

Parce que de nombreux clients ont besoin de GPUs NVIDIA pour leur compatibilité, leur performance et leur écosystème logiciel. Google combine ses TPUs et GPUs NVIDIA pour offrir plus de flexibilité selon le type de charge de travail IA.