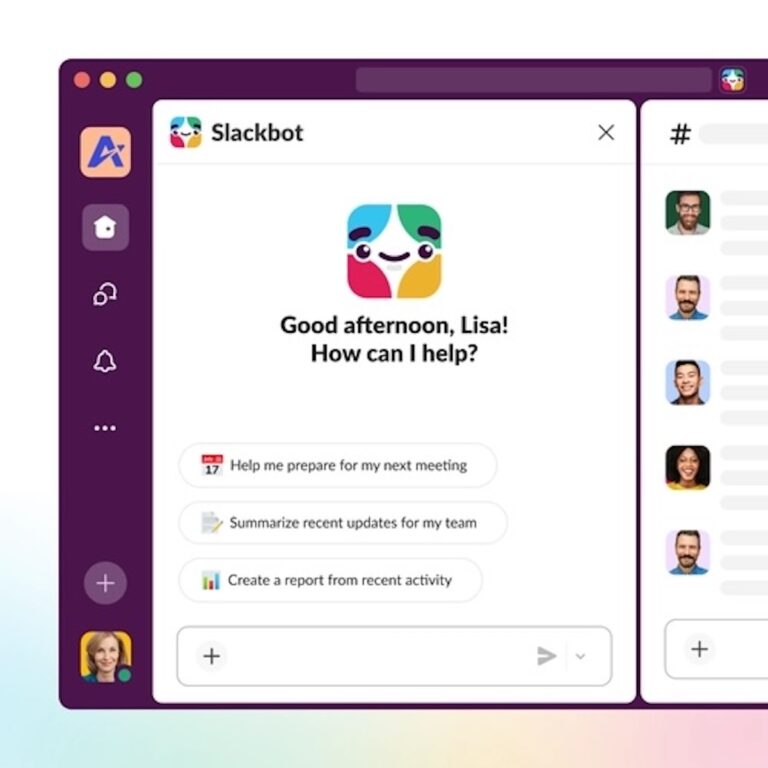

Slackbot devient agent IA personnel : Slack réinvente son assistant

Slack transforme Slackbot en agent IA personnel capable de retrouver des décisions perdues, résumer des conversations et automatiser des tâches. Intégration dans la stratégie Agentforce de Salesforce. Combinaison de modèles IA sans dépendance à un seul fournisseur. Données privées : non utilisées pour l’entraînement. Cette tendance d’agents IA spécialisés rejoint Autoskills pour les compétences IA adaptées au stack et Cloudflare Agent Cloud pour l’infrastructure agents IA. Questions fréquentes Que fait le nouveau Slackbot ?Retrouve décisions, résume conversations, répond à questions contextuelles, automatise tâches. Lié à Salesforce ?Oui, intégré dans la stratégie Agentforce de Salesforce. Données privées ?Non utilisées pour entraîner les modèles, restent dans le périmètre de l’organisation.