En 2026, le débat virtualisation versus conteneurs n’est toujours pas tranché — et c’est précisément parce qu’il n’a pas à l’être. Les deux technologies coexistent dans la grande majorité des architectures cloud modernes, chacune répondant à des contraintes spécifiques que l’autre ne peut pas satisfaire. Pourtant, les équipes IT continuent de se heurter à la même question : quand choisir l’une plutôt que l’autre, et comment des services comme exe.dev s’inscrivent-ils dans ce paysage ?

La réponse ne tient pas en une formule simple. Elle dépend du type de charge, du niveau d’isolement requis, de la maturité opérationnelle de l’équipe et des contraintes économiques du projet. Ce qui a changé en 2026, c’est l’émergence d’un troisième vecteur : les environnements d’exécution d’agents d’intelligence artificielle, qui imposent de nouvelles exigences à la fois en termes d’isolement et de persistance.

Contexte et enjeux : pourquoi le choix d’infrastructure reste stratégique

L’infrastructure sous-jacente détermine directement le TCO d’une plateforme, la vitesse de déploiement des équipes et les risques de sécurité acceptés. En 2026, selon les dernières analyses de Gartner, plus de 85 % des nouvelles applications d’entreprise sont déployées dans des environnements cloud ou hybrides — et la question n’est plus « cloud ou on-premise » mais « quelle couche d’abstraction choisir ».

La virtualisation traditionnelle reste dominante dans les datacenters on-premise et les clouds publics de première génération. Les hyperviseurs comme VMware ESXi, Microsoft Hyper-V ou les alternatives open source comme Proxmox VE — qui suscite un intérêt croissant depuis la montée des coûts Broadcom — gèrent des dizaines de milliards d’euros d’actifs IT dans le monde. La conteneurisation, portée par Kubernetes et l’écosystème cloud-native, s’est imposée dans le développement applicatif moderne.

Le marché global de la virtualisation dépassait 11,5 milliards de dollars en 2025, avec une croissance annuelle de 8 %. Celui des conteneurs et de l’orchestration progressait à plus de 25 % par an. Ces chiffres illustrent une réalité : les deux marchés croissent simultanément, ce qui confirme leur complémentarité plutôt que leur opposition.

Les faits : comment fonctionnent vraiment ces deux approches

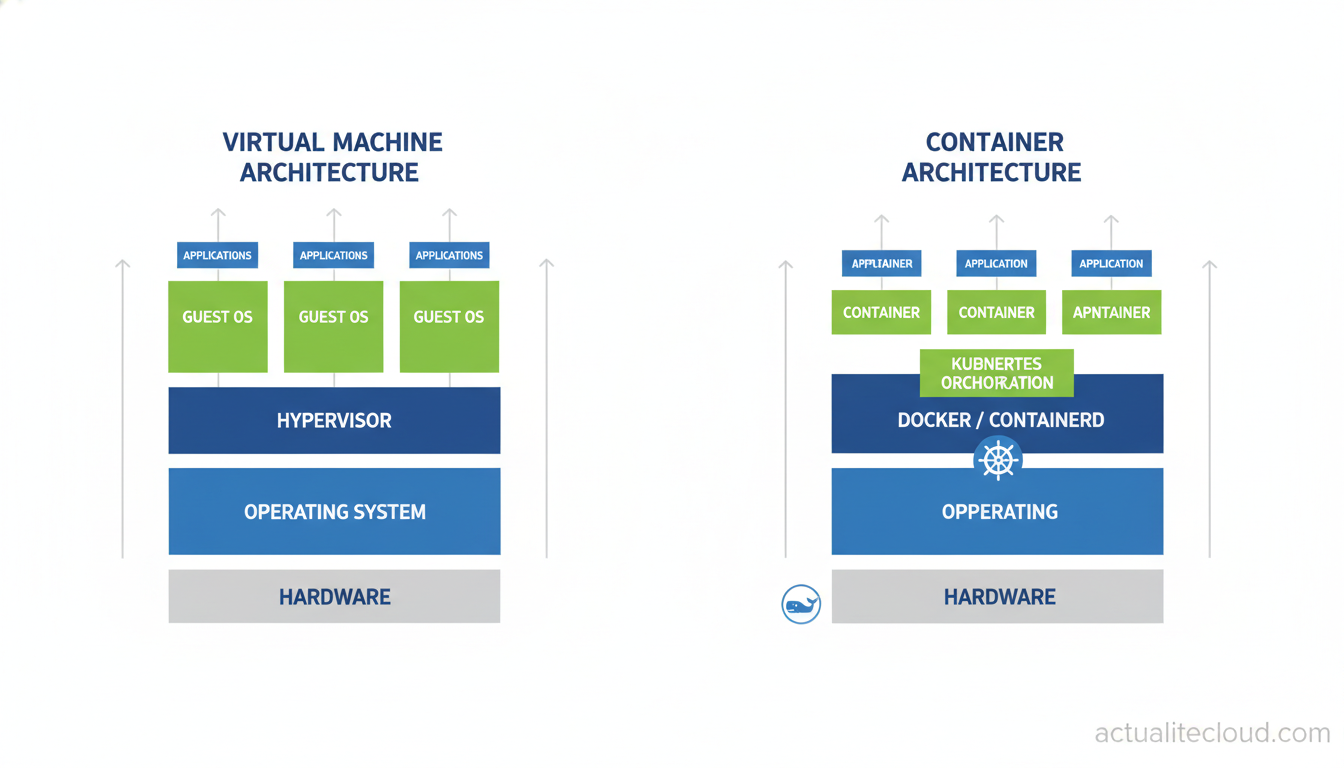

Une machine virtuelle émule un système complet — CPU, mémoire, stockage, réseau — via un hyperviseur positionné entre le matériel physique et les OS invités. Chaque VM dispose de son propre noyau, de ses propres pilotes et de son propre espace mémoire. Cette architecture garantit une isolation forte : une faille dans une VM ne compromet pas directement les autres. C’est le modèle retenu par les fournisseurs cloud pour la multi-location et par les entreprises pour les charges réglementées.

Un conteneur, en revanche, partage le noyau de l’OS hôte. Il encapsule l’application avec ses bibliothèques et ses dépendances, mais s’exécute comme un processus isolé via les namespaces et cgroups Linux. Docker popularisé le modèle, Kubernetes en a assuré l’orchestration à grande échelle. Le résultat : des démarrages en millisecondes contre plusieurs secondes pour une VM, une empreinte mémoire réduite de 60 à 80 %, et une portabilité entre environnements quasi totale.

La différence d’isolement est fondamentale. En partageant le noyau, les conteneurs exposent une surface d’attaque plus large en cas de vulnérabilité kernel. Les exploits de type container escape, bien que rares, existent. C’est pourquoi des acteurs comme SUSE travaillent à combiner virtualisation et conteneurs au sein de la même plateforme, en exécutant des workloads Kubernetes dans des VMs isolées pour bénéficier des avantages des deux modèles.

Analyse et implications : au-delà des performances brutes

Le débat technique se limite trop souvent à des benchmarks de performance. Ce qui importe davantage pour un DSI ou un architecte cloud, c’est l’adéquation entre le modèle d’infrastructure et les contraintes réelles du projet.

Choisir la virtualisation reste pertinent dans plusieurs scénarios en 2026 : charges héritées incompatibles avec la conteneurisation, exigences réglementaires imposant un isolement système complet (secteur financier, santé, défense), environnements multi-OS sur un même hôte physique, ou encore développement sur des systèmes d’exploitation spécifiques. La virtualisation est aussi le modèle de référence pour les environnements cloud souverains, où l’isolation des données entre clients doit être garantie juridiquement.

Choisir les conteneurs s’impose lorsque la rapidité de déploiement, la densité applicative et la standardisation des pipelines CI/CD sont prioritaires. Les architectures microservices, les APIs REST, les applications cloud-native et tout ce qui nécessite une mise à l’échelle horizontale rapide bénéficient directement de l’écosystème Kubernetes. En 2026, plus de 70 % des nouvelles applications déployées sur les grands clouds publics utilisent des conteneurs comme couche d’exécution principale.

Un troisième cas d’usage émerge avec force : l’exécution d’agents d’intelligence artificielle. Ces agents nécessitent des environnements persistants, isolés, accessibles à distance, capables d’exécuter du code arbitraire. Ni un conteneur éphémère, ni une VM cloud classique avec toute sa complexité opérationnelle ne répondent parfaitement à ce besoin. C’est dans ce contexte qu’apparaît exe.dev.

exe.dev : la virtualisation simplifiée pour les développeurs et les agents IA

exe.dev se positionne comme un service d’abonnement proposant des machines virtuelles avec disques persistants, accessibles immédiatement, sans la friction opérationnelle habituelle des clouds classiques. Le service expose les VMs via HTTPS/TLS avec un proxy intégré — pas d’IP publique à gérer, pas de configuration réseau complexe. L’API est basée sur SSH, ce qui la rend compatible avec l’outillage existant des développeurs.

Ce positionnement répond à un problème concret : lorsqu’un développeur choisit une VM pour son isolement ou sa flexibilité, le vrai travail n’est pas de la démarrer — c’est tout ce qui l’entoure. Provisionnement, gestion réseau, exposition des services, stockage persistant, sauvegardes, contrôle des accès. exe.dev promet d’absorber cette complexité en proposant une expérience proche d’un « ordinateur portable distant » plutôt que d’une infrastructure cloud classique.

Pour les cas d’usage d’agents IA — où l’exécution de code dans un sandbox isolé et persistant est critique — ce type de service présente un intérêt réel. Comme analysé précédemment dans notre comparatif virtualisation vs conteneurisation, les VMs retrouvent un avantage compétitif précis lorsque l’isolement d’environnement prime sur la légèreté d’exécution.

La dépendance à un service tiers reste cependant un point à évaluer soigneusement. exe.dev abstrait des composants critiques de l’infrastructure. Cela simplifie l’expérience initiale, mais crée une dépendance opérationnelle qu’il convient d’anticiper dans toute stratégie de continuité ou de migration.

Perspectives : vers une convergence des modèles d’exécution

En 2026, la tendance de fond n’est pas la victoire d’un modèle sur l’autre, mais leur convergence. Les fournisseurs cloud proposent désormais des services hybrides : AWS Firecracker exécute des microVMs légères pour Lambda, combinant l’isolement des VMs avec la rapidité de démarrage des conteneurs. Google gVisor et Azure Hyper-V Containers suivent la même logique. La migration des hyperviseurs propriétaires vers des solutions plus flexibles accélère cette évolution.

Les prochaines années verront probablement l’émergence de nouvelles couches d’abstraction — des environnements d’exécution optimisés pour des charges spécifiques (IA, edge computing, temps réel) — plutôt qu’une simplification autour d’un seul paradigme. Pour les équipes techniques, cela signifie que la maîtrise des deux modèles reste une compétence fondamentale, non pas pour en choisir un, mais pour savoir les combiner intelligemment.

Questions fréquentes sur la virtualisation et les conteneurs

Quelle est la principale différence technique entre une machine virtuelle et un conteneur ?

Une machine virtuelle dispose de son propre noyau OS et émule un système complet via un hyperviseur, garantissant une isolation forte. Un conteneur partage le noyau de l’hôte et encapsule uniquement l’application avec ses dépendances, offrant légèreté et rapidité de déploiement au prix d’un isolement moins strict.

Les conteneurs peuvent-ils remplacer les machines virtuelles en entreprise ?

Non, pas universellement. Les VMs restent indispensables pour les charges héritées, les environnements multi-OS, les exigences réglementaires strictes et les scénarios où l’isolement complet du système est requis. Dans la plupart des architectures modernes, les deux coexistent : des conteneurs s’exécutent souvent à l’intérieur de machines virtuelles.

Quel est le principal avantage des conteneurs pour le développement cloud-native ?

La portabilité et la rapidité. Un conteneur bien conçu fonctionne de manière identique sur le poste du développeur, dans un pipeline CI/CD et en production cloud. Couplé à Kubernetes, il permet une mise à l’échelle horizontale automatique et une gestion déclarative de l’infrastructure applicative.

Que propose exe.dev par rapport aux solutions cloud classiques ?

exe.dev propose des VMs persistantes accessibles immédiatement via SSH ou navigateur, sans la complexité de gestion des clouds classiques (configuration réseau, IP publique, provisionnement manuel). Le service est particulièrement adapté aux environnements de développement à distance et à l’exécution d’agents d’IA nécessitant un sandbox isolé et persistant.

Dans quels cas la virtualisation est-elle préférable aux conteneurs en 2026 ?

Lorsque l’isolement système complet est requis (secteur financier, santé, défense), pour les charges héritées incompatibles avec la conteneurisation, dans les environnements multi-OS, ou encore pour les clouds souverains où l’isolation des données entre clients doit être garantie contractuellement et réglementairement.

Comment les grands fournisseurs cloud combinent-ils virtualisation et conteneurs ?

AWS utilise Firecracker pour exécuter des microVMs légères sous Lambda, combinant l’isolement des VMs avec la rapidité des conteneurs. Google propose gVisor pour sandboxer les conteneurs, et Azure utilise Hyper-V Containers pour le même objectif. Cette convergence illustre que le futur n’est ni VM-only ni container-only, mais hybride et contextuel.