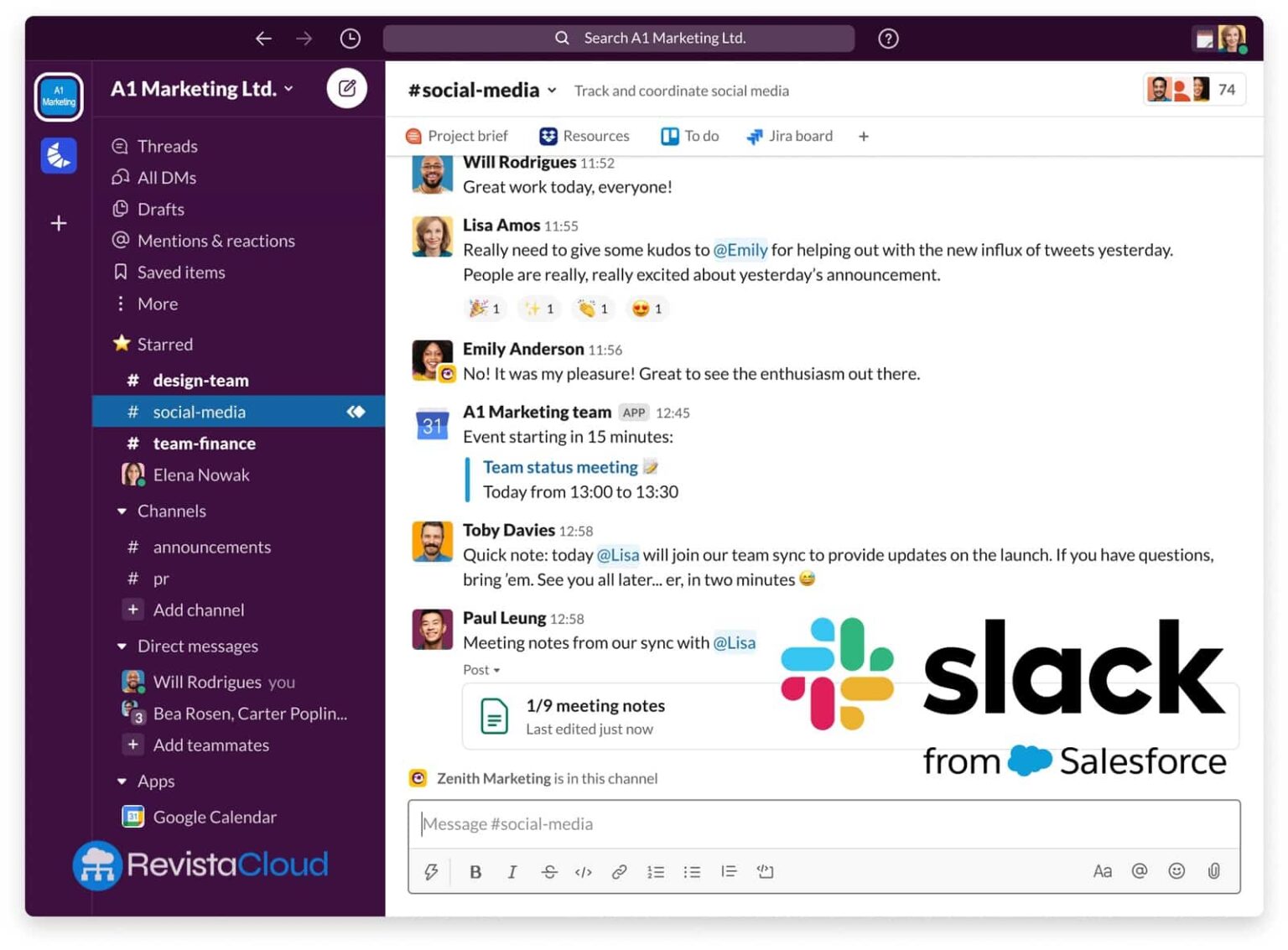

La controverse a éclaté parmi les utilisateurs de Slack après la découverte que leurs messages, contenus et fichiers sont utilisés pour entraîner les modèles d’intelligence artificielle (IA) de l’entreprise. Depuis le lancement de Slack AI en février, la plate-forme a défendu sa politique de collecte de données des clients par défaut, générant une vague d’indignation et de préoccupation pour la vie privée.

La Révélation et le Clameur Publique

Le scandale a rapidement commencé à se propager sur divers forums et réseaux sociaux, et il n’a pas fallu longtemps pour attirer l’attention des médias spécialisés tels que Ars Technica. Les utilisateurs ont exprimé leur consternation en apprenant que leurs communications privées pourraient être employées pour entraîner des algorithmes d’IA sans leur consentement explicite.

Une analyse approfondie des politiques, des déclarations et des publications de blog de Slack réalisée par Ars Technica a révélé un manque notable de clarté sur les données spécifiques utilisées pour l’entraînement des modèles d’IA. Cette ambiguïté a contribué à augmenter la méfiance parmi les utilisateurs.

Comparaisons avec d’Autres Usages de l’IA

Pour certains, la controverse avec Slack est reminiscente d’autres débats récents sur l’usage de l’IA. Par exemple, dans l’industrie des jeux vidéo, le jeu de stratégie populaire Stellaris a implémenté des technologies d’IA de manière transparente et éthique. Le directeur du jeu a expliqué qu’ils utilisent des outils génératifs d’IA pour concevoir du contenu et des références visuelles pendant les phases initiales de développement, en assurant qu’aucun contenu généré par IA n’est inclus dans le produit final sans être révisé et modifié par des artistes et développeurs humains. De plus, les acteurs de voix dont les travaux sont employés dans le jeu reçoivent des compensations adéquates pour leur travail.

Cette approche contrastante met en lumière ce que beaucoup considèrent comme des pratiques éthiques dans l’usage de l’IA : transparence, consentement informé et compensation juste. À l’inverse, les actions de Slack ont été critiquées pour leur manque d’ouverture et pour ne pas assurer le consentement de tous les utilisateurs dont les données sont utilisées.

Réactions et Conséquences

La réponse des utilisateurs a été énergique. Beaucoup ont commencé à inciter leurs employeurs à opter pour ne pas participer aux politiques de collecte de données de Slack. La principale préoccupation est l’exposition potentielle d’informations privées et de données d’entreprise sensibles à travers ces algorithmes d’IA.

Les experts en confidentialité et en sécurité ont également pris la parole, soulignant les risques de sécurité inhérents à la collecte massive de données sans un consentement clair. Le manque de transparence sur la manière dont ces données sont utilisées et qui y a accès crée un terrain propice à d’éventuels abus et violations de sécurité.

Qu’est-ce Que Cela Signifie pour les Utilisateurs de Slack ?

Pour les millions d’utilisateurs qui utilisent Slack quotidiennement, cette controverse souligne l’importance de réviser et de comprendre les politiques de confidentialité des outils utilisés dans l’environnement de travail. Les utilisateurs doivent être conscients de la manière dont leurs données sont gérées et avoir la capacité d’opter pour ne pas participer à des pratiques avec lesquelles ils ne sont pas d’accord.

La situation actuelle avec Slack souligne une vérité essentielle à l’ère numérique : la vie privée et la protection des données sont des préoccupations fondamentales qui ne doivent pas être prises à la légère. Les entreprises, de leur côté, doivent s’efforcer d’être transparentes et éthiques dans l’usage des technologies d’IA, en assurant que tous les intéressés soient informés et consentent explicitement à l’utilisation de leurs données.

Conclusion

L’affaire de Slack AI a sonné une alarme parmi ses utilisateurs et la communauté technologique en général. Le manque de transparence et l’utilisation involontaire de données personnelles pour l’entraînement de l’IA ont mis en question les pratiques de l’entreprise. Dans un monde où la vie privée et l’éthique dans la technologie sont de plus en plus cruciales, les utilisateurs et les entreprises doivent exiger plus de clarté et de contrôle sur l’utilisation de leurs données.

Pour ceux qui utilisent Slack, il est essentiel d’évaluer soigneusement les options disponibles et de prendre des mesures proactives pour protéger leur information et celle de leur organisation. La controverse actuelle pourrait être un tournant qui pousse l’industrie à adopter des pratiques plus responsables et transparentes dans l’usage de l’intelligence artificielle.

Références: OSnews et ARStechnica