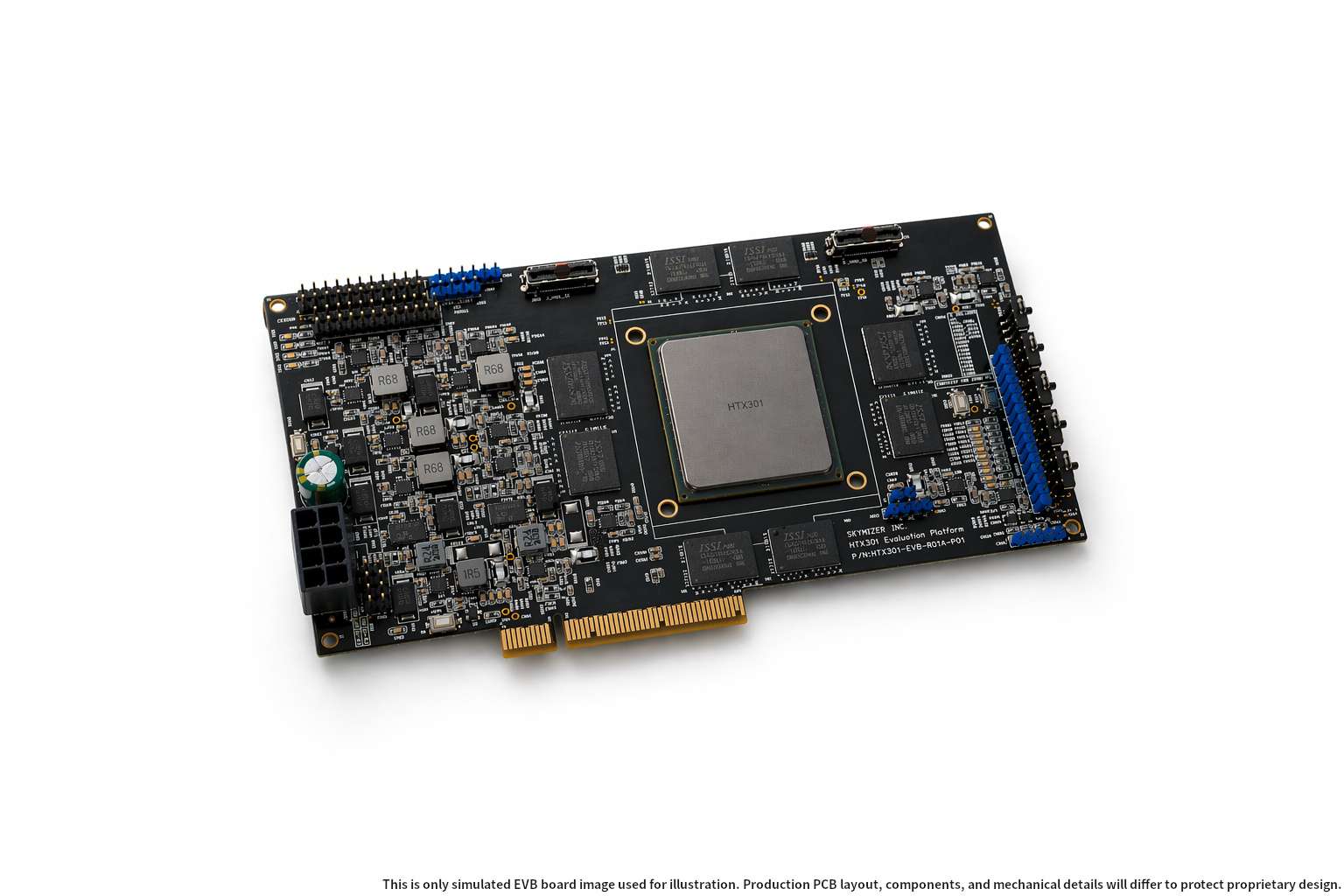

Skymizer a présenté HTX301, son premier composant de référence basé sur la plateforme HyperThought, avec une promesse très attrayante pour le marché de l’inférence en intelligence artificielle : exécuter des modèles de langage jusqu’à 700 milliards de paramètres localement, sur une seule carte PCIe équipée de six puces HTX301, avec 384 Go de mémoire et une consommation d’environ 240 W par carte.

Cette solution vise directement l’un des grands défis de l’IA en entreprise. Beaucoup d’entreprises souhaitent utiliser de grands modèles sans transmettre de données sensibles à des services externes, mais déployer une inférence avancée localement nécessite souvent des clusters de GPU, des interconnexions coûteuses, une réfrigération complexe et du matériel spécialisé. Skymizer affirme que son architecture peut simplifier cette configuration en séparant plus efficacement les phases d’inférence et en délocalisant une partie du traitement vers du silicium conçu spécifiquement pour la génération de tokens.

Il convient d’aborder cet annonce avec prudence. La société évoque une avancée significative et propose un accès anticipé, mais il n’existe pas encore d’essais indépendants complets, ni de données publiques détaillées sur la performance par modèle, la précision, la quantification, la latence réelle, le coût commercial ou la disponibilité à grande échelle. Toutefois, cette approche s’inscrit dans une tendance claire : la partie inférence commence à peser davantage que l’entraînement dans les dépenses opérationnelles de l’IA.

Une puce conçue pour la phase de génération

Skymizer présente le HTX301 comme une réponse à l’évolution de l’utilisation des grands modèles. Lors de la phase initiale de l’IA générative, l’attention se concentrait essentiellement sur l’entraînement de modèles toujours plus volumineux. Désormais, de nombreuses entreprises doivent résoudre un autre problème : comment exécuter ces modèles de façon constante, sécurisée et prédictible dans des applications réelles, agents, copilotes internes, systèmes de recherche, support client, analyse documentaire ou outils de programmation.

La clé technique d’HyperThought réside dans la séparation de deux phases de l’inférence pour les modèles de langage. La première est le « pré-remplissage » (« prefill »), lorsque le système traite l’entrée (prompt). C’est une étape plus intensive en calcul. La seconde est le « décodage » (« decode »), où le modèle génère les tokens un à un. Cette étape est généralement limitée par la bande passante mémoire et la latence plutôt que par la capacité brute de calcul.

Les GPU actuelles peuvent gérer ces deux tâches, mais elles ne sont pas toujours la solution la plus efficace pour chacune. Skymizer défend que son architecture « decode-first » permet d’utiliser des puces spécialisées pour la génération, tandis que les GPU existantes peuvent continuer à prendre en charge les charges de calcul plus lourdes. La société indique d’ailleurs que le HTX301 complète l’infrastructure GPU plutôt que de la remplacer entièrement.

Ce différentiel est crucial. Le message principal pointe sur la suppression de la nécessité de clusters GPU massifs pour exécuter en local des modèles énormes. Mais, en réalité, la stratégie technique proposée par Skymizer apparaît plus nuancée : utiliser du matériel dédié pour optimiser l’inférence et libérer des GPU dans certains scénarios.

Souveraineté des données et coûts plus prévisibles

Le volet économique est tout aussi important que le technique. Skymizer cible les entreprises qui ne souhaitent pas dépendre de l’inférence par jetons dans le cloud public. Dans des secteurs comme la banque, la santé, le juridique, l’administration, la défense, l’industrie ou le design de puces, l’envoi de données à des plateformes externes peut poser des problèmes de confidentialité, de réglementation, de propriété intellectuelle ou de contrôle opérationnel.

Une carte capable d’exécuter des grands modèles en local, si elle tient ses promesses, pourrait révolutionner le coût et la conception de certains déploiements. Au lieu de payer à l’usage dans le cloud ou de mettre en place des clusters complexes, une entreprise pourrait installer ses propres capacités pour des charges précises, tout en conservant ses données, ses modèles et ses réponses dans son infrastructure.

Skymizer évoque également des cas comme des copilotes privés pour le code, des assistants pour la conception RTL, la relecture de contrats, l’analyse médicale, la détection de fraude ou des agents d’entreprise. Ces scénarios exigent une faible latence, une confidentialité accrue et des coûts prévisibles. Cependant, chaque cas dépendra du modèle utilisé, du volume de requêtes, des exigences de sécurité et de la qualité du système logiciel.

HTX301 repose sur LISA, l’architecture propriétaire de Skymizer pour l’inférence sur transformeurs, conçue spécifiquement pour ce type de charge. La société avait déjà présenté HyperThought comme une propriété intellectuelle pour l’accélération de l’IA générative et multimodale, avec une vision allant des dispositifs edge jusqu’aux déploiements sur site. En 2025, Synopsys a indiqué que Skymizer utilisait sa plateforme HAPS pour valider HyperThought en hardware avant la production de silicium définitif, ce qui souligne une démarche basée sur le prototypage et la co-conception hardware/software.

Une promesse ambitieuse mais à valider

La revendication la plus audacieuse est qu’une seule carte PCIe avec six puces HTX301 et 384 Go de mémoire peut exécuter l’inférence de modèles de 700 milliards de paramètres avec une consommation d’environ 240 W. Ce chiffre, s’il est séduisant en comparaison aux déploiements standard de modèles volumineux sur plusieurs GPU haut de gamme, requiert néanmoins des détails essentiels pour juger de son impact réel : précisions sur le format précis du modèle, la quantification, les tokens par seconde, le nombre d’utilisateurs simultanés, la taille du contexte, la qualité de sortie, la performance continue et la comparaison avec les GPU actuels dans des conditions équivalentes.

En IA, la mémoire disponible ne raconte pas toute l’histoire. Un modèle de 700 milliards de paramètres peut en fait occuper des volumes très différents selon la précision et la quantification utilisées. Il faut aussi prendre en compte la mémoire pour le cache KV, le contexte, le batch, le runtime et l’orchestration. Par conséquent, ce lancement ouvre une perspective prometteuse, mais nécessite encore des benchmarks indépendants et des tests avec des modèles reconnus pour mesurer son véritable impact.

Le marché évolue dans cette direction. Alors que les entreprises migrent d’expérimentations avec des chatbots à des déploiements d’agents et d’automatisations, l’inférence cesse d’être une étape occasionnelle pour devenir une charge continue. Chaque requête, chaque agent, chaque processus en chaîne et chaque workflow consomment des tokens. Un accroissement du coût lié à cette consommation peut rapidement devenir un obstacle dans le cloud.

C’est dans ce contexte qu’émergent des architectures alternatives aux GPU classiques. Pas seulement chez Skymizer. Tout le secteur s’oriente vers des puces spécialisées, NPU, LPU, accélérateurs pour l’edge, ASICs dédiés, mémoires plus proches du calcul, et de nouvelles façons de séparer les charges. L’objectif n’est pas toujours la puissance maximale, mais plutôt l’amélioration du coût par token, la consommation, la latence et la facilité de déploiement.

Skymizer se démarque en proposant une stack complète : processeur, carte, mémoire, architecture d’instruction (ISA) et logiciel d’orchestration pour différencier pré-remplissage et décodage. Si cette vision peut se concrétiser en un produit viable, elle pourrait trouver sa place dans les entreprises recherchant une IA privée et maîtrisée, sans avoir à bâtir une infrastructure de grande ampleur.

La question est désormais de savoir si le HTX301 sera une véritable alternative ou simplement une promesse de plus dans un marché saturé d’annonces ambitieuses. Le hardware IA est complexe : un bon puce ne suffit pas, il faut une plateforme logicielle solide, des compilateurs, un support pour divers modèles, une intégration avec des frameworks, des mises à jour régulières, des outils de monitoring, une disponibilité commerciale et la confiance des utilisateurs. Les GPU dominent non seulement par la performance brute, mais aussi par leur écosystème.

Le HTX301 mérite d’être suivi, car il répond à un vrai besoin : simplifier, rendre plus efficace et plus abordable l’inférence locale de grands modèles. Mais son succès dépendra des tests en conditions réelles. Si Skymizer parvient à démontrer une performance soutenue et une compatibilité pratique avec des modèles d’entreprises, elle pourrait ouvrir une voie novatrice pour démocratiser l’accès à une IA avancée hors des grands centres de données cloud.

Questions fréquentes

Qu’est-ce que le Skymizer HTX301 ?

HTX301 est le premier composant de référence de Skymizer basé sur la plateforme HyperThought, conçu pour l’inférence de modèles de langage et autres charges d’IA sur des environnements locaux.

Peut-il exécuter des modèles de 700 milliards de paramètres sur une seule carte ?

Skymizer assure qu’une carte PCIe équipée de six puces HTX301 et disposant de 384 Go de mémoire peut réaliser une inférence locale pour des modèles jusqu’à 700 milliards de paramètres, avec une consommation d’environ 240 W. Cependant, il manque à ce stade des tests indépendants complets pour valider la performance réelle, la précision et les conditions exactes.

HTX301 remplace-t-il les GPU ?

Pas nécessairement. Skymizer présente le HTX301 comme une architecture complémentaire, permettant de déléguer la phase de décodage de l’inférence, tout en laissant les GPU s’occuper des charges intensives en calcul.

Pour quelles entreprises pourrait-il être utile ?

Il pourrait intéresser les organisations souhaitant faire tourner leur IA en local pour des raisons de confidentialité, de souveraineté des données, de faible latence ou de coûts prévisibles, notamment dans les secteurs bancaire, médical, juridique, administratif, industriel, de défense ou de développement logiciel.

via : skymizer.ai