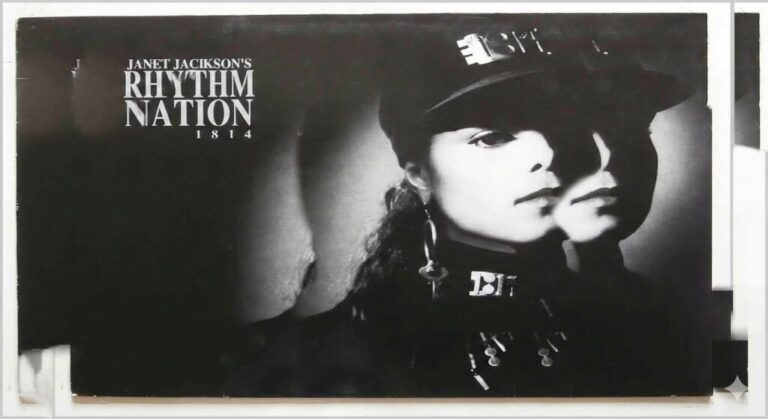

Rhythm Nation comme vecteur d’attaque : le CVE qui a rappelé à l’industrie que la cybersécurité est aussi physique

Dans un secteur habitué aux vulnérabilités logicielle, aux correctifs urgents et aux exploits à distance, CVE-2022-38392 se distingue encore comme une rareté qui, pourtant, délivre une leçon très sérieuse : parfois, le problème ne réside pas dans le code, mais dans l’interaction entre le monde numérique et le monde physique. Dans ce cas, le déclencheur n’était ni un paquet malveillant ni une faille d’authentification, mais un signal audio associé au clip vidéo Rhythm Nation (1989) de Janet Jackson. Cette histoire, qui a débuté comme une anecdote technique rapportée par Microsoft, a finalement été formellement inscrite dans la Base de Données Nationale de Vulnérabilités (NVD) avec une description inhabituelle pour un CVE classique : « certains disques durs à 5400 RPM