La fièvre de l’Intelligence Artificielle fait grimper le prix de la DRAM : revenus records et hausses encore plus importantes en 2026

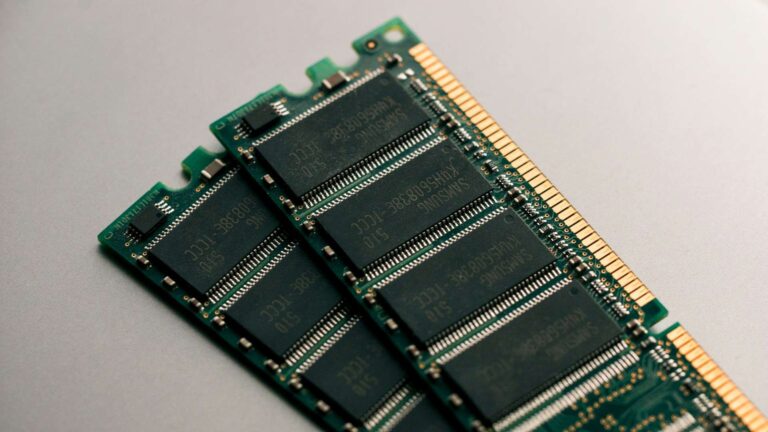

L’expansion de l’intelligence artificielle, depuis l’entraînement de grands modèles de langage (LLM) jusqu’à la phase d’inférence — lorsque ces modèles sont déployés en production — reconfigure silencieusement l’économie des centres de données. Et, avec elle, un composant qui semblait « secondaire » revient sur le devant de la scène : la mémoire. Selon la dernière analyse de TrendForce, les principaux fournisseurs de services cloud (CSP) étendent leurs déploiements au-delà des serveurs d’IA pour inclure davantage de serveurs généralistes. Ce changement stimule la demande en mémoire : il ne s’agit plus uniquement de HBM3e, LPDDR5X ou RDIMM à haute capacité, mais aussi de RDIMM dans diverses densités pour alimenter un parc de serveurs plus vaste. L’effet immédiat a été une hausse