Durant plusieurs mois, l’industrie de l’intelligence artificielle a évoqué la nécessité de développer des modèles plus grands, avec davantage de contexte et de puissance de calcul. Toutefois, en pratique, l’un des enjeux majeurs ne réside pas seulement dans l’entraînement de ces systèmes, mais aussi dans leur maintenance pour assurer une exploitation efficace en production. Google Research focalise désormais ses efforts sur ce point avec TurboQuant, une technique de compression dévoilée le 24 mars 2026, visant à atténuer l’un des principaux goulots d’étranglement des grands modèles de langage : la mémoire consommée par le cache clé-valeur, connu sous le nom de KV cache.

Ce lancement intervient dans un contexte où la pression sur l’infrastructure devient croissante. Plus un modèle doit gérer un contexte étendu, plus il doit réserver de mémoire pour conserver les informations déjà traitées et pouvoir les réutiliser lors de l’inférence. Cet « espace mémoire rapide » facilite des réponses sans recalcul complet, mais augmente le coût et limite la scalabilité. Google propose que TurboQuant puisse répondre à ce défi sans compromettre la performance utile, ce qui est particulièrement pertinent pour les assistants conversationnels, les systèmes RAG, les moteurs de recherche sémantiques, ou encore les bases de données vectorielles.

Moins de mémoire, moins de coûts, et plus de possibilités de montée en charge

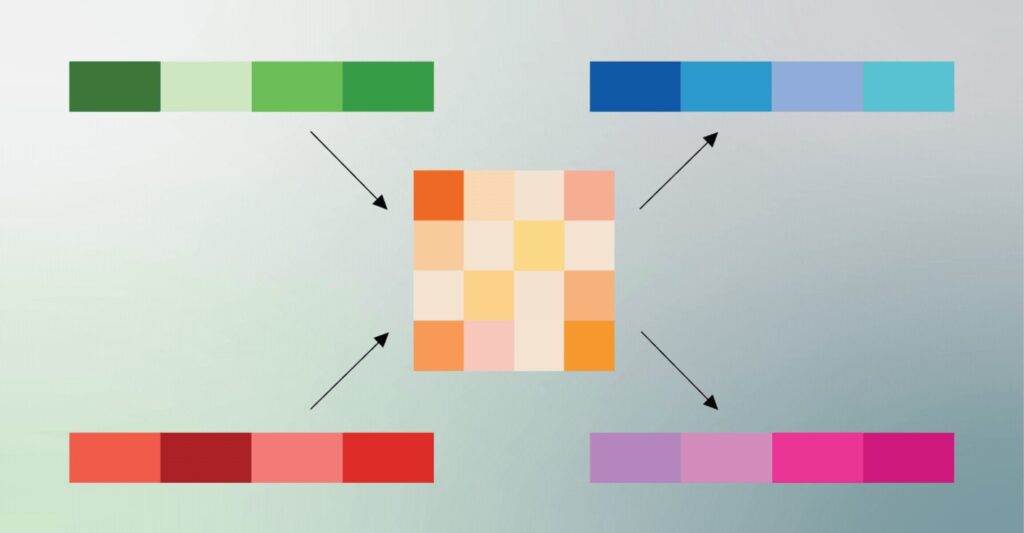

La dimension technique centrale repose sur la quantification vectorielle, une méthode éprouvée de compression qui réduit la taille des vecteurs à haute dimension. Ces vecteurs constituent la base de la représentation du sens, des relations sémantiques et des caractéristiques des données dans les modèles. Selon Google, de nombreuses méthodes traditionnelles de quantification engendrent un surcoût mémoire additionnel, car elles doivent stocker des constantes supplémentaires pour chaque petit segment comprimé. TurboQuant se présente comme une solution pour réduire ce coût caché.

Pour cela, Google combine deux innovations. La première est PolarQuant, une technique qui transforme les vecteurs pour optimiser leur compression et limiter les normalisations coûteuses. La seconde, QJL (Quantized Johnson-Lindenstrauss), intervient sur l’erreur résiduelle avec une correction d’un bit. Selon leurs explications officielles, cette synergie permet de compresser de manière agressive l’information tout en évitant les biais qui pourraient altérer le mécanisme d’attention du modèle. PolarQuant figure aussi dans la programmation officielle d’AISTATS 2026, où il sera présenté le 4 mai.

Ce qui intéresse les acteurs technologiques ne se limite pas à l’aspect mathématique élégant : si cette technique réduit réellement la pression mémoire, ses impacts dépassent le simple benchmark. Elle pourrait permettre plus d’utilisateurs simultanés par GPU, réduire la dépendance à des configurations mémoire extrêmes, ouvrir la voie à une fenêtre de contexte plus large, et potentiellement diminuer le coût par inférence. Dans un marché où l’efficience matérielle devient aussi cruciale que la qualité du modèle, cette forme d’optimisation pourrait avoir une importance stratégique comparable à celle d’un lancement de produit innovant.

Ce que révèlent les premiers tests et les précautions à prendre

Google affirme avoir testé TurboQuant, PolarQuant et QJL dans des benchmarks de contextes longs tels que LongBench, Needle In A Haystack, ZeroSCROLLS, RULER, et L-Eval, en utilisant des modèles comme Gemma et Mistral. D’après leur communication, TurboQuant pourrait traiter parfaitement des tâches de type « aiguille dans une botte de foin » tout en réduisant la mémoire KV d’au moins six fois. La technique serait aussi capable de quantifier cette mémoire jusqu’à 3 bits, sans nécessiter d’entraînement ou d’ajustement fin, avec un impact négligeable sur le temps d’exécution.

En conditions optimales sur des accélérateurs NVIDIA H100, Google indique qu’une version à 4 bits de TurboQuant aurait atteint jusqu’à 8 fois plus de performance que des clés non quantifiées en 32 bits lors du calcul du logits d’attention. Si cet avantage se confirme hors du laboratoire, cela représenterait non seulement une économie notable, mais aussi un gain opérationnel : augmentation de la vitesse d’inférence et meilleure utilisation de ressources coûteuses et rares.

Cependant, il importe d’interpréter ces résultats avec prudence. Dans leur post de présentation, Google évoque une compression à 3 bits sans perte de précision. Mais dans le résumé publié sur OpenReview pour ICLR 2026, la formulation est plus nuancée : une « neutralité absolue de qualité » est estimée à 3,5 bits par canal, avec une dégradation marginale à 2,5 bits par canal. Ces différences soulignent que le rendement dépend du contexte précis, des métriques utilisées et de la charge évaluée.

Ce détail est essentiel car l’histoire de l’IA regorge d’innovations brillantes en environnement contrôlé, qui rencontrent souvent des résistances en production : kernels non optimisés, difficultés d’intégration, incompatibilités avec certains moteurs de serving, ou encore des écarts significatifs entre modèles. Ici, Google Research présente TurboQuant comme une avancée algorithmique basée sur une assise théorique solide, reconnue par un poster accepté à ICLR 2026. Cela traduit un intérêt académique et technique, mais ne garantit pas une adoption immédiate et universelle dans tous les pipelines d’inférence.

Au-delà de Gemini : un impact potentiel aussi sur la recherche vectorielle

Un des aspects les plus innovants de cette annonce est que Google ne limite pas TurboQuant au problème de la mémoire KV dans les modèles génératifs. La société souligne que ces techniques sont également pertinentes pour la recherche vectorielle en haute dimension, c’est-à-dire pour des systèmes qui identifient des résultats par proximité sémantique plutôt que par simple correspondance de mots. Ce domaine est clé pour l’évolution du moteur de recherche, des assistants contextuels, et d’un large segment de logiciels d’entreprise s’appuyant sur les embeddings.

Dans cette optique, TurboQuant s’inscrit dans une tendance claire : le vrai avantage concurrentiel en IA ne viendra plus uniquement de la taille des modèles, mais de leur capacité à s’exécuter plus efficacement, plus rapidement, avec moins de mémoire. Google souhaite intégrer cette recherche dans cette réflexion globale, pour ne pas en limiter l’application à Gemini. Si la compression extrême des vecteurs passe du stade académique aux moteurs d’inférence et aux infrastructures de recherche, cela pourrait impacter directement les coûts, la latence et la densité de déploiement. Dans un secteur où la mémoire à bande passante élevée devient une ressource précieuse et coûtée, cette innovation pourrait devenir une variable stratégique de premier ordre.

Questions fréquentes

Qu’est-ce que TurboQuant de Google ?

Une technique de compression vectorielle dévoilée par Google Research, visant à réduire la consommation mémoire dans les modèles d’IA et systèmes de recherche vectorielle, en particulier pour atténuer le goulot d’étranglement que représente la cache KV lors de l’inférence.

Pourquoi la cache KV est-elle cruciale dans les grands modèles de langage ?

Elle stocke les données déjà traitées, que le modèle réutilise pour générer des réponses, accélérant ainsi le processus. Cependant, avec un contexte étendu ou plusieurs requêtes simultanées, cela peut consommer énormément de mémoire.

TurboQuant est-il déjà utilisé dans des produits commerciaux de Google ?

Selon leurs déclarations, il s’agit encore d’un travail de recherche. La technique pourrait être employée pour des systèmes comme Gemini, mais aucun calendrier précis de déploiement commercial n’a été annoncé.

Quelle est la contribution de TurboQuant à la recherche sémantique et aux bases de données vectorielles ?

Elle permettrait de construire et d’interroger des index vectoriels avec beaucoup moins de mémoire, peu de prétraitements, tout en maintenant une grande précision, ce qui est crucial pour les moteurs de recherche, systèmes RAG, et applications d’entreprise utilisant des embeddings.

Sources : research.google et Noticias Inteligencia Artificial