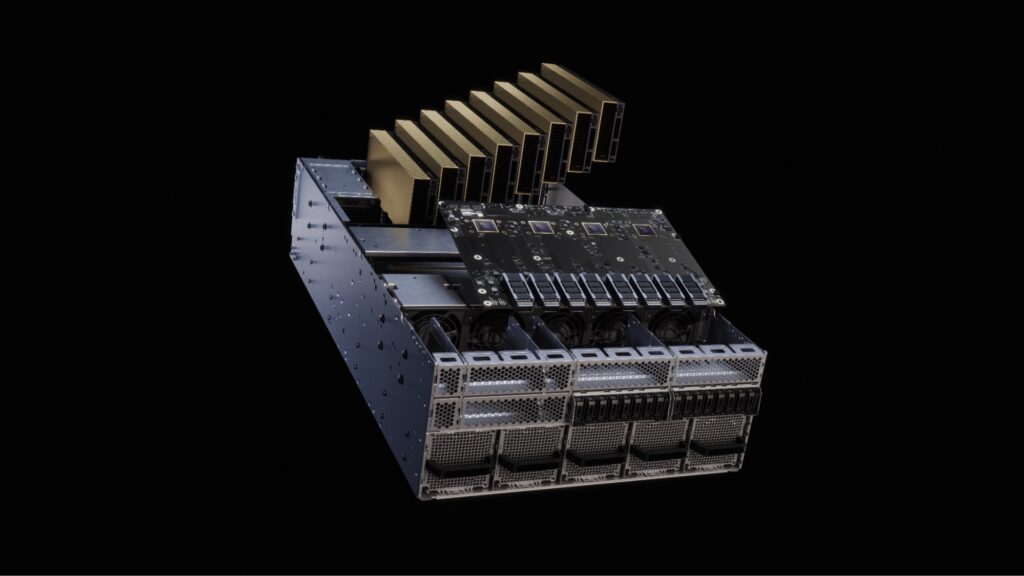

Lors de la Game Developers Conference de San Francisco, NVIDIA a présenté une idée qui gagne en importance dans les grands studios répartis à travers le monde : externaliser une partie du développement de jeux vidéo en déplaçant certaines tâches vers une infrastructure centralisée dans un centre de données. Leur proposition tourne autour de NVIDIA RTX PRO Server, une plateforme basée sur les RTX PRO 6000 Blackwell Server Edition et le logiciel NVIDIA vGPU. L’objectif est de virtualiser les stations de travail, les phases de test, les flux d’IA et les tâches d’ingénierie sur une seule plateforme partagée.

Une telle initiative ne peut être prise à la légère. Le développement moderne de jeux vidéo intègre des mondes plus vastes, des chaînes de production plus complexes et des équipes de plus en plus dispersées entre bureaux, télétravail, partenaires externes et studios situés dans différentes régions. Dans ce contexte, continuer à dépendre du matériel GPU fixe, lié à un poste spécifique, engendre des inefficacités : stations sous-utilisées dans une équipe pendant qu’une autre attend des ressources, environnements de travail mal synchronisés entre départements, et difficulté à reproduire les erreurs lorsque le matériel, les pilotes ou les outils ne sont pas identiques. NVIDIA propose le RTX PRO Server comme solution à ces défis.

La société affirme que cette approche permettrait de centraliser et de virtualiser les tâches d’artistique, de développement, de recherche en IA et de QA sur une même infrastructure GPU dans le centre de données, tout en offrant une expérience de niveau station de travail avec une meilleure scalabilité, une utilisation optimisée des ressources et une cohérence opérationnelle entre les différentes localités. Cette vision s’inscrit dans une tendance plus large du marché : il ne s’agit plus simplement d’acheter des GPU puissants, mais de les organiser comme une ressource partagée et réaffectable selon la charge de travail réelle du studio.

De postes isolés à une infrastructure GPU commune

Pour NVIDIA, le changement principal consiste à passer d’un modèle où chaque poste de travail est dimensionné individuellement à une infrastructure centralisée permettant d’étendre la capacité GPU selon les besoins. Par exemple, la même puissance GPU pourrait être utilisée la nuit pour l’entraînement de modèles, la simulation ou l’automatisation, puis réaffectée durant la journée pour des tâches interactives de développement et de création. D’un point de vue d’efficacité, le message est clair : réduire le temps d’inactivité et augmenter l’élasticité interne sans multiplier le matériel physique réparti entre les départements.

Le matériel clé de cette vision est la RTX PRO 6000 Blackwell Server Edition, une GPU professionnelle conçue pour le centre de données, intégrant 96 GB de mémoire GDDR7 ECC, 24 064 CUDA cores, supportant le PCIe 5.0, avec une capacité allant jusqu’à 4 PFLOPS FP4 pour IA, et une consommation configurable jusqu’à 600 W, selon la fiche technique officielle de NVIDIA. Elle est présentée comme une GPU capable de booster à la fois le graphisme RTX, l’IA, le rendu, la simulation et l’analyse avancée, le tout dans un même environnement.

Pour les studios de jeux vidéo, cela ouvre des possibilités intéressantes. Selon le blog de NVIDIA, les artistes pourraient utiliser des stations RTX virtuelles pour la création 3D et le contenu génératif ; les développeurs disposeraient d’environnements cohérents pour la programmation et le prototypage 3D ; les chercheurs en IA pourraient réserver des profils avec davantage de mémoire pour le fine-tuning, l’inférence et le développement d’agents ; enfin, les équipes QA pourraient augmenter la fréquence des tests et des validations en utilisant la même architecture Blackwell qui alimente aussi la série GeForce RTX 50.

IA, QA et développement partageant la même architecture centrale

Un point particulièrement innovant est que NVIDIA ne propose pas seulement le RTX PRO Server comme une plateforme de virtualisation graphique, mais comme une infrastructure partagée pour graphismes et IA. La société insiste sur le fait que l’intelligence artificielle fait désormais partie intégrante du quotidien en studio : du support à la programmation à la création de contenu en passant par les tests et les opérations en temps réel. Ce contexte amène de nombreuses entreprises à maintenir des environnements séparés, d’un côté des stations graphiques, de l’autre des serveurs ou clusters spécialisés en IA. La proposition de NVIDIA vise à briser cette séparation.

Cela repose sur la combinaison de MIG et vGPU. NVIDIA explique que la technologie Multi-Instance GPU permet de partitionner une seule GPU en plusieurs instances isolées, avec mémoire, cache et puissance de calcul dédiés. La fiche technique de la RTX PRO 6000 Blackwell Server Edition évoque jusqu’à 4 partitions MIG de 24 GB chacune. Dans le contexte du développement de jeux, NVIDIA ajoute qu’en combinant MIG et vGPU, une seule GPU peut supporter jusqu’à 48 utilisateurs simultanés, optimisant ainsi l’usage tout en préservant les performances pour chaque profil.

Cette donnée est impressionnante, mais il est important de l’interpréter avec prudence : cela ne signifie pas que tous les utilisateurs auront la même expérience à chaque fois, mais que la plateforme peut segmenter et répartir la capacité selon les profils et leurs besoins spécifiques. Autrement dit, une session légère de revue ou d’outillage n’aura pas les mêmes exigences qu’un rendu intensif, une compilation ou une simulation. Le message stratégique demeure : NVIDIA souhaite faire percevoir la GPU comme une ressource d’entreprise partagée, et non comme une machine fixe attachée à chaque poste individuel.

Une approche orientée entreprise pour des studios plus dispersés

NVIDIA souligne également que le RTX PRO Server est conçu pour des opérations de centre de données de niveau entreprise. La société indique que les studios peuvent déployer des stations virtuelles via des hyperviseurs et plateformes de stations de travail à distance compatibles avec NVIDIA vGPU, s’intégrant ainsi dans leur infrastructure et leur pratique IT existantes, sans nécessiter de déploiements isolés ou parallèles. De plus, elle rappelle que de grands éditeurs utilisent déjà vGPU pour faire évoluer leurs infrastructures de développement centralisées.

Cette précision est essentielle : la valeur de cette solution ne se limite pas à la performance brute. Elle répond aussi à des enjeux concrets du développement moderne, tels que la gestion de sous-traitants externes, la coordination multisitée, les équipes hybrides, la validation rapide en QA et la capacité à reproduire plus facilement des bugs dans des environnements homogènes. Dans un contexte où la production de jeux vidéo devient de plus en plus répartie, sous contrainte budgétaire, tout en intégrant davantage d’IA, la standardisation des environnements peut devenir aussi stratégique que la puissance de calcul.

Cependant, plusieurs questions restent en suspens. NVIDIA a exposé sa vision et la technologie sous-jacente, mais la véritable valeur pour chaque studio dépendra de facteurs tels que le coût total de déploiement, la latence d’accès à distance, la gestion des profils et des permissions, l’intégration aux outils existants, ainsi que la capacité des équipes IT à faire fonctionner cette infrastructure sans complexifier excessivement leurs opérations. L’attractivité de la promesse est indéniable ; la réussite dépendra de la manière dont cette approche sera mise en œuvre dans la pratique, pour devenir ou non un standard de l’industrie ou une solution réservée aux très grands studios.

Ce qui apparaît clairement, c’est qu NVIDIA pousse une idée fondamentale : l’avenir du développement de jeux vidéo ne se limite pas à des GPUs locaux plus rapides, mais inclut la virtualisation GPU, l’IA partagée et la transformation des stations de travail en services internes. Dans cette transition, RTX PRO Server ambitionne d’être la plateforme réunissant artistes, programmeurs, chercheurs et équipes QA autour d’un même socle basé sur Blackwell.

Questions fréquentes

Qu’est-ce que NVIDIA RTX PRO Server ?

C’est une plateforme d’infrastructure pour centres de données, reposant sur les GPUs RTX PRO 6000 Blackwell Server Edition et le logiciel NVIDIA vGPU, conçue pour virtualiser les stations de travail et exécuter des charges graphiques et d’IA dans un contexte professionnel.

Pourquoi NVIDIA veut-elle virtualiser le développement de jeux vidéo ?

L’objectif est de centraliser l’utilisation des ressources GPU pour les artistes, développeurs, équipes de QA et chercheurs en IA, afin d’améliorer l’efficacité du matériel, la cohérence entre équipes et la scalabilité dans des environnements dispersés.

Quelle GPU utilise RTX PRO Server ?

Elle repose sur la RTX PRO 6000 Blackwell Server Edition, une GPU avec 96 GB de mémoire GDDR7 ECC, jusqu’à 24 064 CUDA cores et supportant le rendu RTX, l’IA, le rendu, et la simulation.

Combien d’utilisateurs peut supporter une RTX PRO 6000 Blackwell Server Edition ?

D’après NVIDIA, via des configurations combinant MIG et vGPU, une seule GPU peut prendre en charge jusqu’à 48 utilisateurs simultanés, en tenant compte des différences de charge selon le profil de chaque utilisateur.

Source : blogs.nvidia