NVIDIA a présenté lors du GTC 2026 un nouveau plan de référence ouvert pour l’un des principaux goulots d’étranglement de l’intelligence artificielle physique : les données. La société a annoncé la Physical AI Data Factory Blueprint, une architecture conçue pour automatiser la génération, l’amplification, l’évaluation et la préparation des données nécessaires à l’entraînement de robots, d’agents de vision artificielle et de systèmes de conduite autonome à grande échelle. L’idée de fond est simple : sans données abondantes, variées et bien validées, il n’y a pas de robot fiable ni de véhicule autonome qui puisse véritablement mûrir.

L’importance de cette annonce réside dans le fait que NVIDIA ne la présente pas comme un outil isolé, mais comme une chaîne de traitement complète, allant des données brutes au jeu final prêt pour l’entraînement. Cette chaîne inclut la curation de données réelles et synthétiques, la génération de scénarios rares ou difficiles à capturer dans le monde réel, la validation automatique des résultats et l’orchestration de l’ensemble du processus sur une infrastructure cloud ou hybride. Un autre point notable : le blueprint complet n’a pas encore été publié sur GitHub, mais NVIDIA prévoit de le rendre disponible en avril, tandis que certains composants clés sont déjà publics.

De la simulation aux données prêtes à l’emploi pour l’entraînement

Le problème que NVIDIA cherche à résoudre est très précis. En robotique et conduite autonome, disposer de modèles puissants ne suffit pas : il faut aussi les entraîner avec d’immenses volumes de données qui incluent non seulement des situations normales, mais aussi des cas rares, des défaillances, des conditions météorologiques défavorables, des variations d’éclairage ou des interactions peu fréquentes. Ces scénarios dits de « longue traîne » sont coûteux, lents et parfois dangereux à capturer dans le monde réel, c’est pourquoi la génération synthétique et la simulation sont devenues des éléments centraux du développement moderne.

Selon NVIDIA elle-même, son nouveau blueprint s’appuie sur plusieurs composants déjà reconnus dans l’écosystème Cosmos. Cosmos Curator se charge de traiter, affiner et annoter de grands ensembles de données réelles et synthétiques ; Cosmos Transfer étend et diversifie ces données pour multiplier les scénarios ; et Cosmos Evaluator, déjà disponible sur GitHub, sert à évaluer, vérifier et filtrer automatiquement la qualité physique des vidéos synthétiques générées. Dans son référentiel public, NVIDIA décrit Cosmos Evaluator comme un système automatisé d’évaluation pour les sorties vidéo synthétiques, contrôlant les hallucinations, la correspondance des obstacles et la vérification des attributs environnementaux.

Le lien unissant tout cela est OSMO, l’orchestrateur open source de NVIDIA pour les flux de travail en IA physique. La société le décrit comme une plateforme d’orchestration cloud-native coordonnant des clusters d’entraînement, de simulation et des environnements edge via des workflows définis en YAML. OSMO ne remplace pas les simulateurs ou frameworks d’entraînement, mais leur donne une structure et une coordination, et il s’intègre désormais avec des agents de code tels que Claude Code, OpenAI Codex et Cursor pour automatiser certaines opérations. En résumé, NVIDIA souhaite que le développeur puisse se concentrer sur le modèle lui-même plutôt que de passer du temps à gérer l’infrastructure.

Azure et Nebius concrétisent le potentiel de cette annonce

Ce qui est particulièrement intéressant, c’est que Microsoft Azure et Nebius ne jouent pas seulement les partenaires d’exposition. Microsoft a déjà présenté un Azure Physical AI Toolchain sur GitHub, décrit comme un framework open source et « prêt pour la production » intégrant les services cloud Azure avec la stack d’IA physique de NVIDIA. Le projet combine Azure Machine Learning, AKS, Azure Arc, stockage, sécurité avec Entra ID, simulation avec Isaac Sim et Isaac Lab, et orchestration avec OSMO, avec une orientation claire vers les environnements d’entreprise et les déploiements sérieux, bien loin de simples démonstrations de bureau.

Ce matis est crucial car il ramène le discours de GTC à une réalité plus concrète. Microsoft ne parle pas seulement de simulation, mais d’une chaîne complète allant de la capture de données sur Jetson, leur conversion automatique, leur validation, leur entraînement, leur évaluation et leur déploiement en périphérie (edge). Ils affirment notamment qu’un guide rapide permet d’entraîner une politique de type « pick-and-place » dans Isaac Lab sur GPU via Azure, de suivre des métriques avec MLflow, et de déployer le modèle sur un dispositif Jetson à l’aide de GitOps en moins de deux heures. C’est ambitieux, mais cela est au moins documenté et accompagnée d’un dépôt et d’une architecture publics.

Nebius, de son côté, présente cette initiative comme un service managé dans leur AI Cloud. La société indique avoir intégré le blueprint de NVIDIA dans son infrastructure globale, offrant désormais un environnement permettant de générer des données synthétiques physiques, d’orchestrer des workflows avec OSMO, et de combiner tout cela avec stockage, étiquetage, exécution serverless et inférence managée. Selon Nebius, certains premiers utilisateurs réduisent déjà leurs cycles d’itération de plusieurs semaines à quelques jours, mais cette déclaration doit être considérée comme une communication commerciale plutôt qu’une comparaison indépendante.

Pourquoi cette nouvelle est plus importante qu’il n’y paraît

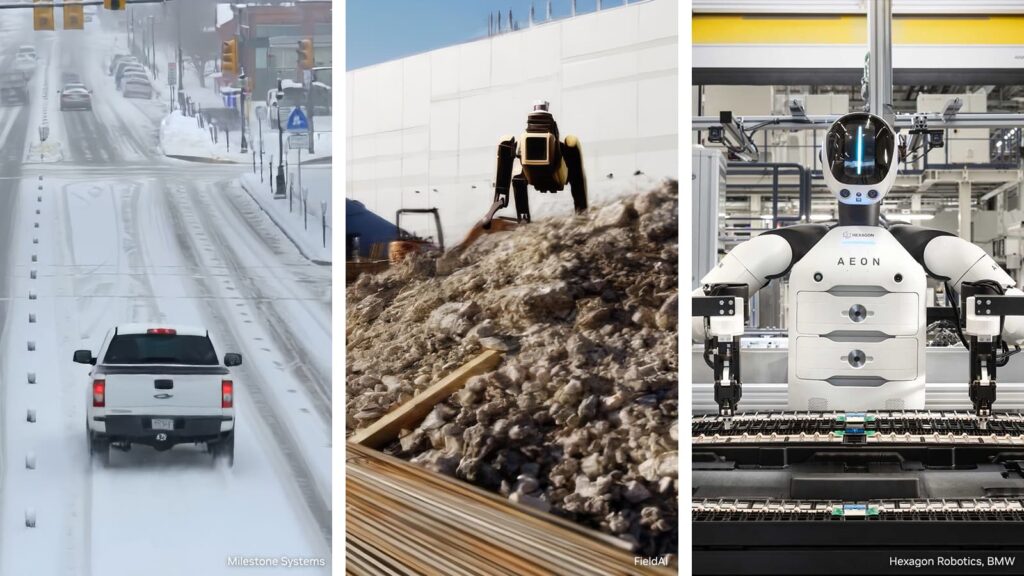

Ce lancement s’inscrit dans une tendance que NVIDIA construit depuis plusieurs mois autour du concept de « physical AI ». En janvier, la société a présenté Alpamayo, une famille ouverte de modèles et d’outils pour la conduite autonome, centré sur des scénarios complexes et un raisonnement sur la longue traîne des événements de trafic. Elle explique maintenant utiliser ce nouveau blueprint pour entraîner et évaluer Alpamayo, tandis que des entreprises comme Skild AI l’appliquent à des robots généralistes, et Uber l’utilise pour accélérer le développement de véhicules autonomes. Le plan de référence devient ainsi plus qu’un simple outil technique : il constitue une infrastructure de base pour alimenter le prochain cycle de modèles physiques.

Il existe également une lecture industrielle plus large. En robotique et en automobile, beaucoup d’entreprises échouent non pas par manque d’idées, mais à cause de la fragmentation entre simulation, entraînement, évaluation et déploiement. NVIDIA cherche à combler cette lacune avec une proposition combinant modèles du monde réel, simulation, génération synthétique, évaluation automatique et orchestration multi-infrastructures. Ce n’est pas une solution miracle ou un produit cloisonné généralisé, mais une indication claire de la direction du marché : moins d’outils isolés, plus de flux de données et de validation prêts à évoluer.

Il reste à voir combien de temps cette vision mettra pour se concrétiser en une adoption réelle au-delà des partenaires annoncés, et dans quelle mesure le blueprint ouvert pourra attirer développeurs indépendants, start-ups et fabricants hors de l’écosystème NVIDIA. Mais l’idée principale est claire : dans l’IA physique, l’avantage ne dépend pas uniquement du modèle ou du processeur, mais de celui qui sera capable de produire, de déboguer et de valider des données de meilleure qualité à une vitesse beaucoup plus grande. NVIDIA souhaite ainsi faire de la computation accélérée une véritable usine de données.

Questions fréquemment posées

Qu’est-ce exactement que NVIDIA Physical AI Data Factory Blueprint ?

Il s’agit d’une architecture de référence ouverte annoncée par NVIDIA pour automatiser la curation, la génération synthétique, l’amplification, l’évaluation et la préparation des données destinées à l’entraînement de robots, d’agents de vision artificielle et de véhicules autonomes.

Est-ce déjà disponible en téléchargement ?

NVIDIA indique que le blueprint complet sera disponible sur GitHub en avril 2026. Cependant, certains composants sont déjà publics, comme Cosmos Evaluator, et une partie de l’écosystème peut déjà être testée via des dépôts et services associés.

Quel rôle jouent Microsoft Azure et Nebius dans ce projet ?

Azure intègre le blueprint dans une chaîne d’outils open source pour l’IA physique publiée sur GitHub, tandis que Nebius l’a intégré à son AI Cloud comme base pour des flux gérés de génération de données, d’entraînement et de déploiement.

Pourquoi les données synthétiques sont-elles si cruciales en robotique et pour les véhicules autonomes ?

Parce qu’elles permettent de couvrir des cas rares ou dangereux, difficiles, coûteux ou longs à capturer dans le monde réel. Cela est essentiel pour entraîner des modèles plus robustes et valider leur comportement avant leur déploiement en production.