La course à l’Intelligence Artificielle n’est plus uniquement mesurée en téraflops. En 2026, le principal obstacle dans les centres de données haute performance s’appelle chaleur. À mesure que les racks se remplissent de CPU et GPU de plus en plus denses, la refroidissement par air commence à atteindre ses limites, et la discussion se déplace vers l’efficacité thermique, la consommation électrique et le coût total d’exploitation. Dans ce contexte, ASUS a présenté ses Solutions de Refroidissement Liquide Optimisées, accompagnées d’un « cadre stratégique » de partenaires visant à standardiser le déploiement du refroidissement liquide pour les infrastructures IA et HPC de prochaine génération.

La proposition repose sur une idée fondamentale : les centres de données conçus pour des plateformes d’IA à l’échelle des racks — ASUS mentionne explicitement des environnements basés sur de futurs systèmes NVIDIA Vera Rubin NVL72 — exigeront des solutions thermiques plus agressives, mais aussi plus industrialisables. Il ne suffit pas de refroidir ; il faut le faire de manière reproductible, évolutive et avec un support global, car le problème n’est plus de laboratoire : il s’agit d’un déploiement massif.

Un catalogue « de bout en bout » : direct-to-chip, CDU en ligne et hybrides

ASUS organise son offre comme un portefeuille complet avec trois approches principales :

- Direct-to-chip (D2C) : refroidissement liquide direct sur les composants, conçu pour extraire la chaleur là où elle se génère, réduisant la dépendance aux flux d’air importants.

- CDU en ligne : unités de distribution du liquide de refroidissement placées « en rangée » (à proximité des racks) pour gérer l’échange thermique et faciliter des déploiements denses sans transformer chaque installation en un projet artisanal.

- Configurations hybrides : combinaisons d’air et de liquide pour les cas où la transition complète vers le liquide n’est pas immédiate ou lorsque l’architecture le recommande.

Dans sa communication, ASUS insiste sur le fait que cette approche vise à répondre simultanément à trois pressions critiques : densité, puissance et efficacité énergétique. Le message est pragmatique : plus le niveau de calcul par rack augmente, plus la marge thermique se réduit, et plus le coût d’une erreur de conception devient élevé.

Un « écosystème validé » pour un déploiement à grande échelle

L’un des aspects les plus intéressants de l’annonce est l’accent mis sur le cadre de partenaires. ASUS ne souhaite pas simplement vendre des pièces de refroidissement, mais se présenter comme un intégrateur capable d’orchestrer un déploiement de bout en bout avec des fournisseurs d’infrastructure et de composants.

Dans cette optique apparaissent des noms tels que Schneider Electric et Vertiv en tant que partenaires d’infrastructure, ainsi que des fabricants spécialisés comme Auras Technology et Cooler Master, sans compter d’« autres leaders du secteur ». La conclusion est claire : le refroidissement liquide, lorsqu’il est poussé à l’extrême pour des racks ultra-denses, requiert une coordination fine entre mécanique, hydraulique, capteurs, matériaux et opérations. Cette coordination est d’autant plus simple lorsque l’on dispose d’une liste d’intégration « connue » et éprouvée.

ASUS complète cette annonce avec des chiffres destinés à renforcer la crédibilité technique : elle revendique 2 156 records de premier rang dans SPEC CPU® et 248 résultats en tête du classement MLPerf™. La société l’utilise comme preuve de « validation dans le monde réel » et comme signe que son expertise ne se limite pas au cadre physique, mais touche aussi la performance et la densité de calcul.

Cas de déploiement : un superordinateur IA refroidi par liquide à Taïwan

Pour étoffer son discours, ASUS présente un exemple concret : son déploiement pour le National Center for High-performance Computing (NCHC), dépendant des National Institutes of Applied Research (NIAR) à Taïwan. Dans ce projet, ASUS décrit une architecture de double calcul avec un cluster Nano4 NVIDIA HGX H200 et un système NVIDIA GB200 NVL72, présenté comme le premier déploiement à Taïwan d’un supercalculateur IA entièrement refroidi par liquide avec cette architecture.

Le point que la société met en avant pour cette installation est le PUE de 1,18, une valeur généralement interprétée dans le secteur comme un signe d’efficience énergétique remarquable pour des installations à haute densité. ASUS attribue cette performance à son recours à la refroidissement liquide direct (DLC), conçu « dès le départ » pour équilibrer performance et durabilité opérationnelle.

Dans une documentation complémentaire liée à ce cas, ASUS indique que le système Nano4 a atteint 81,55 PFLOPS et s’est classé n° 29 au TOP500, preuve que l’objectif ne se limite pas à « refroidir », mais à le faire dans des environnements où la recherche de performance globale est primordiale.

GTC 2026 : ASUS veut faire sensation lors du rendez-vous de Nvidia

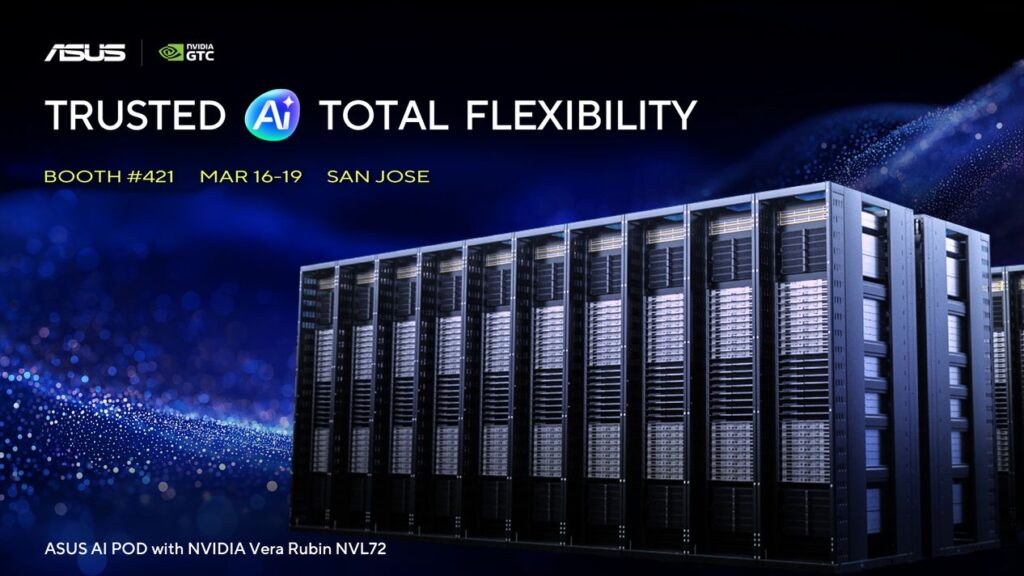

Ce lancement s’inscrit dans un calendrier très précis : NVIDIA GTC 2026, du 16 au 19 mars à San José (États-Unis). ASUS participera en tant que Diamond Sponsor et sera présente au stand #421, sous le slogan « Trusted AI, Total Flexibility ». Son objectif déclaré est de dévoiler une « nouvelle génération » d’écosystème de refroidissement liquide en partenariat avec Nvidia et d’autres partenaires d’infrastructure.

Ce choix n’est pas fortuit. GTC est devenu le point où l’écosystème valide, compare et négocie l’avenir immédiat de l’infrastructure IA. Et, dans un marché où la gestion thermique et électrique est devenue critique, le refroidissement liquide ne se limite plus à une option ; il devient une composante essentielle du produit.

Les enjeux pour le secteur : moins d’air, plus de liquide, moins d’improvisation

Au-delà de l’annonce d’ASUS, une tendance forte se dessine : le passage à des plateformes IA à l’échelle des racks et à des accélérateurs de plus en plus denses pousse le marché à adopter un modèle où le refroidissement liquide n’est plus une option « premium » mais une condition de faisabilité. Dans cette évolution, la valeur ne réside pas seulement dans le design thermique, mais aussi dans la capacité à le déployer avec des partenaires, des composants et des méthodes réplicables.

Si la prochaine vague de centres de données pour l’IA doit fonctionner dans un cadre de contraintes de puissance, d’espace et de durabilité, la bataille pour la performance se jouera toujours au même endroit : l’équilibre entre chaleur, énergie et coût. ASUS veut se positionner précisément sur ce terrain.

Foire aux questions (FAQ)

Qu’est-ce que le refroidissement liquide direct-to-chip (D2C) dans les racks d’IA et quand est-ce pertinent ?

Il s’agit d’une approche consistant à acheminer le liquide de refroidissement directement vers les CPU et GPU afin d’évacuer la chaleur à la source. Elle est généralement avantageuse dans les racks à haute densité où l’air seul ne parvient pas à évacuer suffisamment de chaleur sans augmenter de manière disproportionnée la consommation et le bruit.

À quoi sert une CDU en ligne dans un centre de données avec GPU à l’échelle des racks ?

Une CDU (Coolant Distribution Unit) en ligne gère le débit, la température et la distribution du liquide de refroidissement près des racks, facilitant des déploiements denses et réduisant la complexité hydraulique par rack.

Que signifie un PUE de 1,18 dans le contexte d’un supercalculateur refroidi par liquide ?

Le PUE compare l’énergie totale du centre de données à l’énergie consommée par le matériel informatique. Un PUE de 1,18 indique que l’efficience énergétique, en tenant compte des pertes et équipements auxiliaires, est relativement élevée dans un environnement de haute densité.

Pourquoi le refroidissement liquide est-il clé pour les systèmes comme le NVL72 et pour les futures plateformes d’IA ?

Parce que ces systèmes concentrent une puissance énorme par rack. À mesure que la densité d’accélérateurs augmente, la limite pratique réside dans la capacité à dissiper cette chaleur de manière stable et efficace, surtout lorsque la puissance électrique et l’espace sont des contraintes majeures.