L’industrie n’est pas encore prête pour le changement.

Les centres de données sont des infrastructures critiques supportant l’économie numérique. Ils traitent tout, des appels vidéo et du streaming de Netflix, aux transactions financières ou à l’entraînement de modèles d’intelligence artificielle (IA). Cependant, la consommation énergétique des nouveaux processeurs et GPU atteint des niveaux sans précédent, et la refroidissement par air traditionnel montre ses limites.

Dans ce contexte, la refroidissement par immersion — jusqu’ici considéré comme une technologie exotique, réservée aux supercalculateurs ou au minage de cryptomonnaies — s’impose comme la seule alternative viable à moyen terme. Mais l’industrie, encore attachée aux paradigmes du passé, n’est pas prête à adopter cette transformation à grande échelle.

La limite de l’air : pourquoi les méthodes traditionnelles ne suffisent plus

Depuis des décennies, la conception des centres de données repose sur des systèmes de refroidissement par air : allées froides et chaudes, sols techniques, ventilateurs de plus en plus puissants et stratégies sophistiquées de climatisation.

Ce modèle, malgré sa longévité, touche ses limites :

- Densité croissante : les racks IA et HPC dépassent aisément 50-100 kW, des chiffres impossibles à dissiper uniquement par l’air.

- Processeurs de plus en plus puissants : GPU tels que NVIDIA Blackwell ou AMD MI300 dépassant 700-1 000 watts par chip.

- Exigences réglementaires : l’Europe fixe des objectifs d’efficacité énergétique avec des valeurs de PUE proches de 1,1, difficiles à atteindre avec des systèmes de climatisation conventionnels.

Le résultat est clair : bien que bon marché et éprouvé, l’air n’est plus suffisant pour l’ère de la haute performance informatique.

Comment fonctionne et quels avantages offre la refroidissement par immersion

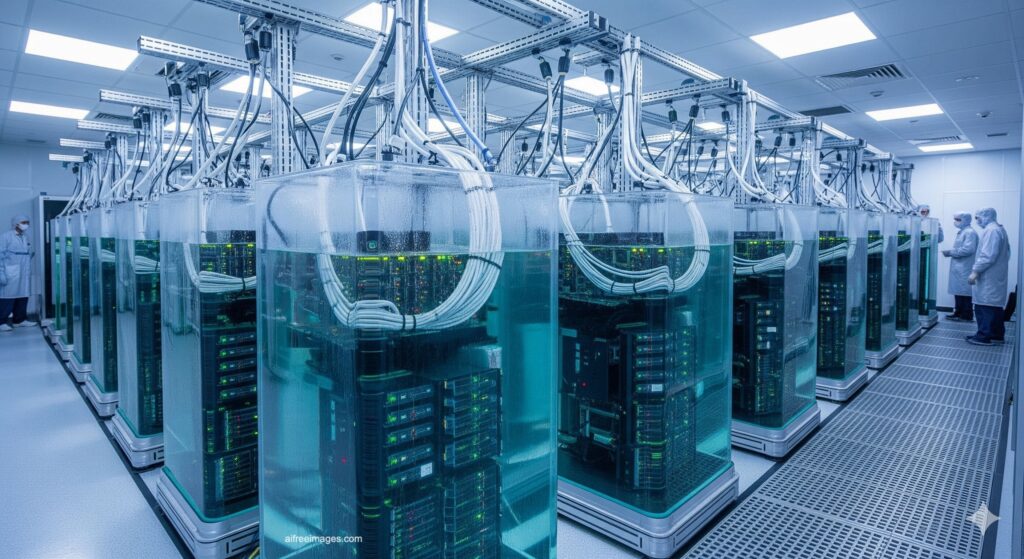

Le refroidissement par immersion consiste à immerger les serveurs dans des fluides diélectriques non conducteurs, capables d’absorber directement la chaleur générée par les composants électroniques.

Ses principaux avantages sont :

- Efficacité énergétique : peut atteindre des PUE inférieurs à 1,05.

- Densité accrue par rack : supporte des configurations de plus de 100 kW, essentielles dans les clusters IA.

- Réduction du bruit et des vibrations : en éliminant les ventilateurs, la durée de vie des équipements est prolongée.

- Soutenabilité : réduit la consommation d’eau comparé aux tours de refroidissement et facilite la réutilisation de la chaleur résiduelle dans les réseaux urbains ou les procédés industriels.

Des entreprises telles que Submer, GRC ou Asperitas ont déjà prouvé leur viabilité lors de projets pilotes. Même des géants comme Microsoft, Meta ou Alibaba y expérimentent à grande échelle.

Pourquoi n’est-elle pas encore adoptée massivement ?

Malgré ses bénéfices, le refroidissement par immersion ne représente actuellement moins de 1 % de la capacité installée mondiale.

Les obstacles sont nombreux :

- Inertie de l’écosystème : racks, serveurs et centres de données sont conçus pour l’air, pas pour les liquides.

- Coûts initiaux élevés : l’investissement initial peut être supérieur, bien que les économies opérationnelles soient importantes à moyen terme.

- Fluides non standardisés : les liquides diélectriques sont coûteux et il n’existe pas encore de consensus sur leur durabilité et leur recyclage.

- Culture du risque : les entreprises hésitent à immerger du matériel critique évalué à des millions d’euros.

- Support limité des fabricants : les grands OEM tels que Dell, HPE ou Supermicro commencent à certifier des équipements compatibles avec l’immersion.

Une évolution inévitable de plus en plus proche

La physique ne ment pas : l’air ne peut dissiper la chaleur générée par les centres de données du futur. Ainsi, le refroidissement par immersion n’est pas une mode passagère, mais une nécessité technique qui finira par s’imposer.

Selon les prévisions, le marché du refroidissement par immersion pourrait croître à un taux annuel supérieur à 20 % jusqu’en 2030. Cependant, cette croissance pourrait être insuffisante face à l’augmentation de la consommation électrique de l’IA, qui pourrait tripler ou quadrupler avant la fin de la décennie.

Une question se pose : l’industrie pourra-t-elle s’adapter à temps pour éviter une « crise de refroidissement » ?

Ce qu’il faut pour accélérer l’adoption

Pour que cette technologie devienne une norme, plusieurs étapes clés sont indiquées par les experts :

- Normalisation des fluides et équipements, avec des standards clairs pour réduire la perception du risque.

- Conception optimisée du matériel, pensée dès l’usine pour l’immersion, et non comme une simple adaptation.

- Formation des techniciens et opérateurs, capables d’entretenir des infrastructures liquides.

- Incinatives réglementaires, notamment en Europe et aux États-Unis, où les objectifs climatiques poussent l’industrie à améliorer l’efficacité énergétique.

Conclusion : l’avenir sous l’eau

La refroidissement par immersion apparaît comme la réponse inévitable aux enjeux thermiques de l’intelligence artificielle, de la haute performance informatique et du cloud à grande échelle. La question n’est plus si cette technologie sera adoptée massivement, mais quand et à quelle vitesse.

Ce qui semble aujourd’hui une technologie exotique deviendra, dans quelques années, une norme incontournable pour maintenir en marche l’économie numérique.

Questions Fréquentes (FAQ) sur le refroidissement par immersion

1. Quelle différence y a-t-il entre le refroidissement liquide traditionnel et l’immersion ?

Le refroidissement liquide classique utilise des circuits fermés d’eau ou de glycrol parcourant des blocs en contact avec les CPU et GPU. L’immersion, elle, immerge entièrement les équipements dans des fluides diélectriques, offrant une meilleure efficacité et supprimant les ventilateurs.

2. Combien coûte la mise en place du refroidissement par immersion ?

L’investissement initial peut être 20 à 40 % supérieur à un système par air, mais les économies d’énergie, de maintenance et d’espace permettent de rentabiliser l’investissement en 3 à 5 ans, selon la densité du centre.

3. Est-ce sûr pour les composants électroniques ?

Oui. Les fluides utilisés sont non conducteurs, conçus pour ne pas endommager les composants. D’ailleurs, certaines études indiquent que la durée de vie des serveurs peut être prolongée grâce à la réduction des vibrations et de la poussière.

4. Quel impact sur la durabilité ?

Très positif : réduction de la consommation d’eau, amélioration de l’efficacité énergétique et facilitation de la récupération de chaleur pour chauffage ou procédés industriels.

5. Quand sera-t-elle adoptée massivement ?

Les analystes estiment qu’entre 2027 et 2030, on assistera à un point de bascule, porté par la croissance de l’IA et par la pression réglementaire.