En moins d’une décennie, le domaine de l’intelligence artificielle a évolué, passant de la formation de modèles comportant des dizaines de millions de paramètres à travailler avec des trillions. Cette croissance — alimentée par des LLM comme GPT-4, Llama 3.1 ou Claude Sonnet — a représenté non seulement un défi algorithmique mais aussi un enjeu infrastructurel sans précédent. Les puces seules ne suffisent plus : c’est surtout leur interconnexion qui détermine la succès.

Dans ce contexte, NVIDIA NVLink est devenu la colonne vertébrale des usines d’IA. Avec le lancement de NVLink Fusion, l’entreprise franchit une étape supplémentaire : elle ouvre l’accès à sa technologie d’interconnexion pour que hiperscalers, gouvernements et grandes entreprises puissent bâtir des superclusters personnalisés, intégrant CPU et XPUs dans un même tissu de communication, à l’image des racks NVL72 et NVL300.

De PCIe à NVLink : une décennie de révolution silencieuse

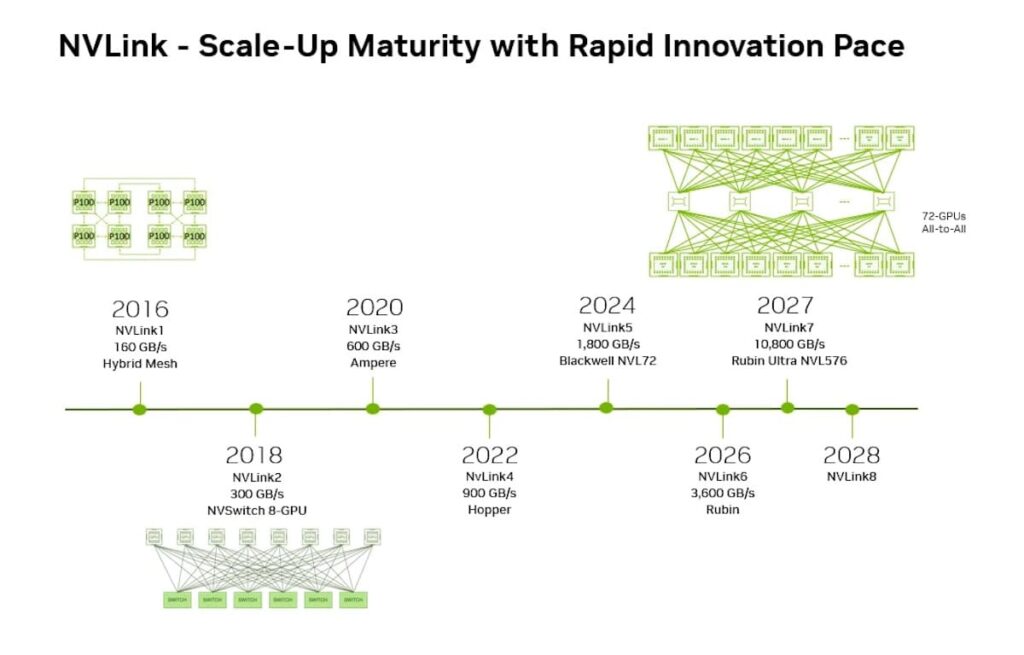

Lorsque NVIDIA a présenté en 2016 la première génération de NVLink, l’objectif était de dépasser les limitations de PCIe Gen3, devenue insuffisante pour la HPC et le deep learning. Depuis, l’évolution est rapide :

- NVLink 1 (2016) : communication GPU-GPU plus rapide que PCIe, mémoire unifiée.

- Switch NVLink (2018) : 300 GB/s pour des topologies de 8 GPUs, premier maillage de taille moyenne.

- NVLink 3 et 4 (2020-2023) : intégration du protocole SHARP pour les opérations collectives, réduction de la latence dans les grands clusters.

- NVLink 5 (2024) : support de 72 GPUs en mode tout-à-tout avec 1,8 TB/s par GPU et un débit total de 130 TB/s, soit près de 800 fois plus que la première génération.

Actuellement, les racks NVL72 — piliers des systèmes Blackwell GB200 — définissent la norme de facto dans les usines d’IA à exaéchelle.

Vraie fracture : l’inférence

Si les titres de presse mettent généralement en avant le coût de l’entraînement, les analystes s’accordent à dire que le véritable défi économique réside dans l’inférence : fournir en temps réel des résultats à des millions d’utilisateurs de ChatGPT, Gemini, Claude ou Copilot.

Ici, l’interconnexion est cruciale :

- Délai jusqu’au premier token (latence).

- Tokens par seconde par utilisateur (débit).

- Tokens par seconde par mégawatt (efficacité énergétique).

Les études internes de NVIDIA montrent que :

- Dans une maille de 4 GPUs, la performance chute à cause de la division de l’échange de bande passante.

- Dans un cluster de 8 GPUs avec Switch NVLink, l’interconnexion devient complète et l’efficacité bondit.

- Dans un domaine de 72 GPUs, les résultats explosent : débit maximal et latences minimales, impact immédiat sur coûts par inférence et marges bénéficiaires.

En pratique, chaque microseconde économisée lors du softmax ou du transfert mémoire se traduit par des millions d’euros par an en économies d’énergie ou capacité supplémentaire de service.

NVLink Fusion : l’ouverture maîtrisée de NVIDIA

Jusqu’ici, ces capacités étaient réservées à l’infrastructure pensée par NVIDIA. Avec NVLink Fusion, l’entreprise propose d’accéder à toute la pile d’interconnexion pour l’intégrer dans des systèmes semi-personnalisés :

- Chiplets NVLink et SERDES.

- Switches et topologies à l’échelle rack (NLV72 et NLV300).

- Écosystème de refroidissement liquide et gestion énergétique.

- Support logiciel complet (CUDA, NCCL, Triton, TensorRT-LLM).

En quoi consiste cette transformation ?

Les hyperscalers pourront :

- Intégrer des CPUs sur mesure avec GPUs NVIDIA via NVLink-C2C, tout en accédant à l’écosystème CUDA-X dans son ensemble.

- Concevoir des XPUs hybrides (accélérateurs à usage spécifique) connectés par NVLink à travers UCIe.

- Construire des usines d’IA sur-mesure, avec des racks modulaires mêlant GPUs, DPUs et processeurs conçus en interne.

Ce changement profond favorise : la sortie du schéma fermé, en permettant la co-conception directe d’infrastructures intégrant la technologie d’interconnexion NVIDIA.

Comparatif : NVLink vs PCIe et autres alternatives

| Technologie | Débit par GPU | Latence | Extensibilité | Usage typique |

|---|---|---|---|---|

| PCIe Gen6 | 256 GB/s | Élevée | Limitée (hôte-dispositif) | HPC, serveurs standards |

| NVLink 5 | 1,8 TB/s | Très faible | Jusqu’à 576 GPUs cohérents | Usines d’IA, racks NVL72 |

| Infinity Fabric (AMD) | environ 800 GB/s | Moyenne | Limité aux clusters MI | GPUs Instinct MI300 |

| CXL 3.0 | 512 GB/s | Moyenne | Forte potentiel (mémoire partagée) | Mémoire étendue, I/O |

L’avantage de NVLink ne réside pas uniquement dans l’amplitude du débit, mais surtout dans sa cohérence mémoire, permettant de traiter un domaine de 72 GPUs comme une seule entité, simplifiant considérablement la programmation.

Souveraineté numérique et enjeux géopolitiques

La démarche d’ouverture partielle de NVLink avec Fusion a aussi des implications géopolitiques. L’Europe, l’Inde et le Moyen-Orient œuvrent depuis plusieurs mois à des projets de souveraineté de l’IA, cherchant à réduire leur dépendance à l’infrastructure américaine.

Avec NVLink Fusion, NVIDIA assure :

- Contrôler l’écosystème CUDA.

- Permettre des personnalisations souveraines (CPUs propres, racks intégrés) tout en conservant la compatibilité aux librairies.

- S’assurer que les grands contrats d’IA souveraine (ex : Indonésie avec NVIDIA + Cisco + Indosat) soient déployés avec NVLink comme standard de référence.

L’avenir : NVLink au-delà de 72 GPUs

La feuille de route de NVIDIA est claire :

- NVLink 6, 7 et 8 sont déjà en planification, avec des sorties annuelles.

- Avant 2028, l’objectif est de dépasser 1 000 GPUs en domaine cohérent.

- De nouvelles interconnexions optiques, avec un débit prévu de 3-5 TB/s par GPU, sont en développement.

- À terme, l’ambition est que plusieurs usines d’IA distribuées fonctionnent comme un supercluster mondial unifié, relié par NVLink et réseaux optiques de faible latence.

Conclusion

Avec NVLink Fusion, NVIDIA ne renforce pas seulement sa domination en matière d’interconnexion GPU-GPU, mais ouvre aussi la voie à un écosystème plus flexible, où les grands acteurs du cloud et les gouvernements peuvent bâtir des infrastructures d’IA sur-mesure, tout en restant conformes au standard CUDA.

Dans cette ère où la latence par token conditionne les revenus d’une IA générative, NVLink Fusion n’est pas un luxe, mais une clé maîtresse pour conserver une compétitivité dans la course à la superintelligence.

Questions Fréquentes (FAQ)

Qu’est-ce que NVIDIA NVLink Fusion ?

C’est un programme qui démocratise la technologie NVLink (chiplets, switchs, racks, SERDES) pour l’intégrer dans des CPU et XPUs personnalisés, permettant de bâtir des infrastructure d’IA à la carte.

Quelle différence avec PCIe ?

NVLink propose jusqu’à 1,8 TB/s par GPU, une cohérence mémoire et une scalabilité jusqu’à 576 GPUs. PCIe Gen6 plafonne à 256 GB/s avec des latences plus élevées.

Pourquoi est-ce crucial pour l’inférence ?

Parce qu’il permet des clusters à faible latence et à plus haut débit par watt, réduisant coûts et temps de réponse pour des services massifs comme ChatGPT ou Copilot.

Quel rôle dans la souveraineté numérique ?

NVLink Fusion facilite la construction d’usines d’IA nationales ou régionales, avec CPU locaux ou XPUs hybrides, tout en conservant la compatibilité avec CUDA.

Source : Noticias inteligencia artificial