Nvidia a présenté Nemotron-4 340B, une famille de modèles de langage open source conçus pour générer des données synthétiques de haute qualité et développer des applications puissantes d’intelligence artificielle dans divers secteurs.

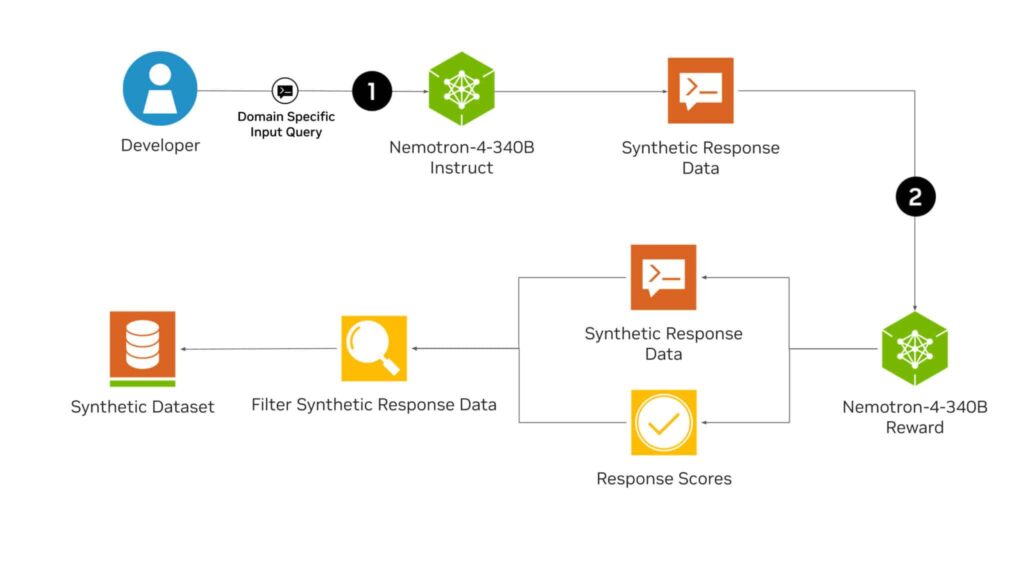

La famille Nemotron-4 340B comprend trois modèles clés : Base, Instruct et Reward, qui forment une chaîne pour créer des données synthétiques utilisées dans la formation de nouveaux modèles de langage à grande échelle (LLM). Le modèle Instruct génère des données synthétiques de haute qualité et a été formé avec 98% de données synthétiques, tandis que le modèle Reward filtre ces données pour sélectionner les exemples de la plus haute qualité.

Les modèles Nemotron-4 ont prouvé être compétitifs et même supérieurs à d’autres modèles open source comme Llama-3, Mixtral et Qwen-2 dans divers tests de référence. De plus, Nvidia a lancé Mamba-2 Hybrid, un modèle d’espace d’état sélectif (SSM) qui a dépassé les modèles LLM basés sur des transformateurs en terme de précision.

Nvidia n’a pas seulement fourni une famille de modèles open source qui équivaut aux capacités de ses principaux concurrents, mais excelle également dans la création de données synthétiques nécessaires pour continuer à avancer dans le développement de nouveaux LLM. Le géant de la fabrication de puces continue de se renforcer en tant que puissance dans le domaine de l’intelligence artificielle.

Lancement de la Famille Nemotron-4 340B

Nvidia annonce que les modèles Nemotron-4 340B sont optimisés pour fonctionner avec Nvidia NeMo, un cadre open source pour la formation de modèles de bout en bout, et avec la bibliothèque open source Nvidia TensorRT-LLM pour l’inférence.

Les développeurs peuvent télécharger Nemotron-4 340B depuis Hugging Face et seront bientôt disponibles sur ai.nvidia.com, où ils seront emballés comme un microservice NIM de Nvidia avec une interface de programmation d’applications standard qui peut être déployée n’importe où.

Génération de Données Synthétiques avec Nemotron

Les modèles LLM peuvent aider les développeurs à générer des données d’entraînement synthétiques dans des scénarios où l’accès à de grands ensembles de données étiquetées et diversifiées est limité. Le modèle Instruct de Nemotron-4 340B crée des données synthétiques diverses qui imitent les caractéristiques des données réelles, améliorant la qualité des données pour augmenter la performance et la robustesse des LLM personnalisés dans différents domaines.

Pour améliorer encore plus la qualité des données générées par IA, les développeurs peuvent utiliser le modèle Reward de Nemotron-4 340B pour filtrer les réponses de haute qualité. Ce modèle évalue les réponses selon cinq attributs : utilité, exactitude, cohérence, complexité et verbosité. Il occupe actuellement la première place dans le tableau de classement RewardBench de Hugging Face, créé par AI2.

Optimisation et Réglage avec NeMo et TensorRT-LLM

En utilisant les outils open source Nvidia NeMo et Nvidia TensorRT-LLM, les développeurs peuvent optimiser l’efficacité de leurs modèles Instruct et Reward pour générer des données synthétiques et évaluer les réponses.

Tous les modèles Nemotron-4 340B sont optimisés avec TensorRT-LLM pour profiter du parallélisme tensoriel, un type de parallélisme de modèles dans lequel les matrices de poids individuelles sont réparties entre plusieurs GPU et serveurs, permettant une inférence efficace à grande échelle.

Évaluation de la Sécurité et Début

Le modèle Instruct de Nemotron-4 340B a subi une évaluation de sécurité exhaustive, incluant des tests adversaires, et a performé de façon satisfaisante sur un large éventail d’indicateurs de risque. Néanmoins, il est recommandé aux utilisateurs de réaliser une évaluation soignée des sorties du modèle pour garantir que les données synthétiquement générées sont adéquates, sûres et précises pour leur cas d’utilisation.

Les développeurs peuvent télécharger les modèles Nemotron-4 340B via Hugging Face et accéder à plus de détails dans les documents de recherche sur le modèle et l’ensemble de données. Cette innovation de Nvidia promet de transformer la génération de données synthétiques et le développement d’applications IA dans de multiples secteurs.