NVIDIA présente Vera Rubin comme la prochaine grande plateforme pour l’ère de l’intelligence artificielle booléenne, et confirme officiellement qu’elle reste sur sa trajectoire : la société assure que Vera Rubin NVL72 est déjà en pleine production, et que ses systèmes basés sur cette génération commenceront à être déployés par ses partenaires dans la seconde moitié de 2026. Elle indique également que cette nouvelle architecture repose sur un écosystème mondial de plus de 80 partenaires, ainsi que sur une chaîne d’approvisionnement diversifiée, afin d’amener ses systèmes de type rack sur le marché.

Cependant, derrière cette feuille de route publique émerge une réalité moins idyllique, plus révélatrice sur la mode dont l’infrastructure IA d’aujourd’hui est construite. Un rapport récent de DIGITIMES, basé sur des sources de la chaîne d’approvisionnement en composants passifs, indique que la conception de la compute tray de Vera Rubin n’aurait pas encore été totalement finalisée, malgré la mise en production prévue pour le troisième trimestre. Selon cette même source, ces révisions refléteraient une stratégie plus agressive de diversification des fournisseurs et une volonté de réduire la dépendance à une unique source pour certains composants critiques. Il ne s’agit pas seulement d’un ajustement technique : NVIDIA serait en train de redessiner la façon dont elle souhaite fabriquer et approvisionner sa prochaine génération de systèmes.

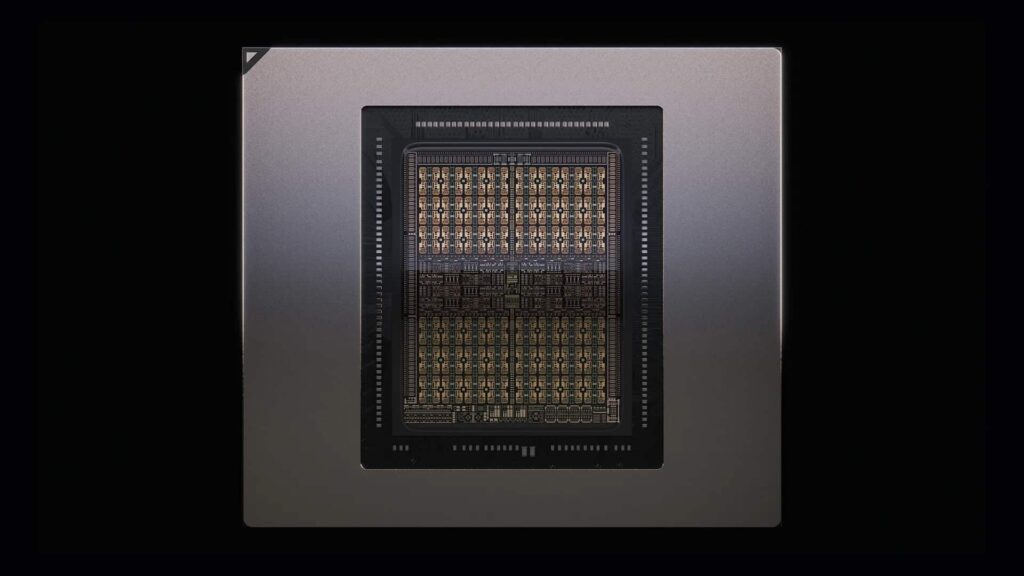

Ce point a une importance plus grande qu’il n’y paraît. Vera Rubin NVL72 n’est pas un serveur ordinaire : c’est une plateforme d’une complexité considérable. NVIDIA détaille que chaque rack contiendra 72 GPU Rubin, 36 CPU Vera, 18 compute trays et 9 planches de commutation NVLink, totalisant environ 1,3 million de composants. La société elle-même affirme que les compute trays de Vera Rubin ont été entièrement redessinées par rapport à Blackwell, avec une architecture interne conçue pour accélérer le montage et simplifier le maintien et la maintenance. Quand un système de cette envergure modifie encore certains éléments de sa nomenclature-BOM en phase préliminaire au déploiement massif, il ne s’agit pas d’un simple ajustement cosmétique : cela impacte les délais, la validation, la performance électrique et la capacité réelle à évoluer sans heurts.

Le problème ne se limite plus au seul design du rack idéal

La lecture la plus pertinente de cette possible révision ne concerne pas uniquement un risque de retard ponctuel, mais aussi un changement de priorités qu’elle pourrait suggérer. Depuis des années, la discussion sur les grands systèmes IA s’est concentrée sur les GPU, la mémoire HBM, ou l’interconnexion. Mais à mesure que le marché mûrit, la résilience de la chaîne d’approvisionnement devient une exigence aussi cruciale que la performance brute. NVIDIA en donne une preuve implicite en insistant sur son réseau mondial de partenaires et sur l’intégration entre calcul, réseau, stockage, énergie et refroidissement pour maximiser la disponibilité et accélérer la mise en production.

Dans ce contexte, un autre point clé ressort du rapport asiatique : Panasonic SP-CAP, un condensateur en polymère d’aluminium très prisé dans les applications exigeantes, n’aurait finalement pas été retenu pour la compute tray de Vera Rubin. Panasonic présente sa famille SP-CAP comme particulièrement adaptée aux charges soutenues en IA, tels que serveurs, commutateurs, routeurs ou stations de base, et recommande ses séries longue durée pour ces environnements. Mais cette spécialisation ne règle pas la problématique centrale qui préoccupe NVIDIA : la concentration de l’approvisionnement. Si un composant impose une dépendance excessive à un fournisseur ou à un groupe restreint d’approvisionneurs, le gain technique pourrait ne pas compenser le risque industriel associé.

Une alternative qui paraît gagner du terrain, d’après ces mêmes sources, concerne les MLCC à haute capacité, composants moins visibles pour le grand public, mais devenant stratégiques dans l’électronique de puissance pour IA. Des signaux forts indiquent que le marché se tend : Samsung Electro-Mechanics affirme que les serveurs IA utilisent entre 10 et 15 fois plus de MLCC que des serveurs classiques, et que la demande se déplace vers des composants à ultra-haute capacité et à haute tension. Murata, de son côté, a publié cette année un guide technique dédié à l’optimisation de l’alimentation électrique dans les serveurs IA, insistant sur le fait que la stabilité de l’alimentation devient un enjeu de premier ordre dans les centres de données de nouvelle génération.

Les condensateurs entrent aussi dans la guerre de l’IA

Ce qui semblait jusqu’alors relever de l’optimisation technique devient graduellement une variable stratégique et économique. Murata a reconnu lors de son rapport trimestriel de résultats pour le troisième trimestre fiscal 2026 que la demande pour les serveurs IA est « très dynamique », que le support client pèse désormais plus que le prix dans ce segment et que l’entreprise fonctionne avec une capacité utilisée de 90 à 95 %. Elle a même indiqué qu’en 2026, la grande question serait de savoir combien elle pourra produire et dans quelle mesure elle pourra répondre à la demande, tout en admettant que la capacité pourrait rester insuffisante ou que l’approvisionnement pourrait ne pas suivre le calendrier souhaité.

Ce contexte explique pourquoi un changement de composant dans Vera Rubin ne doit pas se limiter à une anecdote de fabrication. Avec des plateformes IA toujours plus denses, l’électronique de puissance devient critique : les MLCC passent du statut de composants invisibles à celui d’éléments sensibles, impactant le coût, l’approvisionnement et la capacité à évoluer. DIGITIMES avait déjà alerté en décembre 2025 que les MLCC commençaient à représenter une part significative du coût du BOM dans les serveurs IA, juste derrière les GPU et la mémoire. En 2026, TrendForce confirme un marché en durcissement, avec des hausses potentielles de tarifs et une pression accrue sur des fabricants comme Murata ou Samsung Electro-Mechanics.

Rien ne garantit toutefois que Vera Rubin subira un retard massif ou visible sur le marché. NVIDIA continue d’affirmer que la disponibilité sera au rendez-vous dans la seconde moitié de l’année, et rien dans sa feuille de route publique ne laisse entrevoir, pour l’instant, un report officiel. Mais cela dessine une réalité plus complexe : la prochaine grande plateforme IA dépendra non seulement de puces de pointe et de gros investissements, mais aussi de milliers de décisions discrètes concernant les fournisseurs, leurs marges et leur capacité à réagir face à une pièce qui pourrait poser problème ou devenir un goulet d’étranglement.

En définitive, Vera Rubin teste aussi la capacité de NVIDIA à industrialiser des systèmes de plus en plus complexes sans dépendances excessives. Si la résilience impose de revoir le design jusqu’au dernier instant, le marché pourrait finir par l’accepter. À l’ère de l’IA à l’échelle gigawatt, diversifier les fournisseurs ne relève plus d’une simple stratégie d’achat : cela devient une partie intégrante du processus de conception du produit.

Questions fréquentes

NVIDIA a-t-elle confirmé un retard de Vera Rubin en raison de changements dans la compute tray ?

Non. NVIDIA indique officiellement que Vera Rubin NVL72 est en production, et que ses systèmes arriveront dans la seconde moitié de 2026. Les seuls éléments dont on dispose pour l’instant proviennent de rapports de la chaîne d’approvisionnement, évoquant des révisions de conception et des ajustements possibles dans certains envois.

Pourquoi les MLCC sont-ils si importants dans un serveur IA ?

Parce qu’ils stabilisent l’alimentation électrique dans des systèmes à consommation très élevée et à densité de calcul extrême. Samsung Electro-Mechanics affirme que les IA utilisent entre 10 et 15 fois plus de MLCC qu’un serveur standard, et Murata concentre sa stratégie technique sur ce défi de gestion de puissance.

Qu’est-ce qui distingue Vera Rubin des générations antérieures ?

NVIDIA la décrit comme une plateforme totalement redessinée, intégrant 72 GPU Rubin, 36 CPU Vera, 18 compute trays et 9 planches NVLink par rack, avec une architecture interne simplifiée pour faciliter l’assemblage et la maintenance par rapport à Blackwell.

La diversification des fournisseurs peut-elle impacter le calendrier d’une plateforme IA ?

Oui. Changer de composants ou ouvrir le design à plusieurs fournisseurs peut renforcer la résilience à moyen terme, mais nécessite aussi de valider, d’ajuster et de revoir le BOM, ce qui peut allonger les délais en phase de préparation à la production de masse. C’est précisément ce que suggèrent les rapports sur Vera Rubin.

via : Jukan