L’Inde souhaite évoluer en première division de l’intelligence artificielle, et cette semaine l’a clairement affirmé depuis New Delhi. Lors du sommet AI Impact Summit, NVIDIA a renforcé sa présence dans le pays à travers une série d’accords et de collaborations visant un objectif précis : déployer une puissance de calcul à grande échelle, impulser des modèles souverains et faire de l’IA un levier pour l’industrie concrète — de l’administration et des services publics à la manufacturing, la banque ou les télécommunications.

En toile de fond, la IndiaAI Mission, une initiative gouvernementale dotée de ₹10.371,92 crore (environ plus de 1 milliard de dollars US), conçue pour créer une infrastructure nationale, bâtir des talents et collecter des données afin de favoriser une adoption massive de l’IA dans le pays.

Du projet pilote à l’infrastructure : le saut indispensable pour une IA à l’échelle nationale

Pendant des années, le débat sur l’IA s’est concentré sur des tests de concepts, des chatbots d’entreprise ou une automatisation limitée. En 2026, la discussion change de dimension : le goulot d’étranglement n’est plus uniquement l’algorithme, mais l’infrastructure — GPU, réseaux, énergie, refroidissement, chaîne d’approvisionnement et opération 24/7 — ainsi que la capacité à tout intégrer avec des garanties de sécurité et de contrôle.

C’est dans ce contexte que s’inscrivent les annonces autour des “usines d’IA” (« AI factories »), un terme de plus en plus fréquent pour décrire des centres et des plateformes conçus pour entraîner et exécuter des modèles de façon industrielle, avec pipelines de données, MLOps, observabilité, gouvernance et déploiements d’inférence à grande échelle.

Les partenariats clés : L&T, Yotta et E2E Networks

Parmi les initiatives remarquables en Inde, la collaboration avec Larsen & Toubro (L&T), visant à développer une infrastructure IA dans le pays à travers des déploiements énergétiques importants — y compris des installations de dizaines de mégawatts —, témoigne d’un changement d’échelle, en dépassant le simple laboratoire pour viser une capacité opérationnelle durable.

Parallèlement, Yotta Data Services a aligné sa feuille de route sur la disponibilité de matériel de nouvelle génération : des plans évoquent le déploiement d’environ 20 000 processeurs de la famille Blackwell dans sa plateforme cloud dédiée à l’IA, dans un cadre d’investissement atteignant plusieurs milliards de dollars.

Un autre acteur notable, E2E Networks, a présenté une stratégie centrée sur la construction de clusters de GPU pour fournir des services aux entreprises, développeurs et projets locaux, avec une logique en phase avec l’idée de « souveraineté » — infrastructure et capacité d’exécution sous contrôle et juridiction nationaux.

La couche “industrielle” : IA souveraine, modèles locaux et adoption sectorielle

La mission nationale ne se limite pas au hardware. La démarche vise aussi à faciliter l’accès au calcul, à encourager les jeux de données et modèles « made in India », à renforcer l’écosystème des startups et à habiliter l’adoption par secteur d’activité. Sur le terrain, il s’agit d’une course pour bâtir des capacités internes : des modèles de langage et modèles multimodaux, jusqu’à des stacks complets pour l’inférence, RAG, agents et automatisation d’entreprise.

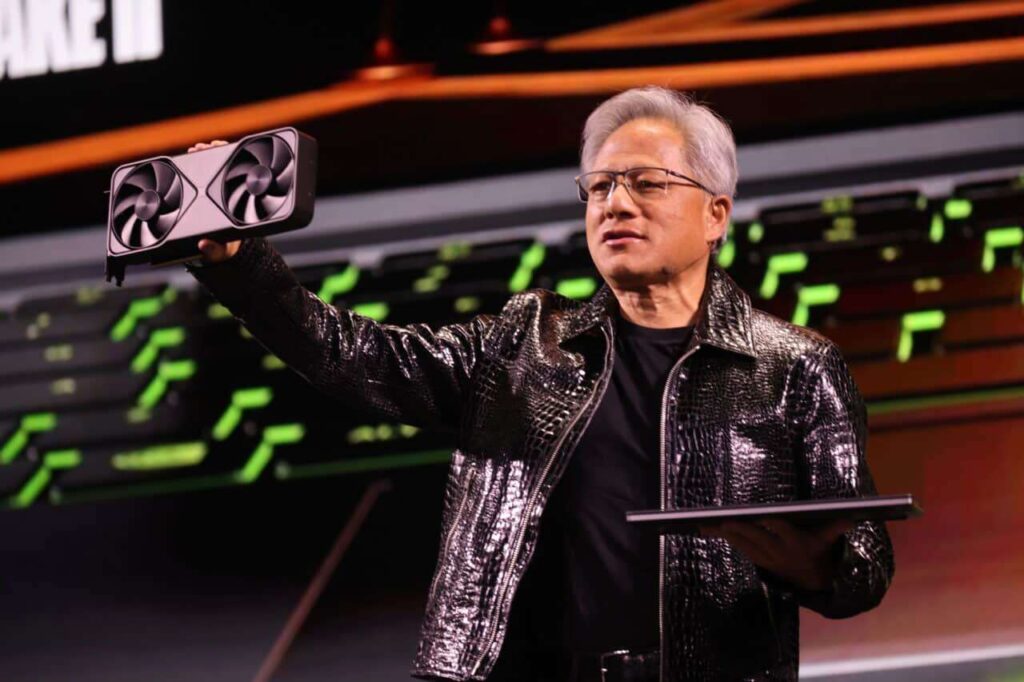

De son côté, NVIDIA insiste sur le fait que le pays doit disposer d’une infrastructure capable de porter des cas d’utilisation à fort impact économique — et dans des secteurs sensibles — sans dépendre exclusivement de fournisseurs étrangers. Lors des couvertures de l’événement, des collaborations et projets autour des “AI factories” et déploiements massifs de GPU ont été cités comme partie intégrante de cette montée en puissance.

Ce que cela implique pour les entreprises et les développeurs

Pour le marché, ces accords ont une lecture claire : une capacité accrue « en région » signifie moins de friction pour entraîner, affiner et déployer des modèles, ainsi qu’un accès plus prévisible à l’infrastructure pour l’inférence (notamment dans des applications nécessitant une faible latence). Pour les développeurs, l’impact est double :

- Ecosystèmes et outils plus standardisés : quand l’infrastructure s’ancre autour de stacks « de facto », il devient plus simple de porter les workloads, d’automatiser les déploiements et de surveiller.

- Davantage d’attention à l’inférence et aux agents : la croissance des assistants virtuels et des flux pilotés par agents pousse à optimiser le coût par token, la latence et l’orchestration, pas seulement la taille du modèle. Cela requiert souvent de combiner GPU, réseaux, stockage et une gestion très mature.

Les limites concrètes : énergie, opération et économie du calcul

Le revers de la médaille est moins glamour : déployer une IA à l’échelle nationale implique de faire face à des contraintes bien terrestres. Les centres de données à haute densité requièrent une alimentation stable, un refroidissement efficace, la disponibilité d’équipements, des talents pour leur exploitation et une chaîne de maintenance solide. Dans les marchés émergents — même avec un soutien politique —, la mise en œuvre dépend de calendriers de construction, de permis, de l’interconnexion électrique et de la capacité à attirer des clients pouvant assurer la rentabilité.

L’Inde essaie d’anticiper ce dilemme en construisant un « substrat » national de calcul, mais son succès dépendra de si l’accès aux GPU se traduit par une productivité mesurable : plus d’exportation de services, plus d’automatisation industrielle, plus de compétitivité et plus de startups capables d’évoluer rapidement.

Ce qui apparaît évident, c’est que l’IA ne se limite plus à une simple tendance logicielle. En 2026, c’est une question d’infrastructure, avec des enjeux d’investissement comparables à ceux des télécommunications, de l’énergie ou des transports numériques.