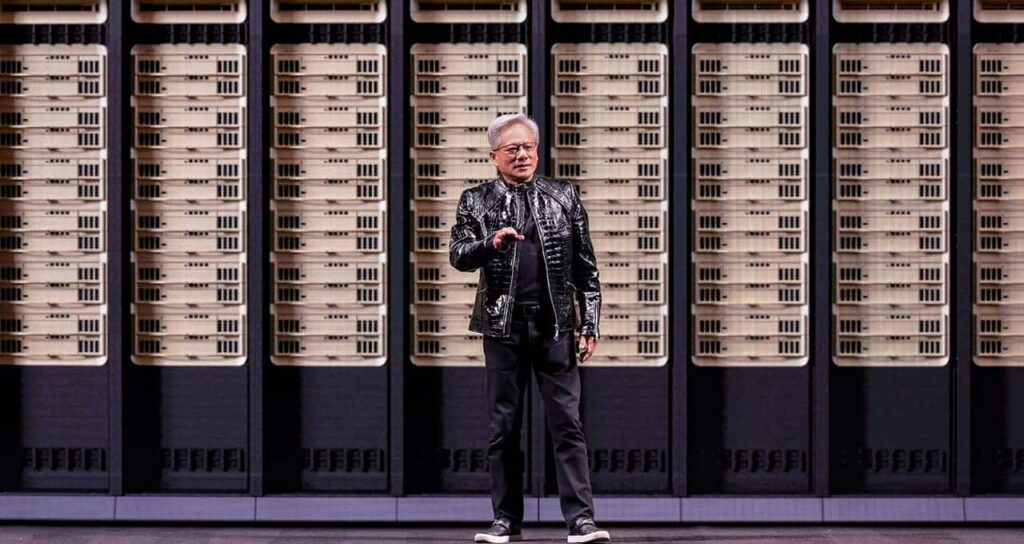

NVIDIA lance aujourd’hui la GTC 2026 à San José dans un contexte marqué par une approche différente de celle des années précédentes. La conférence se déroule du 16 au 19 mars, et la keynote de Jensen Huang est prévue pour ce lundi, lors d’un événement où la société elle-même annonce des nouveautés concernant l’Intelligence Artificielle, la computation accélérée et la robotique. Cependant, cette année, la priorité ne se limite pas simplement à augmenter la puissance brute, mais vise surtout à démontrer sa capacité à s’adapter à une nouvelle phase du marché : celle de l’inférence, des agents IA et de l’infrastructure à l’échelle industrielle.

La grande question quiplane sur cette GTC 2026 est de savoir si NVIDIA commencera réellement à nuancer sa vieille conviction selon laquelle une GPU peut quasiment tout résoudre dans le domaine de l’IA. Non pas que la GPU perde son rôle central, mais parce que le marché évolue. Reuters explique que les analystes anticipent une vague d’annonces destinées à renforcer la position de NVIDIA dans l’inférence et l’« IA agentique », alors que des concurrents, des clients et de nouveaux chips spécialisés commencent à exercer une pression accrue sur cette partie du marché, au-delà du simple entraînement de modèles.

Ce changement de focalisation n’est pas anodin. Au cours des dernières années, la narration sectorielle tournait principalement autour de l’entraînement des grands modèles, un domaine dans lequel Hopper, puis Blackwell, ont permis à NVIDIA de s’imposer comme une référence incontournable. Mais désormais, la conversation se déplace vers une autre nécessité : exécuter ces modèles rapidement, économiquement et à grande échelle pour des assistants, des agents et des applications d’entreprise. Reuters souligne que le marché de l’IA commence à s’orienter, depuis d’énormes clusters d’entraînement, vers une nouvelle couche de services où l’inférence et l’orchestration d’agents prennent de plus en plus d’ampleur.

Pour cette raison, une part importante des attentes entourant la GTC 2026 concerne Groq. Reuters rapportait le 13 mars que NVIDIA pourrait dévoiler des produits issus du rachat de Groq pour 17 milliards de dollars en décembre dernier, visant à renforcer sa position dans l’inférence rapide et économique. L’agence prévoit aussi l’apparition de nouvelles lignes de serveurs combinant chips Groq et technologies réseau de NVIDIA, un mouvement qui viserait précisément à compléter la GPU avec du hardware plus spécialisé pour certaines phases de l’inférence.

C’est là le cœur de l’enjeu. Aucune confirmation officielle, au moins avant la keynote, que NVIDIA abandonnerait strictement un modèle « GPU-only ». Cependant, plusieurs signaux montrent que la société cherche à étoffer sa plateforme avec des composants plus spécifiques, en fonction des charges de travail. Cela rejoint la thèse de Reuters : NVIDIA fait face à une concurrence croissante de chips sur-mesure, d’ASIC et de solutions internes proposées par des acteurs comme OpenAI ou Meta, notamment dans le domaine de l’inférence. Dans ce contexte, élargir l’éventail de composants de la plateforme a davantage de sens que de défendre une pureté architecturale que le marché commence à remettre en question.

La transition ne se limite pas à Groq. Reuters indique également que la GTC 2026 pourrait mettre davantage en lumière le rôle des CPU dans l’infrastructure IA, en particulier dans ce qu’on appelle la « couche d’orchestration des agents ». L’idée est que, si l’avenir immédiat consiste en des flottes d’agents se déplaçant entre applications, services et données, le vrai goulot d’étranglement ne sera pas seulement le calcul matriciel effectué par la GPU, mais aussi la coordination de ces tâches, la répartition des flux et la gestion des dépendances. Cela ouvre la voie à des serveurs centrés sur le CPU et à une architecture plus hétérogène que celle privilégiée jusqu’ici.

La majorité des informations officielles porte sur la feuille de route en matière d’infrastructure. NVIDIA prépare depuis plusieurs mois le terrain avec Rubin, Rubin Ultra et la prochaine génération de racks. En octobre 2025, la société expliquait dans son blog officiel que Vera Rubin NVL72 jouerait un rôle clé pour les « usines d’IA » et que l’architecture Kyber était conçue pour accueillir 576 GPU Rubin Ultra d’ici 2027. Par ailleurs, cette communication confirmait que Intel et Samsung Foundry rejoignaient l’écosystème NVLink Fusion, afin d’intégrer CPU x86 et chips personnalisés dans l’infrastructure NVIDIA. Même dans la documentation la plus récente, NVIDIA évoque une plateforme ouverte, intégrant divers siliciums, pas seulement des GPU isolés.

Un autre point qui pourrait gagner en importance concerne l’aspect technologique. Reuters signale que des explications supplémentaires seront attendues sur les investissements de 2 milliards de dollars réalisés par NVIDIA dans Lumentum et Coherent, deux sociétés spécialisées dans les lasers pour l’interconnexion optique. Par ailleurs, le blog officiel relie déjà Kyber et Rubin Ultra à des centres de données 800 VDC et à de nouvelles densités de racks conçues pour faire évoluer l’IA à l’échelle gigawaton. Tout indique que la GTC 2026 ne traitera pas uniquement de chips, mais aussi de réseaux, d’énergie, de refroidissement et de connectivité, considérés comme les pièces d’un même écosystème intégré.

Quant à Feynman, la prudence reste de mise. Reuters rapporte que les analystes anticipent une mise à jour de la feuille de route « de Rubin à Feynman », mais cela ne correspond pas encore à une présentation précise de produit ni à une validation des spéculations sur le nœud de fabrication, l’empilement ou l’intégration concrète avec de nouvelles unités d’inférence. Aujourd’hui, il est raisonnable de considérer Feynman comme le prochain grand jalon dans le roadmap de NVIDIA, sans en faire une sortie imminente avec des spécifications définitives déjà confirmées.

Au fond, la GTC 2026 pourrait annoncer quelque chose de plus profond qu’une simple évolution matérielle. Elle pourrait marquer le moment où NVIDIA admettra, même implicitement, que l’ère du « tout GPU » commence à devenir insuffisante pour la nouvelle économie de l’IA. Non pas parce que la GPU perdra son importance, mais parce qu’elle devra cohabiter avec des CPU plus visibles, des interconnexions optiques, des racks conçus comme des unités intégrées, et des chips spécialisés pour l’inférence. Si Jensen Huang confirme cette orientation aujourd’hui, la GTC 2026 ne sera pas qu’une simple conférence produit : ce sera une déclaration sur la manière dont NVIDIA prévoit de conserver sa domination, lorsque l’IA cessera de se limiter à l’entraînement pour devenir surtout un outil capable de fournir des réponses rapides, économiques et massives.

Foire aux questions

Quand se tient la GTC 2026 et quelle est la date de la keynote de Jensen Huang ?

La GTC 2026 se déroule du 16 au 19 mars 2026 à San José. La keynote de Jensen Huang est programmée pour le 16 mars.

NVIDIA a-t-elle officiellement confirmé une évolution totale hors GPU ?

Pas encore. Avant la keynote, aucune confirmation officielle d’un abandon complet de la stratégie basée sur la GPU n’a été communiquée. En revanche, des attentes fortes portent sur des annonces liées à l’inférence, aux agents IA, aux CPU et au matériel complémentaire, en lien avec le contexte marché et l’acquisition de Groq.

Quel rôle pourrait jouer Groq lors de cette GTC 2026 ?

Reuters évoque que NVIDIA pourrait présenter des produits liés à l’acquisition de Groq, centrés sur une inférence rapide et efficace, potentiellement intégrée à son écosystème réseau et plateforme.

Que sait-on officiellement de Rubin Ultra et Kyber ?

En octobre 2025, NVIDIA confirmait que Kyber est conçue pour accueillir 576 GPU Rubin Ultra d’ici 2027, s’inscrivant dans sa vision d’usines IA de haute densité, avec une architecture de rack innovante et une alimentation en 800 VDC.