Depuis des décennies, la robotique excelle dans des environnements où chaque détail est mesuré au millimètre près : lignes d’assemblage, environnements contrôlés, tâches répétitives et scénarios codés. Cependant, l’industrie cherche depuis un certain temps à franchir un cap qualitatif : développer des machines capables d’évoluer dans des contextes quotidiens, où chaque jour de nouveaux objets apparaissent, avec des interférences humaines et une marge d’erreur acceptable. Dans ce contexte, Microsoft Research a lancé Rho-alpha (ρα), son tout premier modèle de robotique issu de la famille Phi de modèles combinant vision et langage, avec pour objectif de rapprocher ce qu’on appelle l IA physique — la convergence entre intelligence artificielle orientée agent et systèmes physiques — afin de concevoir des robots capables de percevoir, de raisonner et d’agir de manière autonome et adaptative.

Ce lancement s’inscrit dans la vague des modèles VLA (vision-langage-action) pour systèmes physiques, une approche qui cherche à unir perception (vision), compréhension (langage) et exécution (action) dans un même cerveau opérationnel. Selon Ashley Llorens, vice-président corporate et directeur général de Microsoft Research Accelerator, ces modèles permettent aux systèmes physiques de gagner en autonomie dans des environnements beaucoup moins structurés, plus proches du monde réel que de l’usine.

De la compréhension d’instructions à la manipulation robotique

Rho-alpha est conçu pour convertir des commandes en langage naturel en signaux de contrôle pour des robots effectuant des manipulations bimanuelles, c’est-à-dire des tâches nécessitant une coordination fine des deux mains ou pinces : appuyer sur un bouton, tourner un commutateur, déplacer un curseur ou tirer sur un câble. Microsoft le qualifie de VLA+, car il étend ses capacités par rapport aux VLA classiques, notamment dans deux dimensions clés :

- Perception améliorée : intégrant la sensibilité tactile et, selon l’équipe, en cours d’intégration de modalités telles que la mesure de force.

- Apprentissage lors de l’exécution : le modèle vise à s’améliorer en opération en apprenant grâce à la rétroaction humaine, ce qui est particulièrement essentiel lorsque le robot se trompe ou se retrouve “bloqué” dans une manipulation.

Le fil conducteur de cette démarche est l’adaptabilité. En robotique, s’adapter ne se résume pas à un slogan : c’est la différence entre un système qui fonctionne lors d’une démonstration et un qui peut être déployé en production. Microsoft insiste sur le fait que des robots capables d’ajuster leur comportement dans des contextes dynamiques et selon les préférences humaines seront non seulement plus utiles, mais aussi plus fiables pour leurs opérateurs.

BusyBox, le « banc d’essai » pour l’interaction physique

Pour illustrer cette approche, Microsoft a utilisé BusyBox, une référence en matière de test physique récemment introduite par Microsoft Research. Dans les vidéos et exemples fournis, le robot répond à des instructions telles que « appuie sur le bouton vert », « retire le câble rouge », « tourne le commutateur » ou « déplace le curseur », en exécutant ces actions sur un dispositif conçu pour évaluer ses compétences en manipulation dans des conditions réalistes.

BusyBox revêt une importance capitale pour une raison simple : pendant des années, il a été difficile d’évaluer les progrès en robotique faute de tests standardisés reflétant la variété du monde physique. Un banc d’essai combinant objets, résistance mécanique, tolérances et défaillances potentielles permet d’évaluer une capacité essentielle en robotique : la résilience, c’est-à-dire la faculté à se rétablir lorsque les choses ne se déroulent pas comme prévu.

Le principal obstacle : les données (et leur côté tactile)

Si un problème majeur subsiste dans la robotique moderne, c’est la pénurie de données d’entraînement à une échelle comparable à celle nécessaire aux IA de traitement du langage ou de vision. Enregistrer des démonstrations physiques est coûteux, long, et parfois impraticable. C’est pourquoi Microsoft met en avant le rôle central de la simulation pour pallier cette absence de données, notamment pour inclure des signaux moins courants comme le tactile.

La stratégie de l’équipe combine :

- Trajectoires de démonstrations physiques (données réelles).

- Tâches simulées générées via un pipeline multi-étapes, basé sur l’apprentissage par renforcement.

- Une intégration de la simulation avec le framework NVIDIA Isaac Sim et l’utilisation de Azure pour produire des ensembles de données synthétiques, physiquement crédibles.

- Une co-formation supplémentaire avec des données web en question-réponse visuelle pour injecter une compréhension combinée de la vision et du langage.

Cette démarche n’est pas anodine : la robotique a besoin de modèles qui ne se contentent pas de « voir », mais qui aussi ressentent et adaptent leur action en temps réel. Le sens du toucher devient ainsi plus qu’un simple accessoire : il peut réduire considérablement les erreurs lors de manipulations d’objets, de connecteurs ou de pièces avec des tolérances strictes.

Humains dans la boucle : correction pour mieux apprendre

Microsoft reconnaît un autre défi crucial : même avec une perception élargie, les robots peuvent commettre des erreurs difficiles à corriger seuls. C’est pourquoi l’équipe développe des outils et techniques pour que le système apprenne par correction humaine pendant l’exécution, par exemple via des dispositifs de téléopération intuitifs comme une souris 3D. Dans ses démonstrations, un scénario d’insertion de prise illustre comment le robot, en difficulté, reçoit une aide humaine en temps réel pour finaliser sa tâche.

Ce principe « humain dans la boucle » n’est pas anecdotique : dans des environnements réels, la capacité à basculer entre autonomie et assistance détermine si un robot réduira la charge de travail ou augmentera la complexité avec des incidents imprévus.

Les perspectives : évaluation, accès anticipé et développement futur

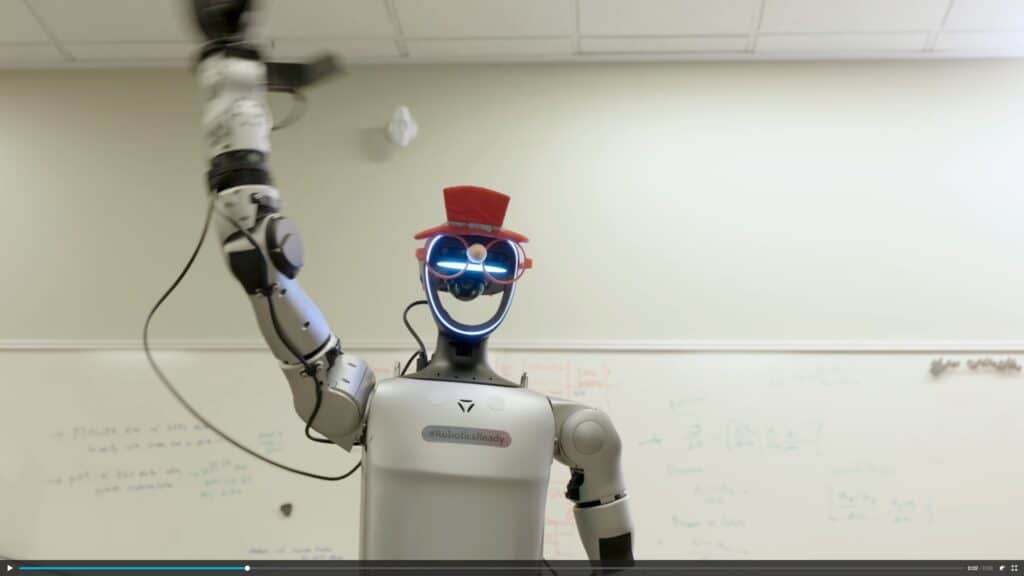

Microsoft indique que Rho-alpha est actuellement en phase d’évaluation dans des configurations de double bras et de robots humanoïdes. Une description technique sera publiée dans les prochains mois. Par ailleurs, l’entreprise invite les organisations intéressées à rejoindre un programme d’accès anticipé (Research Early Access Program), tandis que le modèle devrait aussi prochainement être intégré à Microsoft Foundry.

Dans le secteur industriel, le message est clair : la course à l’IA ne se limite plus à générer du texte ou des images. Elle s’oriente vers des systèmes capables d’interagir avec le monde physique, requérant une perception multimodale avancée, un contrôle précis et un apprentissage en continu. Sur cet échiquier, le sens du tact — associé à la simulation et à la correction humaine — apparaît comme un catalyseur essentiel pour faire passer la robotique de la démonstration spectaculaires à l’utilité concrète.

Questions fréquentes

Qu’est-ce qu’un modèle VLA et pourquoi est-il clé en robotique ?

Un modèle VLA (vision-langage-action) cherche à relier ce que le robot voit, ce qu’il comprend en langage naturel, et ce qu’il contrôle par ses actions, afin de fonctionner dans des environnements moins structurés que dans l’industrie classique.

Quel rôle joue le « tact » dans un robot par rapport à la seule vision ?

Le sensation tactile permet de détecter contact, résistance et glissements, ce qui est crucial pour des manipulations fines (branches, interrupteurs, câbles, pâtés) où la vision seule peut être insuffisante à cause d’occlusions ou de variations physiques.

Qu’est-ce que BusyBox et à quoi sert-il ?

BusyBox est un banc d’essai physique développé par Microsoft Research pour tester les compétences d’interaction et de manipulation à partir de commandes en langage naturel, telles que faire glisser un curseur, actionner un interrupteur ou tourner un bouton.

Quand pourra-t-on utiliser Rho-alpha en dehors du laboratoire ?

Microsoft prévoit un programme d’accès anticipé pour les organisations intéressées, puis la mise à disposition future via Microsoft Foundry. Une publication technique détaillée est également attendue prochainement.

Source : Microsoft Research

Guide ultime de la mémoire RAM : qu’est-ce que c’est, types, DDR4 vs DDR5 et comment choisir correctement