Une opération sophistiquée révèle comment des identités synthétiques générées par intelligence artificielle sont utilisées pour contourner les processus de recrutement mondiaux.

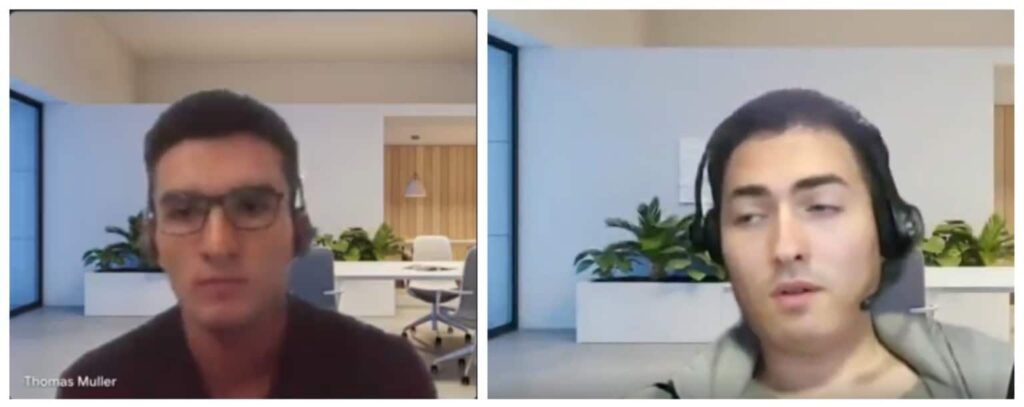

Le groupe Unit 42 de Palo Alto Networks a dévoilé une campagne inquiétante de cyber-infiltration orchestrée par des travailleurs informatiques liés au régime nord-coréen, qui utilisent des technologies de deepfake en temps réel pour obtenir des emplois à distance dans des entreprises à travers le monde. L’objectif final : contourner les sanctions internationales et obtenir un accès privilégié aux environnements corporatifs.

Une nouvelle frontière dans l’ingénierie sociale numérique

Selon le rapport, ces opérateurs nord-coréens créent de fausses identités grâce à des techniques de substitution faciale (face-swapping) lors d’entretiens d’embauche en ligne, simulant plusieurs candidats depuis un même équipement. En utilisant du matériel abordable — dans un cas, une GPU NVIDIA GTX 3070 sur un ordinateur portable vieux de cinq ans —, un utilisateur sans expérience préalable a réussi à mettre en place une identité fictive fonctionnelle en un peu plus d’une heure.

Cette accessibilité technologique augmente le niveau de risque pour les organisations, qui pourraient faire face à des violations de la sécurité, des fuites de données et même des sabotages internes de la part d’acteurs soutenus par des États.

Faiblesses techniques des deepfakes : une opportunité pour les détecter

Bien que la technologie de deepfake ait évolué rapidement, elle présente encore certains défauts qui peuvent être utilisés pour sa détection. L’équipe de Unit 42 a identifié plusieurs indicateurs clés :

- Incohérences temporelles : les mouvements rapides de la tête causent des artefacts visuels en raison de problèmes de suivi des traits du visage.

- Gestion des occlusions : si une main passe devant le visage, le système échoue à reconstruire la partie cachée.

- Problèmes d’éclairage : des changements brusques de lumière peuvent révéler qu’il s’agit d’un visage généré.

- Désynchronisation labiale : de légers délais entre l’audio et les mouvements des lèvres peuvent révéler la manipulation.

Stratégies pour atténuer le risque

Les experts recommandent une défense en couches pour protéger les processus de recrutement contre ces menaces émergentes. Quelques recommandations clés incluent :

Pour les équipes des ressources humaines :

- Enregistrer les entretiens (avec autorisation préalable) pour une analyse criminelle ultérieure.

- Incorporer des processus de vérification d’identité avec détection de vie.

- Former les intervieweurs à identifier les signaux de manipulation visuelle ou de désynchronisation.

Pour les équipes de sécurité :

- Surveiller les adresses IP suspects ou les emplacements inhabituels.

- Vérifier l’origine des numéros de téléphone (VoIP ou virtuels).

- Bloquer l’utilisation de caméras virtuelles ou de logiciels de manipulation non autorisés.

- Établir des partenariats d’échange d’informations avec d’autres entreprises et agences gouvernementales.

De plus, il est conseillé de mettre en place des contrôles d’accès progressifs pour les nouveaux employés et de renforcer les politiques internes contre l’usurpation d’identité, y compris des protocoles d’action et des campagnes de sensibilisation à la cybersécurité.

Un nouveau front dans la guerre cybernétique

Ce phénomène ne représente pas seulement une avancée des techniques d’ingénierie sociale, mais aussi une nouvelle voie pour la Corée du Nord afin d’éluder les restrictions économiques et d’obtenir un financement par le biais d’emplois à distance frauduleux. La manipulation des entretiens via des deepfakes ajoute une couche de complexité sans précédent au processus de sélection des talents.

Dans un environnement de plus en plus numérique et décentralisé, les départements des ressources humaines et de la cybersécurité doivent travailler en étroite collaboration pour établir des mécanismes de défense avancés garantissant l’intégrité du personnel recruté. Le deepfake, autrefois une curiosité technologique, se consolide rétrospectivement comme un outil d’attaque entre les mains d’acteurs étatiques. Et la meilleure défense commence par la capacité à le détecter.

Source de l’image : Daniel Grek Sanchez Castellanos et Bettina Liporazzi.

source : GBhackers et Palo Alto.