Langfuse : Une plateforme open source essentielle pour la gestion des applications avec des modèles de langage

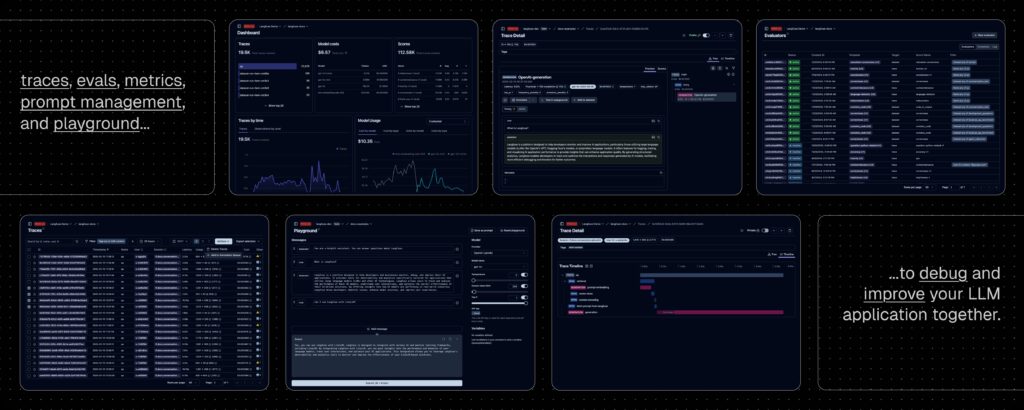

Langfuse s’impose comme une plateforme open source incontournable pour le développement, l’observabilité et l’évaluation d’applications basées sur des modèles de langage. Grâce à son approche cloud-native et à ses capacités d’intégration dans des flux CI/CD, elle devient un outil stratégique pour tous les équipes travaillant à grande échelle avec l’IA générative.

Avec l’augmentation constante de l’utilisation des modèles de langage (LLM) dans divers secteurs tels que le commerce, le support client, la médecine et la finance, disposer d’une infrastructure d’observabilité adaptée est désormais indispensable. Langfuse, développée au sein de l’écosystème Y Combinator (W23), se positionne comme l’un des principaux alliés des entreprises désireuses de comprendre, optimiser et étendre leurs applications reposant sur l’IA générative.

Sa technologie permet une intégration complète dans des environnements cloud publics et privés, que ce soit via Kubernetes, Terraform ou Docker Compose. Langfuse fournit une visibilité intégrale sur les interactions avec les modèles LLM, tout en offrant des outils de collaboration, de tests automatisés et une traçabilité approfondie.

Observabilité avancée pour les applications basées sur l’IA

Langfuse répond à un besoin croissant dans les domaines cloud et de l’IA : l’absence d’une observabilité structurée pour les applications reposant sur des modèles de langage. Contrairement aux journaux traditionnels, les LLM nécessitent la capture de contextes complexes, d’actions en chaîne (comme le retrieval, les embeddings ou les décisions d’agents) et de métriques de qualité de génération.

Avec Langfuse, les équipes peuvent :

- Enregistrer et visualiser des traces détaillées de chaque appel aux modèles.

- Inspecter le flux complet des opérations et des décisions en temps réel.

- Corriger les erreurs depuis un environnement interactif (LLM Playground).

- Versionner et tester des prompts de manière collaborative.

- Réaliser des évaluations automatiques (LLM-as-a-judge) avec retour humain ou pipelines personnalisés.

Intégration complète dans les environnements DevOps et LLMOps

L’approche cloud-native de Langfuse permet de l’intégrer dans n’importe quel pipeline moderne de déploiement ou de monitorage. Ses SDK pour Python et JavaScript/TypeScript, associés à une API publique documentée avec OpenAPI, simplifient son utilisation dans des environnements de test locaux ou des systèmes CI/CD complexes.

Langfuse s’intègre directement avec :

- LangChain, LlamaIndex, Haystack, DSPy, LiteLLM, OpenAI, entre autres frameworks LLM.

- Des outils de visualisation tels que Flowise, Langflow ou OpenWebUI.

- Des modèles d’exécution locaux (comme Ollama) ou distants (Amazon Bedrock, HuggingFace).

- Des plateformes multi-agents comme CrewAI, Goose ou AutoGen.

Cette capacité d’intégration assure une traçabilité totale du comportement des modèles déployés et permet de réaliser des tests de régression, des évaluations comparatives et des audits de performance, tout en gardant le contrôle sur l’infrastructure.

Déploiement flexible, confidentialité garantie

Langfuse peut être déployée en quelques minutes localement, sur une machine virtuelle ou en Kubernetes. La version Langfuse Cloud, proposée en tant que SaaS, inclut un généreux niveau gratuit sans nécessiter de carte de crédit. Pour les organisations qui gèrent des données sensibles ou évoluent sous des réglementations strictes, l’option d’auto-hébergement reste la voie privilégiée.

Concernant la confidentialité, Langfuse ne partage pas de données avec des tiers, et son système de télémétrie peut être complètement désactivé, garantissant ainsi la conformité dans des secteurs tels que la banque, la santé ou la défense.

Cas d’utilisation concrets et adoption croissante

Des projets leaders de l’écosystème LLM comme Dify, LobeChat, Langflow, MindsDB, ou Flowise utilisent Langfuse comme base de traçabilité. Cela témoigne de sa maturité technologique et de la solidité de sa communauté. Des entreprises développant des chatbots, des assistants intelligents ou des outils d’analyse sémantique adoptent déjà Langfuse pour mieux contrôler et étendre leurs opérations.

De plus, Langfuse facilite l’adoption de bonnes pratiques en matière d’IA responsable, permettant de surveiller le comportement des modèles, de collecter des retours utilisateurs et de prévenir des résultats inattendus ou biaisés.

Une couche d’infrastructure cruciale pour l’IA générative

À mesure que les LLM s’intègrent au cœur des activités de nombreuses entreprises, Langfuse se consolide comme une solution essentielle dans l’écosystème d’observabilité. Elle non seulement accélère le développement, mais également apporte transparence, fiabilité et efficacité dans des environnements cloud.

Pour les organisations opérant à l’international, Langfuse propose un support pour des déploiements en UE ou aux États-Unis, respectant ainsi les exigences de souveraineté des données. Pour des architectures hybrides ou en périphérie, son design modulaire permet une adaptation sans friction.

Conclusion

Langfuse représente l’évolution naturelle des systèmes de traçabilité à l’ère de l’intelligence artificielle générative. Grâce à son approche modulaire, à sa capacité d’auto-hébergement et à sa compatibilité avec l’écosystème LLM, elle est indispensable pour les équipes d’ingénierie et d’opérations œuvrant avec l’IA dans le cloud.

Dans un avenir dominé par l’IA conversationnelle, la traçabilité n’est pas une option, mais une nécessité. Langfuse est à la pointe de cette évolution.

🔗 Pour en savoir plus : langfuse.com

🛠️ Répertoire GitHub : langfuse/langfuse

Source : Actualités IA