Un groupe de protestation auto-proclamé «Sora PR Puppets» a divulgué sur Hugging Face l’accès au modèle vidéo Sora d’OpenAI, qui n’avait pas encore été officiellement lancé. Cette fuite a révélé des avancées significatives dans les capacités du modèle, mais a également généré des critiques envers les pratiques de l’entreprise dans son programme d’accès anticipé.

Une fuite inattendue et temporaire

Le modèle divulgué a été disponible sur la plateforme Hugging Face pendant plusieurs heures avant d’être retiré. Pendant ce temps, les utilisateurs ont pu générer des clips vidéo de jusqu’à 10 secondes en résolution 1080p, se distinguant par des temps de rendu significativement inférieurs aux 10 minutes qui avaient été rapportés auparavant.

Bien que les vidéos comportaient des filigranes d’OpenAI, l’implémentation temporaire a offert aux utilisateurs un premier aperçu du potentiel de Sora. Selon les rumeurs, OpenAI entraîne une nouvelle version du modèle qui inclurait des fonctionnalités avancées telles que l’in-painting (remplissage d’images) et la génération d’images à partir de vidéos.

Le centre de la controverse : des artistes non rémunérés

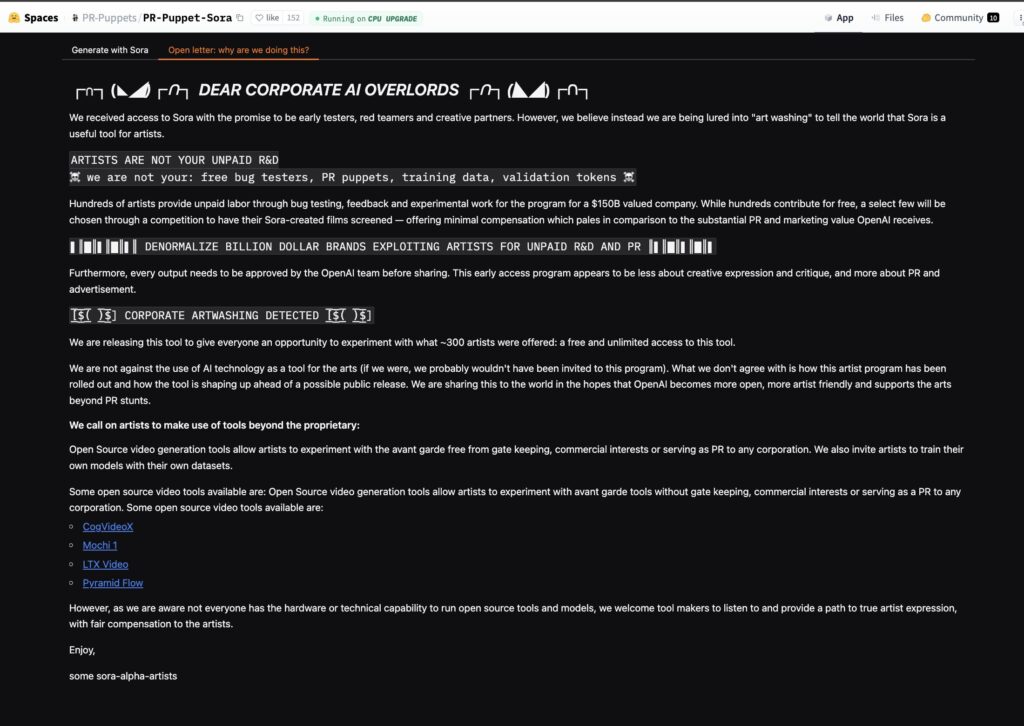

La fuite n’a pas seulement exposé le modèle, mais aussi les tensions sous-jacentes dans le développement du projet. Le groupe «Sora PR Puppets» accuse OpenAI de recruter des centaines d’artistes pour des tests sans compensation économique, tout en maintenant un contrôle strict sur le contenu généré et sa distribution.

Ces critiques ont ravivé le débat sur la dépendance des grandes entreprises technologiques à la collaboration créative non rémunérée et les implications éthiques de telles pratiques.

Concurrence sur le marché de l’IA vidéo

Alors que des entreprises concurrentes accélèrent le développement et le lancement d’outils vidéo basés sur l’intelligence artificielle, OpenAI a choisi de maintenir Sora dans une phase fermée de tests. Cela a alimenté la curiosité sur la façon dont sa technologie se compare aux alternatives existantes sur le marché.

Bien que les capacités de Sora semblent prometteuses, les experts s’accordent à dire qu’elles ne représentent pas une avancée disruptive par rapport aux solutions déjà disponibles. Cependant, la fuite pourrait forcer OpenAI à accélérer sa stratégie de lancement et à répondre aux critiques concernant sa relation avec les collaborateurs créatifs.

L’impact sur OpenAI

La fuite de Sora souligne les tensions inhérentes entre l’innovation technologique et la collaboration artistique. Pour OpenAI, cet incident représente non seulement un défi technique, mais aussi réputationnel, la question de l’éthique derrière son modèle de développement et de test étant remise en cause.

Il reste à voir comment cette controverse affectera la perception d’OpenAI et si elle ajustera son approche pour équilibrer ses avancées technologiques avec des pratiques plus inclusives et éthiques dans le développement de l’intelligence artificielle.

Références : Noticias Inteligencia Artificial, Twitter @rowancheung et Hugging face.

Please note that the <script> tag with Twitter widgets source is not included as it’s JavaScript code and not a part of the needed translation.