L’intelligence artificielle a profondément transformé notre façon de travailler, de communiquer et même d’apprendre. Mais derrière chaque avancée technologique se cache un débat de plus en plus brûlant : qu’en est-il des données des utilisateurs ? C’est maintenant Anthropic, l’entreprise créatrice de Claude AI, qui se retrouve au centre de la controverse après avoir annoncé un changement dans ses politiques de confidentialité et ses conditions d’utilisation.

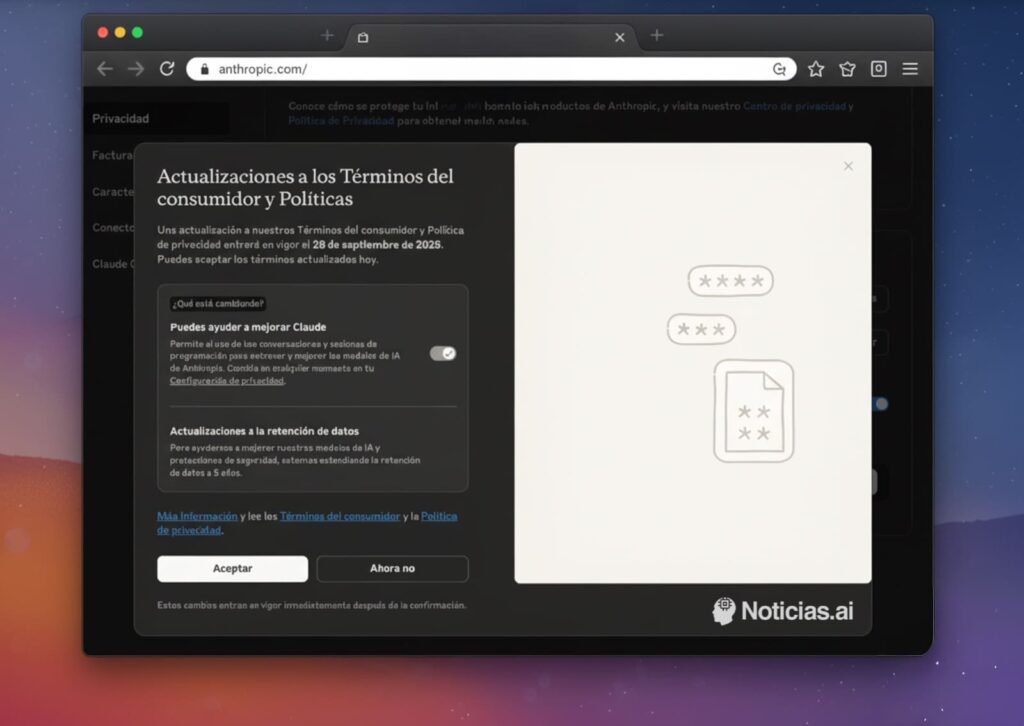

À partir du 28 septembre 2025, toutes les conversations avec Claude pourront être utilisées pour entraîner ses modèles d’IA. Et cela sera par défaut, sauf si les utilisateurs désactivent manuellement cette option dans leurs paramètres de confidentialité.

De la promesse de confidentialité à une stratégie en mutation

Jusqu’à présent, Anthropic se distinguait d’autres géants tels qu’OpenAI ou Google en promettant que Claude AI n’utilisait pas les interactions de ses utilisateurs comme matière première pour l’entraînement. Cette promesse est désormais rompue.

L’entreprise explique que ce changement vise à « renforcer la protection contre les abus, fraudes et la génération de contenus nuisibles », tout en améliorant la qualité et la sécurité de ses modèles. Toutefois, la mise en œuvre — un système opt-out où l’utilisateur doit manuellement se désinscrire — suscite des inquiétudes.

Mode d’emploi pour l’exclusion volontaire

Le processus est simple mais peu visible. Les utilisateurs doivent accéder à la page de paramètres de confidentialité et décocher la case « Vous pouvez aider à améliorer Claude », activée par défaut.

Sans cette désactivation, leurs données seront enregistrées et disponibles pour Anthropic durant une période pouvant aller jusqu’à cinq ans. Cette durée de conservation, inhabituelle, a été fortement critiquée par des spécialistes de la protection de la vie privée.

Qui est concerné par ces changements ?

Les nouvelles politiques s’appliquent à tous les plans Claude Free, Pro et Max. En revanche, les services destinés aux entreprises ou sous contrat commercial — tels que Claude for Work, Claude Gov, Claude for Education ou encore les intégrations via API avec des plateformes tierces comme Amazon Bedrock ou Google Cloud Vertex AI — en sont exclus.

En pratique, des millions d’utilisateurs individuels et professionnels seront impactés, sauf s’ils choisissent explicitement de se désinscrire.

Un recul en matière de protection des données ?

Ce mouvement d’Anthropic rappelle celui d’autres leaders technologiques ayant adopté des changements similaires sous prétexte de sécurité. Google et Microsoft ont été accusés d’intégrer des fonctionnalités d’IA dans leurs services avec une approche similaire, où le consentement actif est souvent absent.

Selon des experts en droit numérique, le problème ne réside pas tant dans la volonté d’améliorer les modèles, mais dans l’impact sur la vie privée et l’autonomie des utilisateurs. « Les systèmes opt-out reposent sur la passivité de l’utilisateur, qui ne lit pas toujours les petites lignes ou ne dispose pas des compétences techniques pour modifier la configuration », explique un conseiller en protection des données européen.

De plus, la conservation des données sur cinq ans pose un autre problème. « Maintenir des données aussi longtemps augmente le risque de fuites ou d’usages abusifs, même si l’on applique des processus d’anonymisation », ajoute l’expert.

Quelle réponse donne Anthropic ?

L’entreprise assure qu’elle ne vend pas les données à des tiers et qu’elle utilise des outils automatiques pour filtrer ou masquer les informations sensibles. « Notre objectif est de renforcer la sécurité et l’utilité de Claude », précisent ses communiqués.

Cependant, cet argument ne convainc pas tout le monde. Dans un contexte de méfiance croissante envers les géants de la tech, cette décision est perçue comme un recul dans la construction d’une intelligence artificielle éthique et transparente.

Comparaison avec d’autres acteurs

Ce débat ne se limite pas à Anthropic. Alors que celle-ci opère un retournement de stratégie perçu comme une concession en matière de confidentialité, Vivaldi, le navigateur alternatif, a récemment annoncé qu’il ne intégrerait pas de fonctionnalités d’IA générative. Selon son PDG, Jon von Tetzchner, cela reviendrait à « transformer la navigation active en consommation passive ».

La comparaison est inévitable : certaines entreprises renforcent leur engagement en faveur de la vie privée, tandis que d’autres choisissent de monétiser les données de leurs utilisateurs comme carburant pour l’IA.

Le contexte réglementaire : un terrain miné

Ce revirement intervient dans un contexte réglementaire en pleine évolution. En Union européenne, l’entrée en vigueur de la Loi sur l’intelligence artificielle et du RGPD impose aux entreprises de justifier l’utilisation des données personnelles et d’obtenir un consentement éclairé.

Aux États-Unis, bien qu’il n’y ait pas encore de cadre fédéral aussi strict, la pression exercée par des plaignants contre des sociétés comme OpenAI, Meta ou Anthropic pourrait façonner la jurisprudence à venir.

Si des accusations selon lesquelles la société a utilisé des contenus sans licence pour entraîner ses modèles se confirment, ce nouveau changement pourrait alimenter la critique.

Innovation ou risque inutile ?

Le dilemme est clair : l’IA a besoin de données pour évoluer, mais ces données appartiennent à leurs créateurs. Chaque message, conversation ou document partagé avec un chatbot constitue une partie intégrante de la vie numérique des utilisateurs.

Pour certains, la décision d’Anthropic représente une étape logique dans la course au développement de modèles plus puissants. Pour d’autres, c’est une renonciation dangereuse à la vie privée individuelle.

Ce qui est certain, c’est que la bataille pour le contrôle des données façonnera l’avenir de l’IA dans les années à venir. Et ce qui est aujourd’hui optionnel pourrait devenir demain une obligation incontournable.

Questions fréquentes (FAQ)

1. Puis-je empêcher Claude d’utiliser mes données pour l’entraînement ?

Oui. Il suffit d’accéder aux paramètres de confidentialité et de désactiver manuellement l’option activée par défaut.

2. Combien de temps Anthropic conserve-t-elle les données des utilisateurs ?

Jusqu’à cinq ans, selon la nouvelle politique de confidentialité.

3. Quels plans Claude sont concernés par ce changement ?

Tous les plans individuels : Free, Pro et Max. Les offres pour entreprises ou intégrations API en sont exclues.

4. Quels risques présentent cette nouvelle politique ?

Vos conversations pourraient être stockées pour une longue durée et utilisées pour l’entraînement de l’IA. Bien qu’Anthropic affirme anonymiser les données, il existe un risque de fuites ou d’abus.