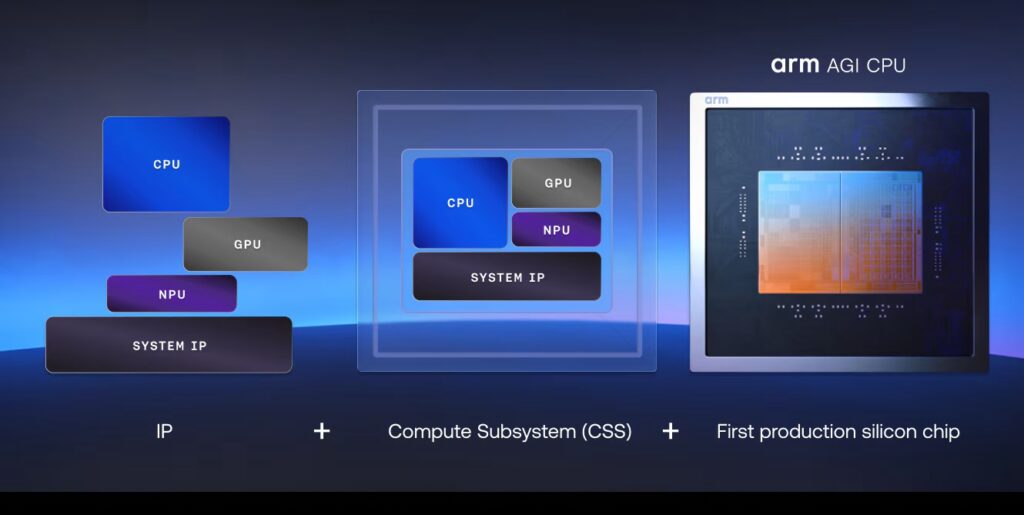

Arm a franchi une étape importante en dépassant son rôle traditionnel de concepteur d’architecture pour concurrencer, pour la première fois, avec un produit propre dans l’un des secteurs les plus dynamiques : l’infrastructure pour l’intelligence artificielle (IA). La société britannique a annoncé le Arm AGI CPU, son premier processeur de production conçu directement pour les centres de données spécialisés dans les charges de travail en IA agente, modifiant ainsi sa place historique sur le marché des semi-conducteurs et bouleversant la compétition. Selon Arm, ce processeur offrira jusqu’à 136 cœurs Neoverse V3 par CPU, avec une puissance thermique (TDP) de 300 watts, et une densité pouvant atteindre 8 160 cœurs par rack dans des serveurs 1U refroidis par air, plus de 45 000 avec un refroidissement liquide. La société affirme également pouvoir surpasser de plus de deux fois les performances par rack par rapport aux plateformes x86, bien que cette comparaison soit basée sur ses propres estimations.

Ce qui rend cette annonce cruciale, ce n’est pas seulement la fiche technique, mais aussi le contexte dans lequel elle arrive. La course à l’IA ne se joue plus uniquement sur les GPU. À mesure que les modèles passent d’un simple entraînement à une exécution en tant qu’agents capables de raisonner, d’enchaîner des tâches, de déplacer des données et de coordonner plusieurs services, la CPU retrouve une place stratégique dans les centres de données. Arm cherche précisément à occuper cet espace : celui de la CPU qui orchestre, coordonne et soutient la couche d’infrastructure permettant la déploiement à grande échelle de l’IA. Meta apparaît comme un partenaire principal et co-développeur, tandis qu’Arm cite également OpenAI, Cloudflare, SAP, Cerebras, F5 ou SK Telecom parmi ses premiers soutiens commerciaux.

Le mouvement d’Arm ne vise pas seulement Intel

La lecture immédiate pourrait laisser penser qu’Arm veut attaquer Intel et AMD sur leur terrain naturel. Et en partie, c’est vrai. Mais l’impact de cette annonce est plus large. Arm ne veut pas simplement concurrencer l’architecture x86 traditionnelle, mais aussi muscler sa présence dans l’écosystème Arm lui-même, où AWS, Google et Microsoft conçoivent déjà leurs propres processeurs pour le cloud, et où NVIDIA pousse depuis un certain temps son architecture Grace comme complément idéal pour ses plateformes accélérées d’IA. La différence est qu’Arm ne présente pas un processeur réservé à sa propre cloud ni un design interne pour une utilisation exclusive : elle cherche à transformer cette technologie en un produit commercial accessible à des tiers, alors qu’auparavant, cette capacité était surtout réservée aux grands acteurs hyper-scalaires.

Le Arm AGI CPU devient ainsi une pièce unique. Apple a montré il y a plusieurs années, avec Apple Silicon, qu’une architecture Arm bien intégrée pouvait rivaliser, voire dépasser, bon nombre de designs x86 en termes de performances par watt dans les ordinateurs personnels et stations de travail. Le M4, fabriqué en technologie de deuxième génération de 3 nanomètres, confirme cette tendance en insistant sur l’efficacité et l’importance croissante de l’IA locale sur les appareils. Cependant, Apple ne constitue pas un rival direct : sa stratégie reste verticale, fermée et centrée sur ses produits propres pour Mac et iPad, sans intention de vendre des CPU pour des centres de données tiers. Dans cette optique, Apple représente davantage une preuve de la maturité de l’écosystème Arm que concurrent direct pour l’AGI CPU.

NVIDIA, Intel et AMD : trois concurrents très différents

En examinant plus en détail le marché de l’IA, le rival qui pose probablement le plus de difficultés à Arm n’est pas Apple, mais NVIDIA. La raison en est simple : NVIDIA ne concurrence pas uniquement avec une CPU, mais avec une plateforme complète. La Grace, leur CPU Arm pour centres de données, s’impose comme la base de la nouvelle génération d’infrastructures IA. Selon la société, elle offre jusqu’à deux fois plus d’efficacité énergétique que les CPU classiques, avec 72 cœurs Arm v9, mémoire LPDDR5X, et une intégration étroite avec GPU via NVLink-C2C. NVIDIA travaille également sur Vera, la prochaine génération conçue pour les systèmes d’IA agentes. Face à cela, Arm propose une alternative : une CPU visant la densité, l’efficience et la orchestration, soutenue par un écosystème plus ouvert et moins verrouillé, sans vendre l’écosystème complet GPU, réseau et logiciel comme NVIDIA.

De leur côté, Intel continue de défendre la position historique du x86 en centre de données. Sa famille Xeon 6 repose sur une stratégie duale avec P-cores et E-cores, visant un large spectre de charges, du cloud et de l’analyse à l’IA, l’edge computing et la mise en réseau. Avec ses E-cores efficaces, Intel annonce jusqu’à 144 cœurs par socket, mettant en avant le rapport performance/watt et la compatibilité avec l’écosystème existant. Cela reste son atout majeur : la stabilité de son parc installé et la familiarité de ses flux logiciels pour de nombreux clients. Arm souhaite s’attaquer précisément à cet enjeu en misant sur la densité, l’efficacité et la scalabilité pour l’infrastructure IA. Intel, en revanche, conserve une énorme base installée et une inertie commerciale difficile à déloger.

AMD, quant à elle, a clairement compris la transition. Ses EPYC de 5e génération atteignent jusqu’à 192 cœurs, avec 12 canaux DDR5, orientées cloud, entreprise et IA. AMD met en avant des CPUs capables d’accélérer l’inférence, de servir de plateforme hôte pour des systèmes avec GPU, tout en maintenant une compatibilité x86 à haute densité. La société revendique que ses EPYC 9005 disposent actuellement du plus grand nombre de cœurs pour un serveur x86. En matière de CPU, AMD apparaît comme le concurrent le plus sérieux pour Arm dans les serveurs généralistes et dans une bonne partie de l’infrastructure liée à l’IA. La différence réside dans le fait qu’Arm privilégie une approche plus ciblée : une CPU pour les centres de données d’agents, plutôt qu’un CPU universel.

Le vrai défi : Arm face à ses propres créations

Un autre enjeu moins visible mais tout aussi important concerne la compétition interne. Les offres comme AWS Graviton4, Google Axion et Azure Cobalt 100 prouvent que l’architecture Arm a déjà trouvé une place solide dans le cloud. AWS affirme que Graviton4 est son processeur le plus puissant et efficace à ce jour, et continue d’étendre ses gammes d’instances basées sur cette architecture. Google commercialise Axion comme CPU Arm personnalisée pour le calcul général dans le cloud, tandis que Microsoft utilise Cobalt 100 dans plusieurs régions, en le présentant comme un processeur maison pour ses services cloud. En somme, Arm a peut-être pris du retard si l’on considère le marché « Arm dans le centre de données », car ce marché est déjà lancé. Toutefois, elle arrive à point nommé pour proposer cette architecture en tant que solution accessible à ceux qui ne peuvent pas concevoir leur propre processeur comme Graviton ou Axion, mais souhaitent bénéficier d’un semblable.

Par ailleurs, une autre technologie émergente mérite d’être surveillée : RISC-V. Son écosystème affirme que l’ISA ouverte pourrait devenir une plateforme très attractive pour l’IA, grâce à sa flexibilité, son contrôle et ses coûts, et selon le rapport annuel de RISC-V International, les premiers déploiements liés aux centres de données devraient arriver à partir de 2026. À ce jour, RISC-V demeure encore loin de la maturité commerciale et de l’écosystème logiciel que possèdent déjà Arm, x86 ou NVIDIA pour l’IA. Plus qu’un concurrent immédiat à l’Arm AGI CPU, c’est une pression de fond qui rappelle que la prochaine grande bataille ne sera pas uniquement pour vendre des puces, mais pour dominer l’architecture qui guidera la décennie à venir en informatique.

En résumé, Arm ne se contente pas de lancer un nouveau processeur : la société franchit une étape stratégique majeure. Sur un marché où Intel défend la compatibilité, AMD mise sur la densité, NVIDIA domine le stack accéléré, et Apple illustre la puissance d’un écosystème intégré, Arm décide de devenir à la fois arbitre et acteur de l’écosystème. À l’ère de l’intelligence artificielle agente, cela pourrait avoir des implications bien plus profondes qu’il n’y paraît.

Questions fréquentes

Qu’est-ce que l’Arm AGI CPU et pourquoi est-ce crucial pour l’IA ?

Il s’agit du premier processeur de production conçu par Arm pour les centres de données, destiné à gérer les charges de l’IA agente, où la CPU coordonne tâches, flux et services autour des accélérateurs et modèles IA.

Ce CPU rivalise-t-il directement avec Apple Silicon ?

Pas directement. Apple Silicon montre l’efficacité d’Arm dans des dispositifs et PC propriétaires, mais Apple ne propose pas de CPU pour centres de données ouverts. En revanche, l’AGI CPU vise plutôt à concurrencer Intel, AMD, NVIDIA et les solutions cloud de Google ou Microsoft.

En quoi diffère-t-il de NVIDIA Grace ?

Grace constitue une plateforme complète intégrant GPU, interconnexion et logiciel pour l’IA, tandis que l’Arm AGI CPU se positionne comme une CPU dense, efficace, orientée orchestration et services, avec un écosystème plus ouvert.

Arm peut-elle réduire la part de marché d’Intel et AMD dans les serveurs IA ?

Elle dispose d’opportunités concrètes dans des charges spécifiques en termes de densité, d’efficacité et d’échelle, notamment là où la consommation par rack et la coordination des services sont critiques. Toutefois, Intel conserve une forte base installée et une inertie commerciale difficile à dépasser ; AMD propose des solutions x86 très compétitives avec jusqu’à 192 cœurs.

Source : ARM AGI CPU